一、背景和痛點

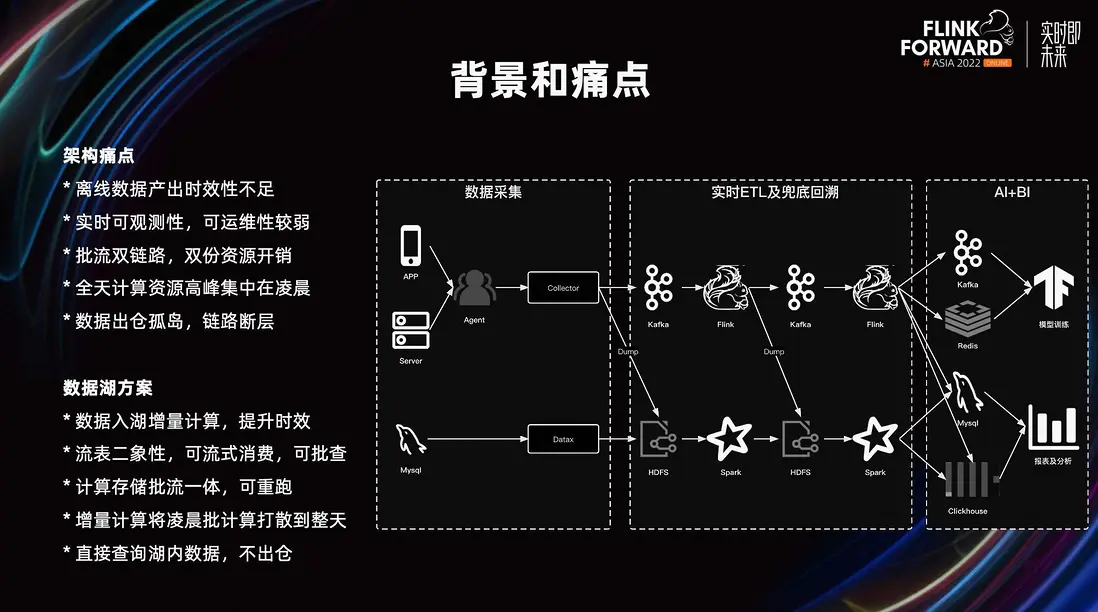

在大數據場景應用中,業務不僅要計算數據結果,而且要保障時效性。目前,我司演化出兩條鏈路。時效性高的數據走 Kafka、Flink 實時鏈路;時效性要求低的數據走 Spark 離線鏈路。上圖簡單描述了 B 站數據上報、處理和使用的鏈路。數據採集主要通過 APP 端上報的行為事件數據。服務端上報的日誌數據會通過網關以及分發層,流式分發到大數據數倉體系內。

MySQL 中存儲的業務數據,通過 Datax 週期性的批式同步到數倉內。時效性高的數據會通過 Flink+Kafka 進行流式計算。時效性低的數據通過 Spark+HDFS 進行批計算最後出倉到 MySQL Redis Kafka 的介質中,為 AI、BI 的模型訓練、報表分析場景使用。

完整內容請點擊下方鏈接查看:

https://developer.aliyun.com/article/1211753?utm_content=g_10...

版權聲明:本文內容由阿里雲實名註冊用户自發貢獻,版權歸原作者所有,阿里雲開發者社區不擁有其著作權,亦不承擔相應法律責任。具體規則請查看《阿里雲開發者社區用户服務協議》和《阿里雲開發者社區知識產權保護指引》。如果您發現本社區中有涉嫌抄襲的內容,填寫侵權投訴表單進行舉報,一經查實,本社區將立刻刪除涉嫌侵權內容。