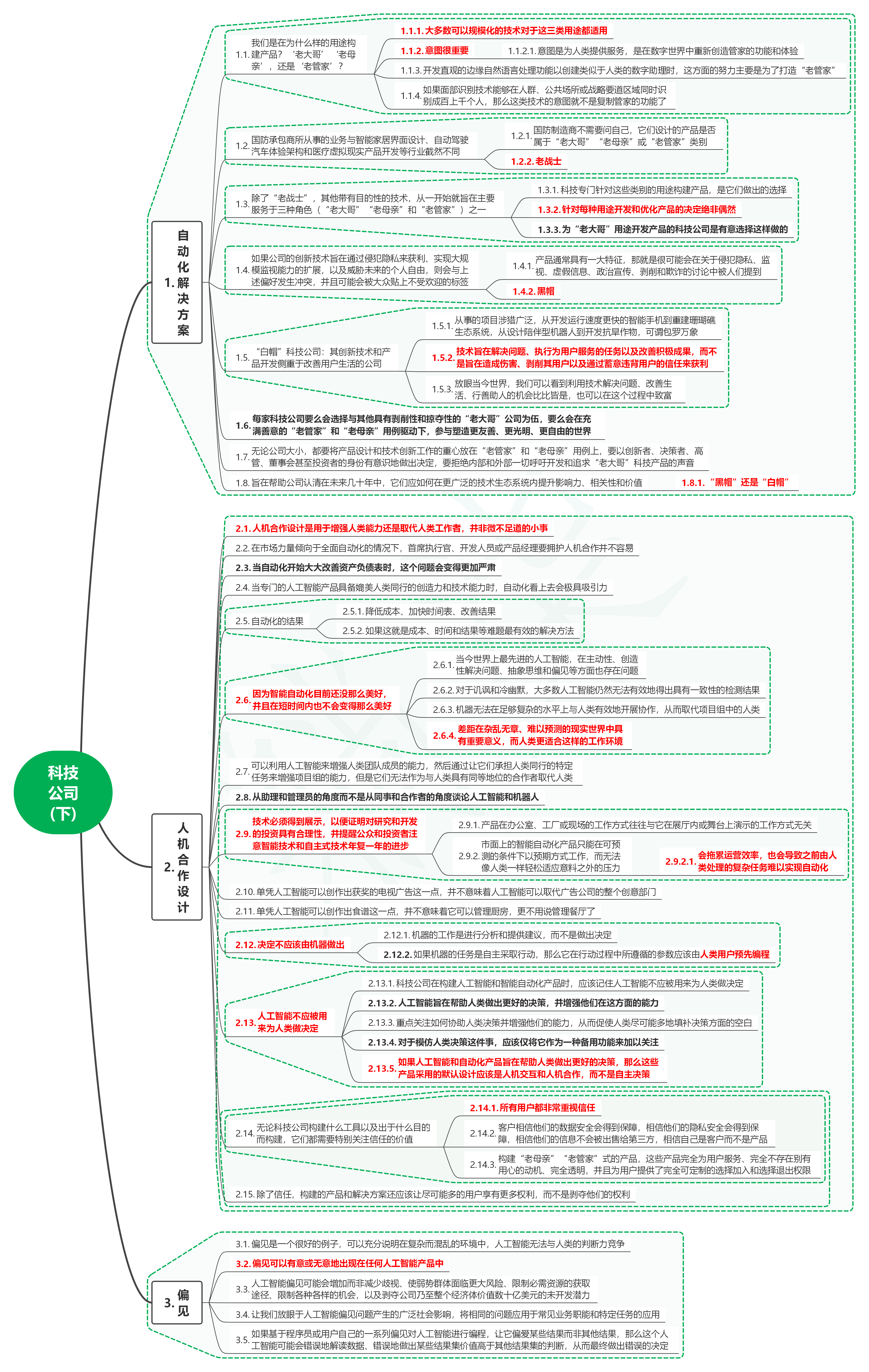

1. 自動化解決方案

1.1. 我們是在為什麼樣的用途構建產品?‘老大哥’‘老母親’,還是‘老管家’?

-

1.1.1. 大多數可以規模化的技術對於這三類用途都適用

-

1.1.2. 意圖很重要

- 1.1.2.1. 意圖是為人類提供服務,是在數字世界中重新創造管家的功能和體驗

-

1.1.3. 開發直觀的邊緣自然語言處理功能以創建類似於人類的數字助理時,這方面的努力主要是為了打造“老管家”

-

1.1.4. 如果面部識別技術能夠在人羣、公共場所或戰略要道區域同時識別成百上千個人,那麼這類技術的意圖就不是複製管家的功能了

1.2. 國防承包商所從事的業務與智能家居界面設計、自動駕駛汽車體驗架構和醫療虛擬現實產品開發等行業截然不同

-

1.2.1. 國防制造商不需要問自己,它們設計的產品是否屬於“老大哥”“老母親”或“老管家”類別

-

1.2.2. 老戰士

1.3. 除了“老戰士”,其他帶有目的性的技術,從一開始就旨在主要服務於三種角色(“老大哥”“老母親”和“老管家”)之一

-

1.3.1. 科技專門針對這些類別的用途構建產品,是它們做出的選擇

-

1.3.2. 針對每種用途開發和優化產品的決定絕非偶然

-

1.3.3. 為“老大哥”用途開發產品的科技公司是有意選擇這樣做的

1.4. 如果公司的創新技術旨在通過侵犯隱私來獲利、實現大規模監視能力的擴展,以及威脅未來的個人自由,則會與上述偏好發生衝突,並且可能會被大眾貼上不受歡迎的標籤

-

1.4.1. 產品通常具有一大特徵,那就是很可能會在關於侵犯隱私、監視、虛假信息、政治宣傳、剝削和欺詐的討論中被人們提到

-

1.4.2. 黑帽

1.5. “白帽”科技公司:其創新技術和產品開發側重於改善用户生活的公司

-

1.5.1. 從事的項目涉獵廣泛,從開發運行速度更快的智能手機到重建珊瑚礁生態系統,從設計陪伴型機器人到開發抗旱作物,可謂包羅萬象

-

1.5.2. 技術旨在解決問題、執行為用户服務的任務以及改善積極成果,而不是旨在造成傷害、剝削其用户以及通過蓄意違背用户的信任來獲利

-

1.5.3. 放眼當今世界,我們可以看到利用技術解決問題、改善生活、行善助人的機會比比皆是,也可以在這個過程中致富

1.6. 每家科技公司要麼會選擇與其他具有剝削性和掠奪性的“老大哥”公司為伍,要麼會在充滿善意的“老管家”和“老母親”用例驅動下,參與塑造更友善、更光明、更自由的世界

1.7. 無論公司大小,都要將產品設計和技術創新工作的重心放在“老管家”和“老母親”用例上,要以創新者、決策者、高管、董事會甚至投資者的身份有意識地做出決定,要拒絕內部和外部一切呼籲開發和追求“老大哥”科技產品的聲音

1.8. 旨在幫助公司認清在未來幾十年中,它們應如何在更廣泛的技術生態系統內提升影響力、相關性和價值

- 1.8.1. “黑帽”還是“白帽”

2. 人機合作設計

2.1. 人機合作設計是用於增強人類能力還是取代人類工作者,並非微不足道的小事

2.2. 在市場力量傾向於全面自動化的情況下,首席執行官、開發人員或產品經理要擁護人機合作並不容易

2.3. 當自動化開始大大改善資產負債表時,這個問題會變得更加嚴肅

2.4. 當專門的人工智能產品具備媲美人類同行的創造力和技術能力時,自動化看上去會極具吸引力

2.5. 自動化的結果

-

2.5.1. 降低成本、加快時間表、改善結果

-

2.5.2. 如果這就是成本、時間和結果等難題最有效的解決方法

2.6. 因為智能自動化目前還沒那麼美好,並且在短時間內也不會變得那麼美好

-

2.6.1. 當今世界上最先進的人工智能,在主動性、創造性解決問題、抽象思維和偏見等方面也存在問題

-

2.6.2. 對於譏諷和冷幽默,大多數人工智能仍然無法有效地得出具有一致性的檢測結果

-

2.6.3. 機器無法在足夠複雜的水平上與人類有效地開展協作,從而取代項目組中的人類

-

2.6.4. 差距在雜亂無章、難以預測的現實世界中具有重要意義,而人類更適合這樣的工作環境

2.7. 可以利用人工智能來增強人類團隊成員的能力,然後通過讓它們承擔人類同行的特定任務來增強項目組的能力,但是它們無法作為與人類具有同等地位的合作者取代人類

2.8. 從助理和管理員的角度而不是從同事和合作者的角度談論人工智能和機器人

2.9. 技術必須得到展示,以便證明對研究和開發的投資具有合理性,並提醒公眾和投資者注意智能技術和自主式技術年復一年的進步

-

2.9.1. 產品在辦公室、工廠或現場的工作方式往往與它在展廳內或舞台上演示的工作方式無關

-

2.9.2. 市面上的智能自動化產品只能在可預測的條件下以預期方式工作,而無法像人類一樣輕鬆適應意料之外的壓力

- 2.9.2.1. 會拖累運營效率,也會導致之前由人類處理的複雜任務難以實現自動化

2.10. 單憑人工智能可以創作出獲獎的電視廣告這一點,並不意味着人工智能可以取代廣告公司的整個創意部門

2.11. 單憑人工智能可以創作出食譜這一點,並不意味着它可以管理廚房,更不用説管理餐廳了

2.12. 決定不應該由機器做出

-

2.12.1. 機器的工作是進行分析和提供建議,而不是做出決定

-

2.12.2. 如果機器的任務是自主採取行動,那麼它在行動過程中所遵循的參數應該由人類用户預先編程

2.13. 人工智能不應被用來為人類做決定

-

2.13.1. 科技公司在構建人工智能和智能自動化產品時,應該記住人工智能不應被用來為人類做決定

-

2.13.2. 人工智能旨在幫助人類做出更好的決策,並增強他們在這方面的能力

-

2.13.3. 重點關注如何協助人類決策並增強他們的能力,從而促使人類儘可能多地填補決策方面的空白

-

2.13.4. 對於模仿人類決策這件事,應該僅將它作為一種備用功能來加以關注

-

2.13.5. 如果人工智能和自動化產品旨在幫助人類做出更好的決策,那麼這些產品採用的默認設計應該是人機交互和人機合作,而不是自主決策

2.14. 無論科技公司構建什麼工具以及出於什麼目的而構建,它們都需要特別關注信任的價值

-

2.14.1. 所有用户都非常重視信任

-

2.14.2. 客户相信他們的數據安全會得到保障,相信他們的隱私安全會得到保障,相信他們的信息不會被出售給第三方,相信自己是客户而不是產品

-

2.14.3. 構建“老母親”“老管家”式的產品,這些產品完全為用户服務、完全不存在別有用心的動機、完全透明,並且為用户提供了完全可定製的選擇加入和選擇退出權限

2.15. 除了信任,構建的產品和解決方案還應該讓儘可能多的用户享有更多權利,而不是剝奪他們的權利

3. 偏見

3.1. 偏見是一個很好的例子,可以充分説明在複雜而混亂的環境中,人工智能無法與人類的判斷力競爭

3.2. 偏見可以有意或無意地出現在任何人工智能產品中

3.3. 人工智能偏見可能會增加而非減少歧視、使弱勢羣體面臨更大風險、限制必需資源的獲取途徑、限制各種各樣的機會,以及剝奪公司乃至整個經濟體價值數十億美元的未開發潛力

3.4. 讓我們放眼於人工智能偏見問題產生的廣泛社會影響,將相同的問題應用於常見業務職能和特定任務的應用

3.5. 如果基於程序員或用户自己的一系列偏見對人工智能進行編程,讓它偏愛某些結果而非其他結果,那麼這個人工智能可能會錯誤地解讀數據、錯誤地做出某些結果集價值高於其他結果集的判斷,從而最終做出錯誤的決定