12 月 11 日下午,在一個温暖和煦的冬日,“龍蜥社區走進系列”之走進 Arm Meetup 在上海成功舉辦。本次活動吸引了來自雲計算、互聯網、半導體等領域的眾多專家學者齊聚一堂,圍繞 Arm 生態、開源社區、AI 基礎設施及大模型推理等領域的技術突破,共同探討了開源操作系統與 Arm Neoverse 平台在人工智能(AI)時代的深度融合與創新實踐。

現場通過一系列主題分享,集中展示了 Arm Neoverse 平台、AI 性能分析工具、異構推理框架及優化等技術成果。這些成果不僅體現了產業鏈上下游協同創新與開源共建的精神,也加速了 AI 與雲計算在 Arm 架構上的落地,為開源操作系統行業提供了更高效、可靠的解決方案。

(圖/活動現場嘉賓合影)

活動伊始,阿里雲智能集團編譯器技術總監、Java 標準委員會委員(JCP-EC),Java Champion、龍蜥社區 Java 語言與虛擬機 SIG Maintainer 李三紅做開場致辭。發言聚焦阿里雲在倚天 Arm 架構上的深耕,首先以全棧自研為核心,從芯片、操作系統到編譯器全面優化,提升雲原生場景的性能與性價比。其次重申對開源的長期投入,積極參與龍蜥社區建設,持續貢獻穩定高效的操作系統能力。最後強調通過社區、理事單位和生態夥伴的合作,攜手 Arm 共建完整生態,共同推動企業更好地使用 Arm 技術。與此同時,他也鼓勵大家在活動中積極交流,共促行業發展。

(圖/李三紅)

接下來,來自阿里雲、龍蜥社區、趨境科技、鴻鈞微電子以及安謀科技的技術和市場專家針對基於 Arm Neoverse 平台,圍繞開源龍蜥操作系統 Anolis OS 的各個層面在 AI 浪潮中的變革和演進,進行了精彩的分享與思想碰撞。

首先由安謀科技雲人工智能事業部總監侯科鑫和阿里雲智能集團彈性計算高級架構師張先國帶來了題為《Arm 基礎設施加速雲計算智能駕駛》的聯合演講。

侯科鑫女士回顧了 AI 浪潮中若干行業趨勢,強調 AI 的快速發展正在推動基礎設施技術的重大轉型,Arm 參與其中並重新定義計算。Arm 幫助合作伙伴在通用計算以及智能計算定製化平台上取得了不菲的成績。Arm Neoverse 已成為這一轉型中多個關鍵領域的首選平台。演講深入介紹了 Arm Neoverse CSS,以及 Arm 的技術創新是如何幫助合作伙伴在 AI 時代加速產品上市。此外 Arm 在軟件生態系統上也持續投入,通過與阿里雲等合作伙伴的深度協作,Arm 平台不斷推動 AI 基礎設施創新,滿足智能駕駛行業對高可靠性、彈性擴展和綠色算力的迫切需求,助力企業快速應對 AI 時代的挑戰與機遇。

(圖/侯科鑫)

張先國則針對智能駕駛場景,重點展示了 Arm 基礎設施在智能駕駛場景中的雲計算加速能力,圍繞智能駕駛全流程——從數據採集、存儲、標註,到模型訓練、仿真驗證及端側集成,深入剖析行業痛點,包括數據規模龐大、算力消耗高、模型迭代快、訓練成本高。針對這些挑戰,提出了阿里雲彈性計算解決方案,包括高性能、彈性伸縮的 AI 基礎設施,支持十萬核級資源快速調度,結合容器化算力、Serverless 調度、GPU 切分等創新技術,顯著降低運維成本並提升性能(Spark場景優化 10% 以上,MRACC 算子優化 35%以上)。此外,方案還涵蓋視頻抽幀、點雲處理、分佈式訓練及大規模仿真,為智能駕駛業務提供端到端的高效雲端加速能力,助力行業實現 高可靠、低成本、快速迭代的目標。

(圖/張先國)

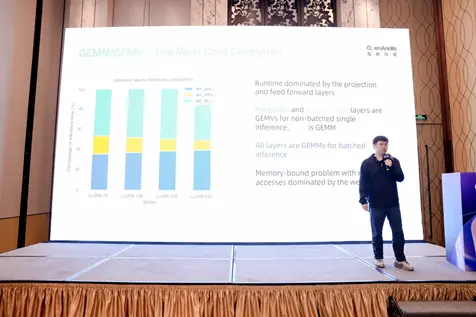

安謀科技主任軟件工程師方方明做了《RTP-LLM:Arm平台全面支持》的主題演講。Arm 同龍蜥社區、阿里巴巴在很多技術領域都有深度合作,包括推理引擎。在 AI 時代,基於 Arm CPU,團隊實現了對阿里巴巴大模型推理引擎 RTP-LLM 的全面支持,通過與生態夥伴的深度合作,RTP-LLM 不僅實現了對倚天等雲端 CPU 的高效適配,還支持主流大模型(如 Qwen、Llama、DeepSeek、Bert 等)及多種量化格式(FP32、FP16、INT8、INT4、GPTQ 等),並集成了 Arm KleidiAI 等高性能 AI 內核庫,極大提升了推理效率和靈活性。詳細的技術亮點包括:1. 利用 Arm 的加速指令對算子的極致性能優化;2. 全面支持 MoE 架構(如 DeepSeek V3、Qwen3),使用專家融合提高並行計算能力,MoE 推理性能最高提升 4 倍;3. 多種量化與矩陣乘優化方案,顯著降低內存佔用並提升算力利用率;4. 端到端測試與高效部署,支持雲到邊多場景落地;5. 性能對比顯示,RTP-LLM 在 Arm 平台上推理速度和資源效率均優於同類方案。

(圖/方方明)

隨着 AI 時代的到來,Java 在 AI 相關負載中扮演越來越重要的角色。阿里雲智能集團高級 JVM 工程師邢其正做了《阿里巴巴 Dragonwell JDK:為 AI 時代而生》的主題演講。阿里雲推出的 Dragonwell 21 AI 增強版,包含 Native 加速、熱代碼重排和 JTune 三大核心技術。具體來説:

- Native 加速:通過高度優化的原生實現,顯著提升 AI 相關計算性能,遠超傳統 JNI 方案,助力 Elasticsearch 向量搜索、Spark 等場景性能提升 18%-60%。

- 熱代碼重排:智能管理 JVM Code Cache,提升 JIT 編譯代碼的命中率和運行效率。

- 智能調優:AI驅動的自動調優框架,降低JVM參數複雜度,實現更高效的資源利用和運維自動化。

Dragonwell JDK 不僅讓 Java 在 RAG、大數據、智能駕駛等 AI 場景下實現性能飛躍,還兼顧企業級系統集成與運維需求,推動 Java 成為 AI 時代的主流生產力工具。

(圖/邢其正)

ModelSight 是龍蜥社區自研的 AI 性能分析工具,基於 eBPF 實現 GPU、CPU、框架事件一體化觀測,實現 AI 場景下端到端的性能診斷。阿里雲智能集團技術專家、龍蜥社區智算基礎設施聯盟委員王鵬和常懷鑫聯合帶來了題為《ModelSight:端到端 AI 性能分析框架》的演講。兩位嘉賓分享瞭如何利用 ModelSight 對 235B 參數的 Qwen3 推理鏈路進行壓測、熱點定位與瓶頸可視化,並結合 TP/PP/EP 並行策略在 SGLang 框架中的落地,最終實現 2.12 倍性能提升。通過優化 SGLang overlap schedule,TTFT(首 Token 響應時間)平均提升 20%+。ModelSight 讓 AI 性能分析更智能、更高效,助力企業邁向 AI 時代算力極致優化!

鴻鈞微電子產品營銷經理吳喆就《鴻鈞微電子開源社區實踐》話題進行了深度分享。他介紹了鴻鈞微電子基於 Arm Neoverse 平台的服務器 CPU 產品的規格特點與主要適配的應用場景,並詳細闡述其開源社區策略:積極擁抱開源、服務社區;取之於社區,也回饋社區。基於龍蜥操作系統進行芯片驗證、驅動適配與性能優化,並向 Linux kernel、Qemu 等社區貢獻多項驅動與功能補丁。在應用層面,鴻旻處理器在內存數據庫 (Redis,Memcached)、視頻編解碼 (X265)、大數據 (Spark、Flink) 等場景展現出卓越的性能與能效優勢,助力 Arm 架構服務器在雲計算、AI、大數據等領域實現突破。基於高效能 Arm Neoverse 平台的服務器 CPU,鴻鈞微電子將持續推動開源協作與生態繁榮。

(圖/吳喆)

KTransformers 專注於大語言模型的高效推理和微調,通過 CPU-GPU 異構計算實現資源受限環境下的大模型部署,探索 Arm CPU+GPU 平台下的本地極致推理和個性化微調方案。趨境科技技術專家、KTransformers 核心開發人員袁子為帶來了題為《KTransformers:在 Arm CPU 上實現大模型異構推理》的主題演講,就 KTransformers 的以下創新亮點進行了細緻探討:支持 DeepSeek、Qwen、GLM、LLaMa 等主流大模型,靈活適配多種硬件平台;創新“Expert Deferral”機制,推理吞吐提升 45%,精度無損;針對 Arm 架構深度優化,NUMA 親和、SVE/SME 指令集加速,矩陣運算性能提升 1.5倍;支持 LoRA 微調,已集成進 Llama-Factory 和 SGLang,便於本地微調與多 GPU 加速。

(圖/袁子為)

最後,安謀科技主任軟件工程師劉亮亮就話題《llama.cpp 跨 NUMA 節點部署優化實踐》展開詳細探討。劉亮亮介紹了 llama.cpp 在 Arm 架構服務器部署中跨 NUMA 節點的性能問題及優化方案。主要通過以下兩種優化手段:通過“分治”優化 GGML barrier 大幅度減少跨 NUMA 節點原子操作;性能瓶頸 MUL_MAT 算子通過 dst_tensor=src0_tensor * wdata_tensor 進行 Tensor 的乘積操作,為了實現 MUL_MAT 算子的 NUMA 感知內存訪問,避免跨 NUMA 內存訪問。對其中的 src0 Tensor 以及 dst Tensor 進行內存分割,實現處在一個 NUMA 節點中的線程只訪問本地 NUMA 內存。而 wdata Tensor 是通過在量化的時候同時在不同的 NUMA 節點計算成基於 NUMA 節點的多副本。該方案已在 Arm Neoverse N2 平台實測,實現了 S_TG t/s提升 55%,S t/s 提升 53.2%,內存帶寬分佈也更為均衡。

(圖/劉亮亮)

最後,感謝本次活動各位嘉賓的精彩演講,也感謝龍蜥社區夥伴及 Arm 工作人員:劉捷、蔡佳麗、吳永霞、倪俊雄(以上排名不分先後)等人的組織與配合,使得本次走進 Arm MeetUp 活動圓滿結束。未來,期待龍蜥社區與 Arm 持續深化合作,在 AI 浪潮中共築開放、創新、可持續的開源操作系統新生態!

本次 MeetUp 回顧視頻及 PPT 後續會陸續上傳至龍蜥官網,歡迎大家持續關注。

—— 完 ——