目錄

- 前言

- 1. PromptTemplate 概述

- 1.1 什麼是 PromptTemplate

- 1.2 為什麼需要模板化提示

- 2. PromptTemplate 的參數與用法

- 2.1 主要參數説明

- 2.2 支持多種模板語法

- 3. 與 LLMChain 的結合使用

- 3.1 基本鏈式調用

- 3.2 多變量與上下文集成

- 4. PromptTemplate 與 ChatPromptTemplate 的區別

- 5. 實踐技巧與最佳實踐

- 5.1 提示設計建議

- 5.2 常見錯誤與排查

- 結語

前言

在大模型應用開發中,“提示詞”(Prompt)扮演着至關重要的角色。一個好的提示詞可以顯著提升模型輸出質量,而一個結構混亂或信息不明確的提示,則可能讓模型答非所問。

然而,在複雜的項目中,提示詞往往需要根據不同上下文、不同變量動態生成,這讓“硬編碼”成為難以維護的痛點。

為了解決這一問題,LangChain 提供了一個強大的組件——PromptTemplate。它允許開發者通過模板化方式構建提示詞,讓大模型的調用過程更靈活、更可複用、更結構化。本文將深入解析 PromptTemplate 的設計理念、使用方法及其在實際項目中的應用技巧。

1. PromptTemplate 概述

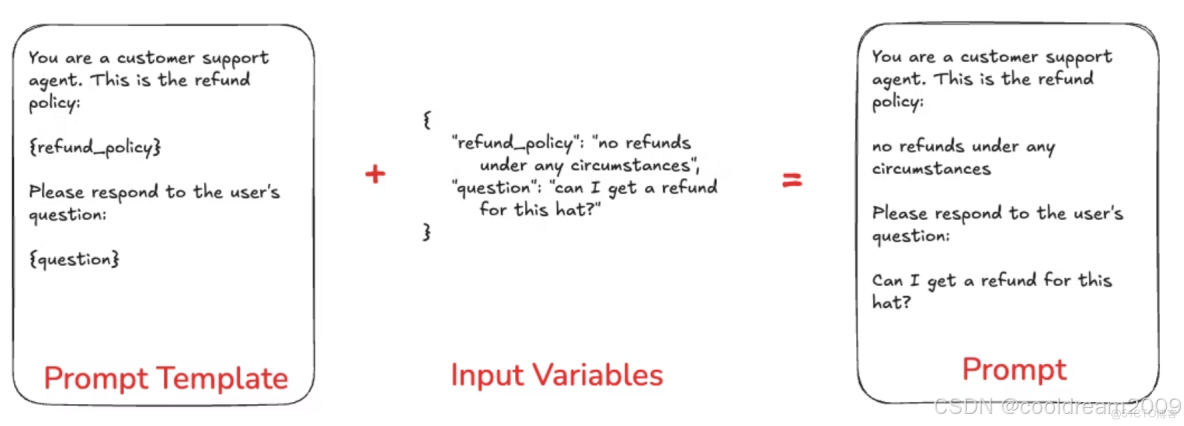

1.1 什麼是 PromptTemplate

PromptTemplate 是 LangChain 中用於構建提示詞模板的核心類。它的主要功能是:

- 參數化提示詞內容:通過變量佔位符定義動態部分;

- 減少重複代碼:讓提示結構可複用;

- 保證輸入一致性:自動校驗變量名稱;

- 支持多種模板語法:包括 f-string 與 jinja2。

簡單來説,PromptTemplate 就像一個“提示生成器”,你只需定義模板結構,運行時再傳入不同變量即可快速生成新的提示內容。

1.2 為什麼需要模板化提示

在傳統開發中,我們可能會直接在代碼中硬編碼提示,例如:

prompt = "請為產品 LangChain 智能助手 編寫一段廣告文案。"這種方式的問題包括:

- 不能靈活替換參數;

- 提示詞複用性差;

- 結構不統一,易出錯。

而使用 PromptTemplate,我們可以這樣定義:

from langchain.prompts import PromptTemplate

template = "請為產品 {product_name} 編寫一段廣告文案,突出其 {feature}。"

prompt = PromptTemplate.from_template(template)隨後,只需動態填充變量:

print(prompt.format(product_name="LangChain 智能助手", feature="高效與靈活"))輸出結果:

請為產品 LangChain 智能助手 編寫一段廣告文案,突出其 高效與靈活。這種方式不僅簡潔明瞭,還能在不同上下文中重複利用相同的模板。

2. PromptTemplate 的參數與用法

2.1 主要參數説明

|

參數名

|

類型

|

説明

|

|

|

List[str]

|

模板中使用的變量名列表

|

|

|

str

|

模板字符串內容

|

|

|

str

|

模板語法類型(默認 “f-string”)

|

|

|

bool

|

是否在初始化時校驗模板的有效性

|

你可以直接手動傳參:

prompt = PromptTemplate(

input_variables=["product_name", "feature"],

template="請為 {product_name} 寫一段宣傳語,突出其 {feature}。"

)或使用更簡潔的 from_template() 方法自動識別變量:

prompt = PromptTemplate.from_template("請介紹 {topic} 的主要特徵。")2.2 支持多種模板語法

LangChain 默認使用 Python 的 f-string 模板,但也支持更靈活的 Jinja2 模板引擎。

示例:

from langchain.prompts import PromptTemplate

template = """請寫一篇關於{{topic}}的短文,字數大約{{length}}字。"""

prompt = PromptTemplate(

input_variables=["topic", "length"],

template=template,

template_format="jinja2"

)

print(prompt.format(topic="人工智能", length=300))輸出結果:

請寫一篇關於人工智能的短文,字數大約300字。Jinja2 模板支持條件判斷、循環、邏輯控制,更適合複雜提示構建場景。

3. 與 LLMChain 的結合使用

3.1 基本鏈式調用

在 LangChain 中,PromptTemplate 通常與 LLMChain 一起使用。後者是連接大模型與提示模板的橋樑。

from langchain.chains import LLMChain

from langchain.llms import OpenAI

llm = OpenAI(temperature=0.7)

prompt = PromptTemplate(

input_variables=["question"],

template="請用簡潔的中文回答以下問題:{question}"

)

chain = LLMChain(llm=llm, prompt=prompt)

result = chain.run("LangChain 是什麼?")

print(result)在這段代碼中:

PromptTemplate定義提示結構;LLMChain將提示與模型綁定;chain.run()自動完成變量填充並調用模型。

3.2 多變量與上下文集成

PromptTemplate 可以處理多輸入場景,非常適合問答或知識檢索系統(RAG)。

template = """

你是一名{role}。

請回答以下問題:

{question}

背景信息:

{context}

"""

prompt = PromptTemplate(

input_variables=["role", "question", "context"],

template=template

)

print(prompt.format(

role="數據分析專家",

question="為什麼數據可視化很重要?",

context="數據可視化可以幫助發現趨勢和異常。"

))輸出結果:

你是一名數據分析專家。

請回答以下問題:

為什麼數據可視化很重要?

背景信息:

數據可視化可以幫助發現趨勢和異常。這樣的結構讓提示更加上下文化,有助於模型生成更符合語境的回答。

4. PromptTemplate 與 ChatPromptTemplate 的區別

LangChain 同時提供了 PromptTemplate 與 ChatPromptTemplate,二者的用途不同。

|

對比項

|

PromptTemplate

|

ChatPromptTemplate

|

|

適用場景

|

單輪文本提示

|

多輪對話

|

|

數據結構

|

純字符串

|

消息列表(包含角色)

|

|

常見角色

|

-

|

system、user、assistant

|

|

典型應用

|

LLMChain、簡單任務

|

ChatModel、智能體(Agent)

|

例如使用 ChatPromptTemplate:

from langchain.prompts import ChatPromptTemplate

prompt = ChatPromptTemplate.from_messages([

("system", "你是一名中文寫作助手。"),

("user", "請為主題 {topic} 寫一段100字的介紹。")

])

print(prompt.format(topic="LangChain"))這種結構可以更自然地表達多輪對話中的上下文關係。

5. 實踐技巧與最佳實踐

5.1 提示設計建議

- 明確角色定位:告訴模型“你是誰”能顯著提升輸出風格一致性。

- 保持格式一致:定義好輸出格式(如 JSON、Markdown)方便後續解析。

- 使用參數化變量:不要在模板中硬編碼具體內容。

- 驗證模板:設置

validate_template=True以防止變量遺漏。 - 配合上下文動態生成:可與文檔檢索、記憶模塊結合,自動生成補充信息。

5.2 常見錯誤與排查

|

錯誤類型

|

原因

|

解決方案

|

|

KeyError

|

模板變量與輸入變量不一致

|

檢查 |

|

模板格式異常

|

Jinja2 模板語法錯誤

|

確認模板符號 |

|

輸出偏離預期

|

提示結構不清晰

|

明確模型角色與任務目標

|

結語

在 LangChain 框架中,PromptTemplate 是構建智能交互的基礎組件。它將提示詞從“靜態文本”轉變為“動態生成邏輯”,使開發者能夠:

- 快速構建結構化提示;

- 輕鬆管理多任務提示體系;

- 與鏈、代理、記憶等模塊無縫銜接。

如果説 LangChain 是讓大模型“工作”的系統框架,那麼 PromptTemplate 就是讓它“聽懂指令”的語言基礎。 掌握 PromptTemplate,不僅能讓你的提示更智能、更靈活,也能為構建複雜的 AI 應用奠定堅實的根基。