引言

人工智能(AI)——一個熟悉又神秘的詞彙。我們常聽説它可以生成詩歌、編寫代碼、創作藝術,甚至回答各種問題。然而,當你想親手實現一個“AI 模型”時,卻可能感到無從下手。這篇教程正是為你準備的,將帶你從零開始,逐步掌握從“AI 新手”到“能夠搭建 AI 模型”的核心技能。

一、AI 的基本概念

1.什麼是 AI 模型?

AI 模型是通過訓練得到的一種程序,能夠利用海量數據學習規律,並在此基礎上完成各種任務。它的工作原理就像教一個孩子認水果:通過反覆觀察圖片,孩子學會了“香蕉是黃色的”“蘋果是圓的”,從而即使面對未見過的水果圖片,也能做出正確判斷。

AI模型:學生- 數據:課本

- 模型訓練:學生做練習題

- 模型評估:學生考試

2.模型如何學習?

模型學習的核心步驟如下:

- 喂數據:提供大量樣本,讓模型瞭解世界的“規律”。

- 定義目標:明確任務,例如判斷圖片中是狗還是貓。

- 反覆訓練:模型不斷調整其“參數”(類似腦回路),以優化對數據的理解。

- 測試與應用:在實際場景中運行模型,評估其效果。

3.AI 模型的類型

根據任務的性質,AI 模型主要分為以下幾類:

- 分類模型:識別類別,例如垃圾郵件分類。

- 迴歸模型:預測數值,例如房價預測。

- 生成模型:創造內容,例如生成圖像或文本。

4.什麼是“大模型”?

“大模型”是相對於傳統 AI 模型而言的,指的是參數規模大、學習能力強的模型。它們擁有強大的數據處理和推理能力,能夠應對複雜任務。例如,GPT 系列模型不僅可以完成寫作任務,還能實現編程、回答問題等多種功能,表現得更加“聰明”。

二、開發環境準備

在開始訓練模型前,我們需要搭建一個“工作環境”,就像進入廚房前需要準備好工具一樣。以下是必備的“廚具”:

1.安裝 Python

Python 是 AI 開發的首選語言,因其簡單易用的特點深受開發者喜愛。前往 Python 下載最新版本並安裝。安裝時務必勾選 “Add Python to PATH” ,確保後續工具可以正常運行。

2.安裝開發工具

推薦以下兩款工具,便於你編寫和調試代碼:

- Jupyter Notebook:一個交互式環境,適合初學者邊調試邊學習

AI代碼。 VS Code:功能強大的代碼編輯器,支持插件擴展,適合處理更復雜的項目。

3.安裝必要的 Python 庫

在終端運行以下命令,安裝 AI 開發常用的庫:

pip install numpy pandas matplotlib seaborn scikit-learn tensorflow這些庫的用途:

NumPy:用於高效的數學計算和數組操作。Pandas:強大的數據處理與分析工具。Matplotlib/Seaborn:用於數據可視化,展示數據分佈和關係。Scikit-learn:經典的機器學習庫,支持分類、迴歸和聚類等任務。TensorFlow:深度學習框架,用於構建和訓練神經網絡。

三、數據是 AI 的“糧食”

1.數據集來源

在 AI 項目中,數據是模型的基礎,就像糧食之於人類。沒有數據,模型就無法“成長”。下面是常見的數據來源:

- 開源平台:如 Kaggle 和 UCI Machine Learning Repository 提供了豐富的高質量數據集,適合各種任務和領域。

Sklearn自帶數據集:內置數據集,如加利福尼亞房價、鳶尾花數據集,簡單易用,適合初學者入門練習。

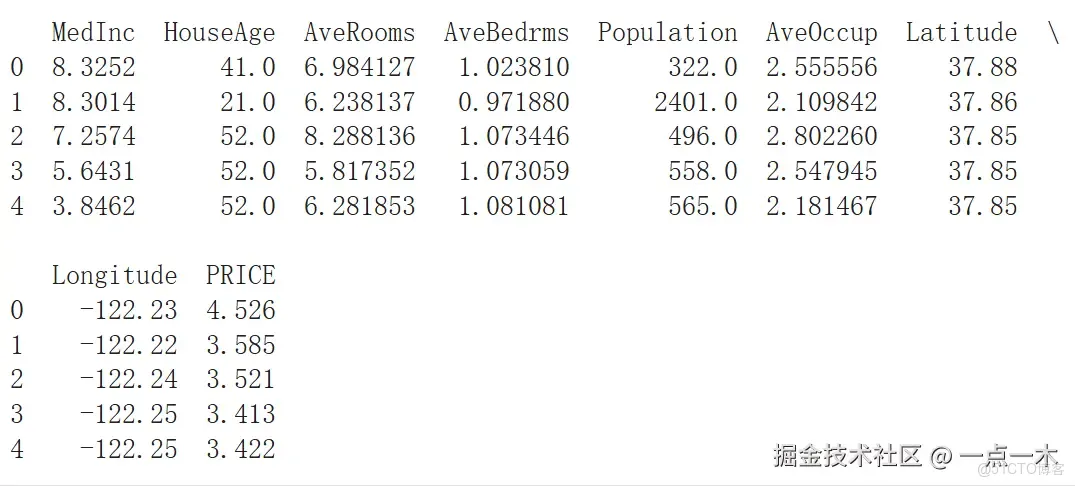

本教程選用:加利福尼亞房價數據集

from sklearn.datasets import fetch_california_housing

import pandas as pd

# 加載 California Housing 數據集

housing = fetch_california_housing()

data = pd.DataFrame(housing.data, columns=housing.feature_names)

data['PRICE'] = housing.target

# 查看數據

print(data.head())運行結果:

2.數據探索與可視化

在訓練模型之前,數據探索是至關重要的一步。通過探索,我們可以瞭解數據的結構、分佈特徵以及特徵間的關係,為後續的數據清洗和建模奠定基礎。

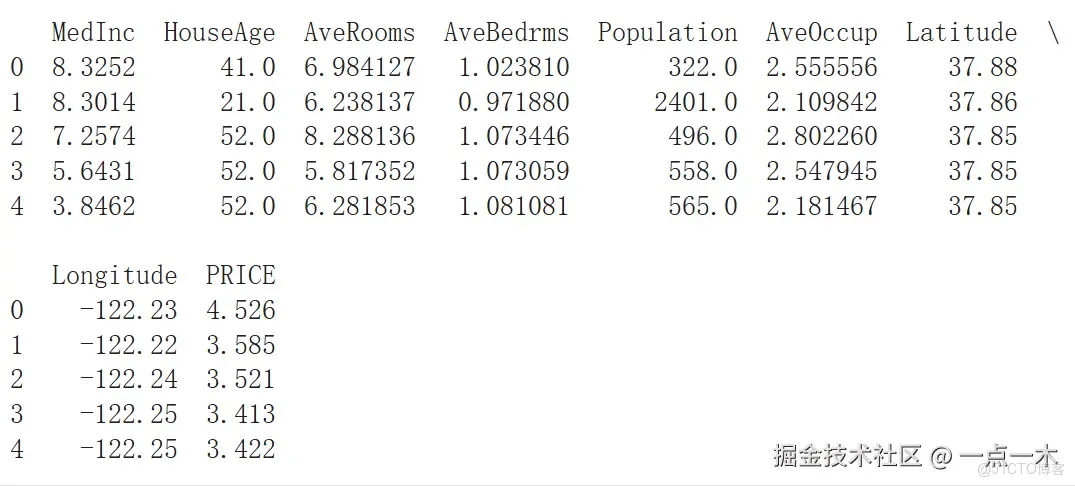

(1) 數據基本信息

# 查看數據統計信息

print(data.describe())運行結果:

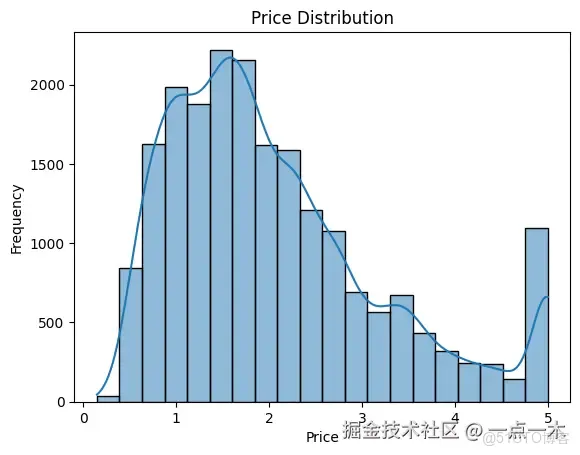

(2) 可視化分佈

import matplotlib.pyplot as plt

import seaborn as sns

# 繪製房價分佈圖

sns.histplot(data['PRICE'], kde=True, bins=20)

plt.title("Price Distribution") # 房價分佈

plt.xlabel("Price") # 房價

plt.ylabel("Frequency") # 頻數

plt.show()運行結果:

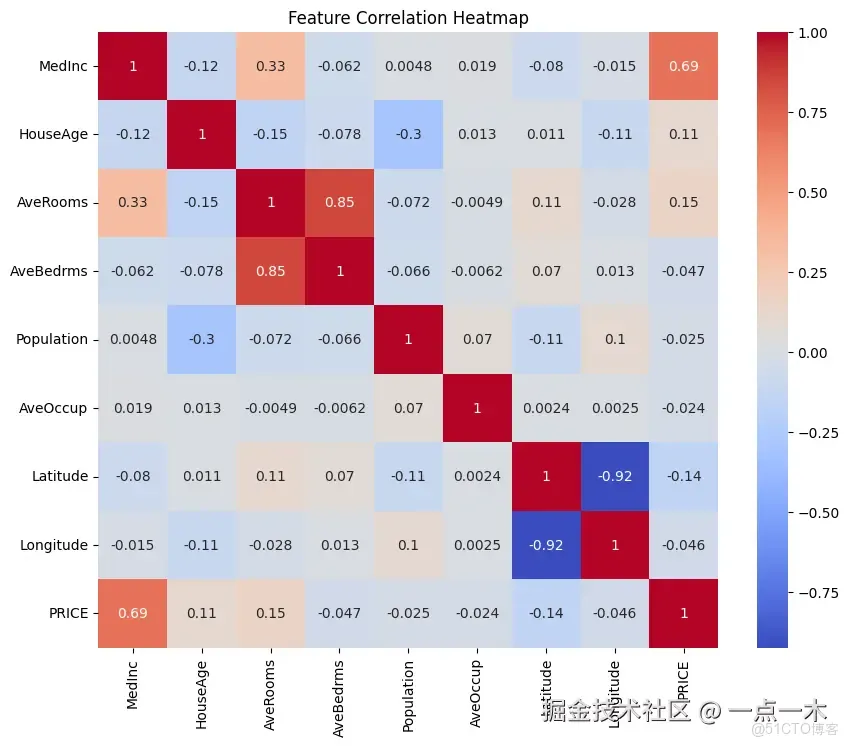

(3) 相關性分析

# 繪製特徵相關性熱力圖

plt.figure(figsize=(10, 8))

sns.heatmap(data.corr(), annot=True, cmap='coolwarm')

plt.title("Feature Correlation Heatmap") # 特徵相關性熱力圖

plt.show()運行結果:

3.數據清洗與預處理

在訓練模型之前,數據需要經過“加工”,以便讓模型更高效地學習。常見的清洗與預處理步驟包括檢查缺失值、處理異常值和標準化特徵。

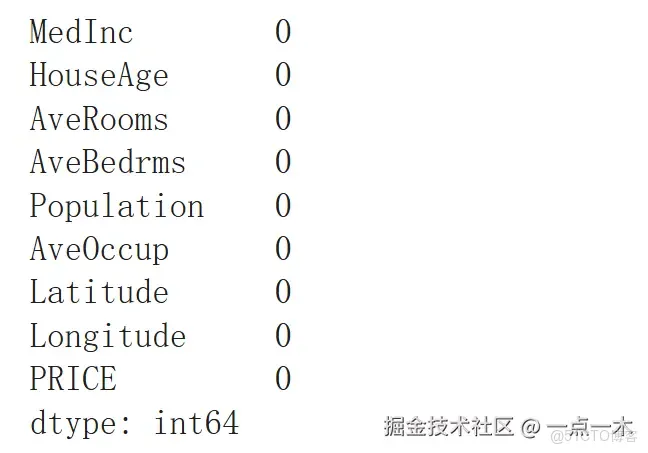

(1) 檢查缺失值

# 檢查缺失值

print(data.isnull().sum())運行結果:

(2) 數據標準化

from sklearn.preprocessing import StandardScaler

# 特徵標準化

scaler = StandardScaler()

features = data.drop('PRICE', axis=1)

target = data['PRICE']

features_scaled = scaler.fit_transform(features)四、訓練一個簡單模型

我們從最基礎的線性迴歸模型開始。儘管它不是“大模型”,但簡單直觀,可以幫助你快速瞭解 AI 模型的訓練流程,並打下堅實的基礎。

1.劃分訓練集和測試集

from sklearn.model_selection import train_test_split

# 劃分訓練集和測試集

X_train, X_test, y_train, y_test = train_test_split(features_scaled, target, test_size=0.2, random_state=42)2.訓練線性迴歸模型

from sklearn.linear_model import LinearRegression

from sklearn.metrics import mean_squared_error, r2_score

# 初始化模型

model = LinearRegression()

# 訓練模型

model.fit(X_train, y_train)

# 預測

y_pred = model.predict(X_test)

# 評估性能

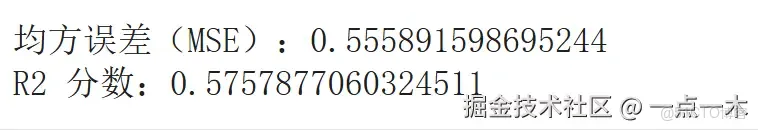

mse = mean_squared_error(y_test, y_pred)

r2 = r2_score(y_test, y_pred)

print(f"均方誤差(MSE):{mse}")

print(f"R2 分數:{r2}")運行結果:

3.模型效果解讀

MSE(均方誤差) :衡量預測值與真實值之間的平均偏差,值越小表示模型表現越好。R²分數:表示模型解釋數據方差的比例,值越接近 1,説明模型擬合度越高。

恭喜你!🎉 你已經成功訓練了第一個

AI模型!接下來,我們將進入深度學習的世界,訓練更強大的“大模型”。

五、深度學習初探

在上一部分,我們學習了基礎的線性迴歸模型。現在,讓我們進入更強大的深度學習領域,訓練一個多層神經網絡,使模型更智能、更深刻。

1.什麼是深度學習?

深度學習(Deep Learning)是基於“神經網絡”的機器學習方法,特別擅長從複雜數據中提取特徵並作出精準預測。

如果線性迴歸是“單核處理器”,那麼深度學習就是“多核加速器”。它模擬人腦的神經元,用層層堆疊的“神經網絡”來處理數據。換句話説,深度學習就是“開掛的人腦仿真”。

- 輸入層:接收數據(例如,圖片的像素值)。

- 隱藏層:逐步提取數據特徵,就像拆解複雜問題成多個小問題。

- 輸出層:輸出結果(例如,判斷圖片中是貓還是狗)。

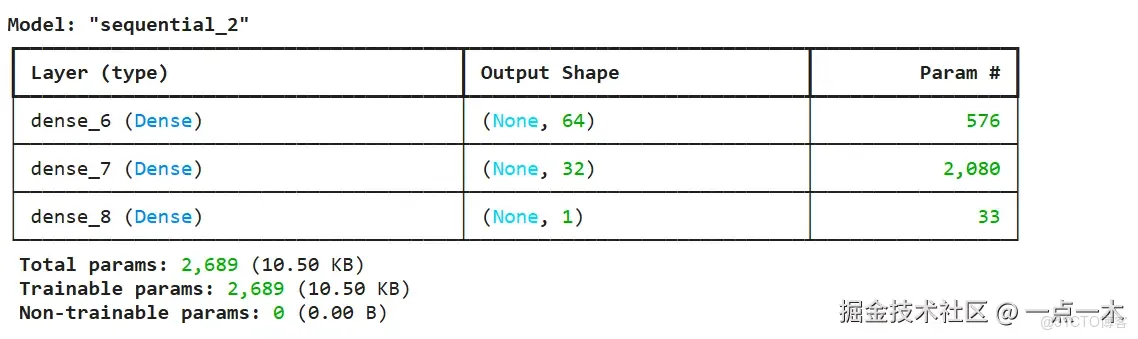

2.構建一個簡單神經網絡

我們將使用 TensorFlow 搭建一個簡單的兩層神經網絡來預測房價。以下代碼展示瞭如何構建和訓練這個神經網絡:

(1) 引入 TensorFlow 並定義網絡結構

import tensorflow as tf

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Dense, Input

# 定義模型

nn_model = Sequential([

Input(shape=(X_train.shape[1],)), # 顯式定義輸入層

Dense(64, activation='relu'), # 第一層隱藏層

Dense(32, activation='relu'), # 第二層隱藏層

Dense(1) # 輸出層,預測房價

])

# 編譯模型

nn_model.compile(optimizer='adam', loss='mse', metrics=['mae'])

# 打印模型結構

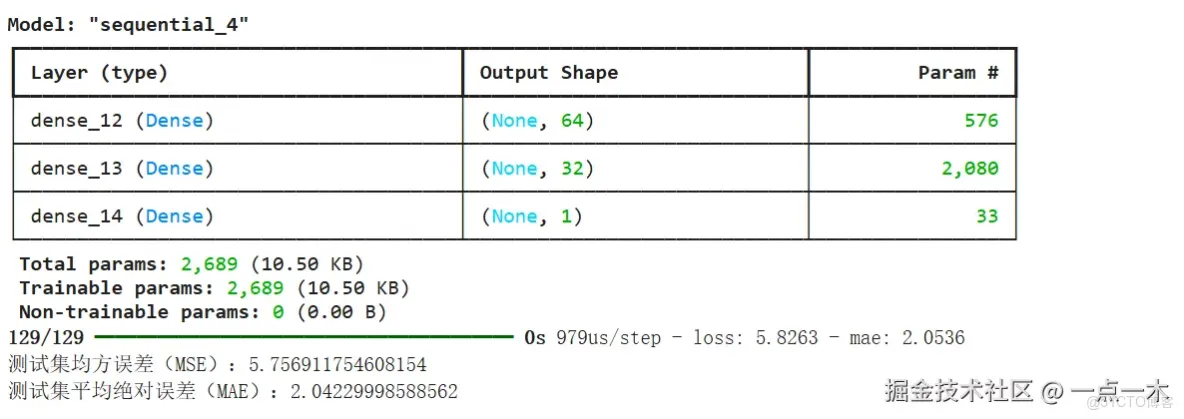

nn_model.summary()運行結果:

Dense:神經網絡中的全連接層,

64表示有 64 個神經元。activatinotallow='relu':激活函數,用於引入非線性,使模型能夠學習複雜的模式。

adam:一種優化算法,可以高效地調整模型參數以最小化損失函數,從而更快地收斂到最佳解。mse:均方誤差(Mean Squared Error),一種用於迴歸任務的損失函數,衡量預測值與真實值之間的平均平方誤差,值越小表示模型預測越準確。

(2) 訓練神經網絡

# 開始訓練

history = nn_model.fit(

X_train, y_train,

epochs=100, # 訓練100輪

batch_size=32, # 每次使用32條數據

validation_split=0.2, # 20%數據用於驗證

verbose=1 # 顯示訓練進度

)epochs:模型在訓練數據上“學一遍”的次數,多次學習可以讓模型表現更好。batch_size:模型一次處理的數據量,32是比較常用的值。validation_split:用一部分訓練數據來測試模型的表現,確保模型沒有隻“記住”數據,而是能學會預測新數據。

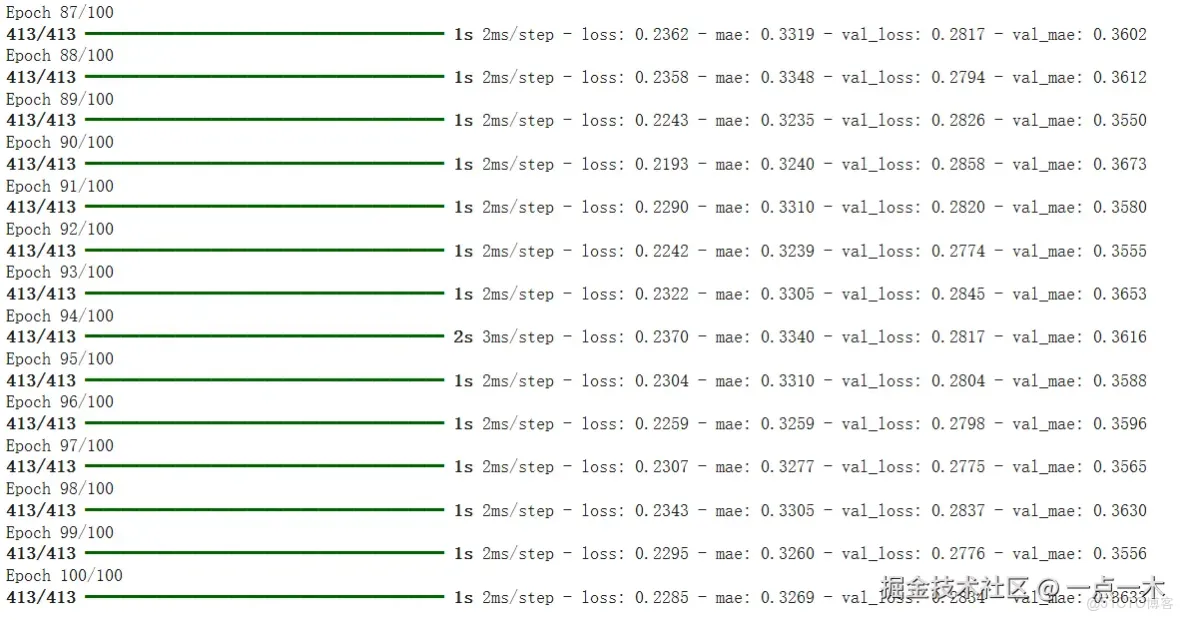

運行結果:

3.測試模型性能

訓練完成後,用測試集評估模型:

# 模型評估

test_loss, test_mae = nn_model.evaluate(X_test, y_test)

print(f"測試集均方誤差(MSE):{test_loss}")

print(f"測試集平均絕對誤差(MAE):{test_mae}")運行結果:

用模型預測房價

# 用測試集數據預測

predictions = nn_model.predict(X_test)

# 顯示部分預測結果

for i in range(5):

print(f"預測值:{predictions[i][0]:.2f}, 實際值:{y_test.iloc[i]:.2f}")運行結果:

預測值:0.11, 實際值:0.48

預測值:0.02, 實際值:0.46

預測值:0.12, 實際值:5.00

預測值:0.18, 實際值:2.19

預測值:0.01, 實際值:2.78解讀預測結果:

- 如果預測值與實際值接近,説明模型的性能較好,能夠準確地進行預測。

- 如果預測值與實際值相差較大,説明模型的預測能力不足。這種情況下,可能需要調整模型參數、改進數據預處理步驟,或者使用更復雜的模型來提升預測效果。

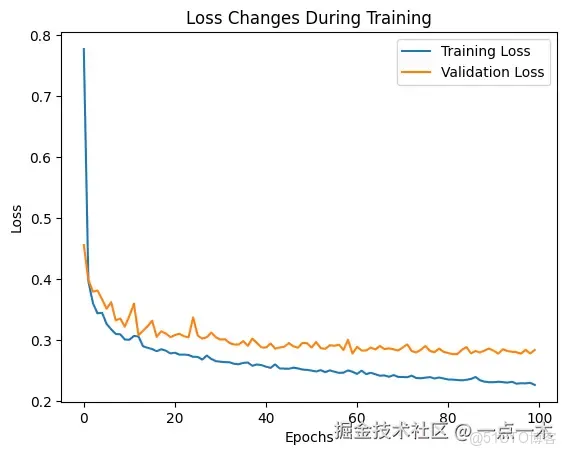

4.可視化訓練過程

訓練過程中,我們可以繪製損失值(Loss)和評估指標(MAE)的變化趨勢,幫助我們判斷模型是否收斂。

import matplotlib.pyplot as plt

# 繪製訓練和驗證損失

plt.plot(history.history['loss'], label='Training Loss') # 訓練損失

plt.plot(history.history['val_loss'], label='Validation Loss') # 驗證損失

plt.xlabel('Epochs')

plt.ylabel('Loss')

plt.legend()

plt.title('Loss Changes During Training') # 訓練過程中的損失變化

plt.show()運行結果:

圖表分析:

- 模型表現良好:如果訓練損失逐漸減小,且驗證損失穩定在較低的水平,説明模型學習效果較好,性能良好。

- 可能存在過擬合:如果訓練損失持續減小,而驗證損失明顯增大,可能表明模型出現過擬合,即模型過度擬合訓練數據,對新數據的泛化能力較差。

六、模型優化

在完成基礎訓練後,我們可以通過以下方法進一步提升模型性能。

1.什麼是過擬合和欠擬合?

- 過擬合:模型在訓練集上表現很好,但在測試集上效果較差,就像考試時只會做練習冊上的題,對新題束手無策。

- 欠擬合:模型在訓練集上的表現也不好,説明它的學習能力不足,連基本規律都沒掌握。

解決方案:

- 正則化:在模型中添加約束(如

L1或L2正則化),限制模型的複雜度,防止過度擬合訓練數據。 - 數據增強:通過對現有數據的變換(如翻轉、旋轉、縮放等)生成更多樣本,提升模型的泛化能力。

- 早停法:監控驗證集的損失,一旦驗證損失開始升高,及時停止訓練,避免過擬合。

2.添加正則化

在模型中添加正則化方法可以有效防止過擬合。例如:

Dropout:通過隨機“關閉”一部分神經元(讓它們暫時不參與計算),減少神經元間的依賴,從而提升模型的泛化能力。

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Dense, Dropout, Input

nn_model = Sequential([

Input(shape=(X_train.shape[1],)), # 顯式定義輸入形狀

Dense(64, activation='relu'),

Dropout(0.5), # 隨機丟棄50%的神經元

Dense(32, activation='relu'),

Dense(1) # 輸出層

])3.調整學習率

學習率是優化器中控制模型參數更新步伐的關鍵參數。

- 學習率過高:可能導致模型無法收斂,甚至出現震盪,無法找到最優解。

- 學習率過低:可能使模型收斂速度過慢,延長訓練時間。

from tensorflow.keras.optimizers import Adam

# 使用較小的學習率

nn_model.compile(optimizer=Adam(learning_rate=0.001), loss='mse', metrics=['mae'])七、構建一個“簡易大模型”

在這一部分,我們將基於深度學習架構,構建一個更復雜的模型,同時應用優化策略以提升性能。

1.增加網絡深度

通過增加隱藏層的數量和每層的神經元規模,模型的表達能力會顯著增強,從而更好地捕捉複雜的模式和特徵關係。但需要注意,增加網絡深度的同時可能導致過擬合,因此需要搭配正則化等策略。

nn_model = Sequential([

Input(shape=(X_train.shape[1],)), # 明確定義輸入形狀

Dense(128, activation='relu'), # 第一隱藏層

Dense(64, activation='relu'), # 第二隱藏層

Dense(32, activation='relu'), # 第三隱藏層

Dense(1) # 輸出層

])2.使用更多數據

當數據量有限時,模型可能難以學習到充分的特徵。以下是兩種有效的解決方法:

- 生成數據:通過數據增強技術(如旋轉、翻轉、縮放等)對現有數據進行變換,生成更多樣本,從而提升模型的泛化能力。

- 遷移學習:利用在大規模數據集上預訓練的模型,將其學習到的特徵遷移到當前任務中,特別適用於小數據集的複雜問題。

3.增加模型參數與層數

“大模型”之所以強大,其核心在於擁有更多的神經元、更復雜的網絡結構和更強的表達能力。增加模型的層數和神經元數量可以有效提升模型性能,但同時也需要注意防止過擬合。

以下是一個包含三層隱藏層的神經網絡示例:

# 構建更深的神經網絡

nn_model = Sequential([

Input(shape=(X_train.shape[1],)), # 使用 Input 層顯式定義輸入形狀

Dense(256, activation='relu'), # 第一隱藏層,256個神經元

Dense(128, activation='relu'), # 第二隱藏層

Dense(64, activation='relu'), # 第三隱藏層

Dense(1) # 輸出層

])

# 編譯模型

nn_model.compile(optimizer=Adam(learning_rate=0.0001), loss='mse', metrics=['mae'])

# 訓練模型

history = nn_model.fit(

X_train, y_train,

epochs=200, # 增加訓練輪數

batch_size=64, # 調整批量大小

validation_split=0.2, # 20%數據用於驗證

verbose=1 # 顯示訓練過程

)4.監控訓練過程

通過使用 EarlyStopping 回調函數,模型可以在驗證損失不再降低時自動停止訓練,從而有效防止過擬合併節省訓練時間。您可以設置 patience 參數,允許驗證損失在指定的輪次內未改善時終止訓練。

from tensorflow.keras.callbacks import EarlyStopping

# 添加早停法

early_stop = EarlyStopping(monitor='val_loss', patience=10, restore_best_weights=True)

history = nn_model.fit(

X_train, y_train,

epochs=200,

batch_size=64,

validation_split=0.2,

callbacks=[early_stop] # 應用早停

)5.數據增強與擴展

當數據量不足以支撐複雜模型時,數據增強是一種有效的策略,可以通過對原始數據進行變換來生成更多樣本,從而提高模型的泛化能力。

(1) 什麼是數據增強?

數據增強是對原始數據進行各種變換(如旋轉、縮放、裁剪、翻轉等),以人為方式擴大數據集規模。它不僅可以提升模型在訓練數據上的表現,還能增強模型對未見數據的魯棒性。

(2) 數據增強示例

以下示例展示瞭如何在圖像分類任務中使用 TensorFlow 的數據增強工具:

from tensorflow.keras.preprocessing.image import ImageDataGenerator

# 定義數據增強器

datagen = ImageDataGenerator(

rotation_range=20, # 隨機旋轉角度

width_shift_range=0.1, # 水平平移

height_shift_range=0.1, # 垂直平移

horizontal_flip=True # 水平翻轉

)

# 對訓練數據應用數據增強

datagen.fit(X_train)非圖像數據增強

對於非圖像數據(如表格或時間序列數據),可以採用其他數據增強方法,例如:

- 添加隨機噪聲:在原始數據上加入少量隨機噪聲,模擬更多樣本。

- 隨機變換:對原始數據的特徵進行隨機縮放、平移等操作。

-

# 添加隨機噪聲

def add_noise(data, noise_level=0.1):

noise = noise_level * np.random.normal(size=data.shape)

return data + noise

# 應用噪聲增強

X_train_augmented = add_noise(X_train)6.模型訓練性能加速:使用 GPU/TPU

深度學習模型的訓練可能非常耗時,尤其是在處理“大模型”時。使用 GPU(圖形處理器)或 TPU(張量處理器)可以顯著加速訓練過程。

(1) 確保安裝CUDA 和 cuDNN

如果使用 NVIDIA 顯卡,請確保安裝以下工具:

CUDA Toolkit:支持GPU加速計算。cuDNN:深度學習專用的高效庫,優化神經網絡運算。

(2) 檢查 GPU 是否可用

import tensorflow as tf

print("GPU 是否可用:", tf.config.list_physical_devices('GPU'))(3) 使用 Google Colab

如果你沒有本地 GPU,可以使用 Google 提供的免費 Colab 環境進行訓練:

- 打開Google Colab。

- 點擊頂部菜單中的 “

Runtime” (運行時),選擇 “Change runtime type” (更改運行時類型)。 - 在硬件加速器中選擇

GPU,然後保存設置。 - 直接運行你的代碼,即可使用免費的

GPU算力進行訓練!

提示:

Google Colab提供的GPU算力適合中小型模型訓練,適用於快速實驗或學習場景。

八、模型部署

訓練好模型後,你可能會問:“如何讓我的 AI 模型在真實場景中運行?” 模型部署 就是讓模型從代碼中走出來,變成實際可以使用的服務或工具。

1.保存與加載模型

TensorFlow 提供了簡單的接口來保存模型,以便後續使用或部署。以下是保存和加載模型的示例:

# 保存模型

nn_model.save('my_ai_model')

# 加載模型

from tensorflow.keras.models import load_model

loaded_model = load_model('my_ai_model')2.使用 Flask 構建 API 服務

通過 Flask 框架,可以將模型部署為 API 服務,接收 HTTP 請求並實時返回預測結果。以下是具體的實現步驟:

(1) 創建 API 服務

使用 Flask 創建一個簡單的服務,加載訓練好的模型,處理用户輸入並返回預測結果。

from flask import Flask, request, jsonify

import numpy as np

from tensorflow.keras.models import load_model

# 加載模型

model = load_model('my_ai_model')

app = Flask(__name__)

@app.route('/predict', methods=['POST'])

def predict():

data = request.json

features = np.array(data['features']).reshape(1, -1)

prediction = model.predict(features)

# 返回預測結果

return jsonify({

'success': True,

'prediction': float(prediction[0][0]) # 將預測值轉換為浮點數返回

})

if __name__ == '__main__':

app.run(debug=True)(2) 測試 API

啓動 Flask 服務後,可以使用 Postman 或其他 HTTP 客户端工具(如 curl 或瀏覽器擴展)來發送請求,驗證 API 是否正常工作。

POST /predict

{

"features": [0.1, -0.2, 0.5, 0.3, 0.7, -1.1, 0.4, 0.9, 1.0, -0.5, 0.8, -0.6, 0.3]

}返回示例:

{

"success": true,

"prediction": 24.56

}3.使用 Streamlit 構建可視化界面

Streamlit 是一個易用的 Python 工具,可以快速構建數據可視化應用,非常適合將機器學習模型部署為交互式界面,供用户實時輸入和查看預測結果。

Streamlit 的優勢

- 簡單直觀:無需前端開發知識,直接用

Python編寫,幾行代碼即可實現完整應用。 - 快速開發:支持實時刷新和交互式組件,適合快速原型開發。

- 支持豐富功能:內置輸入框、文件上傳、圖表繪製等多種組件,滿足數據應用需求。

import streamlit as st

import numpy as np

from tensorflow.keras.models import load_model

# 加載模型

model = load_model('my_ai_model')

# 設置標題

st.title("House Price Prediction") # 房價預測模型

# 輸入特徵值

features = []

for i in range(13):

features.append(st.number_input(f"Feature {i+1}"))

if st.button("Predict"):

# 使用模型進行預測

prediction = model.predict(np.array(features).reshape(1, -1))

st.write(f"Predicted Price:{float(prediction[0][0]:,.2f)}")運行 Streamlit:

streamlit run app.py結語

通過本教程,你已經完成了從零開始構建 AI 模型的完整流程。我們從 AI 的基礎概念入手,學習瞭如何準備數據、訓練模型、優化性能,以及將模型部署為實際應用。這不僅讓你掌握了機器學習的核心技能,也為你進入更廣闊的 AI 世界奠定了基礎。

這一過程中,你瞭解瞭如何選擇合適的算法、解決實際問題,以及將 AI 融入應用場景。最重要的是,你體驗了從構思到實現,再到部署的完整開發鏈路,這正是 AI 項目的精髓所在。

雖然教程內容只是冰山一角,但它已經為你打開了 AI 的大門。未來,你可以探索更復雜的模型、更大的數據集,或者將這些知識應用到真實場景中,創造屬於你的 AI 作品。

學習 AI 是一個持續進步的過程,而今天,你已經邁出了第一步。未來,AI 的可能性無限,希望你在這條路上越走越遠,用 AI 技術改變生活、創造價值!