Abstract

隱式神經表示 (INR) 已成為使用神經網絡將離散信號編碼為連續、可微函數的強大工具。然而,不幸的是,這些模型通常依賴單體架構來表示高維信息,隨着維度的增長,導致計算成本過高。我們提出了 F-INR,這是一個框架,它依據函數張量分解重新制定 INR 學習,將高維任務分解為輕量級的、特定於軸的子網絡。每個子網絡學習一個低維資料組件(例如,空間或時間)。然後,我們藉助張量運算組合這些組件,降低前向傳遞的複雜性,同時通過專業學習提高準確性。F-INR 是模塊化的,因此與架構無關,與 MLP、SIREN、WIRE 或其他最先進的 INR 架構兼容。它還與分解無關,擁護 CP、TT 和 Tucker 模式,並具有用户定義的等級以進行速度精度控制。在我們的實驗中,F-INR 在視頻任務上的訓練速度比現有方法快 100×,同時實現更高的保真度 (+3.4 dB PSNR)。圖像壓縮、物理模擬和 3D 幾何重建也具有類似的收益。通過這種方式,F-INR 為高維信號建模提供了一種新的可擴展、靈活的解決方案。

1. Introduction

隱式神經表示(INRs)是離散信號(如圖像[60, 61, 76]、視頻[4, 7, 17, 80]、三維場景[5, 22, 42, 43]和幾何形狀[35, 47])的連續、函數式表示。通過神經網絡達成,這些方法將離散結構化內容映射到連續的函數空間中,便於進行平滑插值。這種通用性促進了架構設計和實際應用的進步[42, 47, 53, 57]。與離散的基於網格的表示相比,連續參數化具有諸多優勢,包括更高的內存效率、能夠在無界域上定義以及分辨率不變性[13]。具體來説,這種方法能夠捕捉到細節,其分辨率由網絡的容量和表達能力決定,而不是由網格決定[57]。此外,這些表示的可微性在利用自動微分計算梯度和高階導數方面發揮着關鍵作用,這對於逆向建模是相關的[55, 56, 67]。

另一種表示多維數據的形式是張量分解,通常用於信號和圖像處理與分析[2, 3, 29, 30, 58, 63, 70, 79]。它將高維信號建模為低秩、低維成分的組合。然而,這些途徑侷限於離散網格設置,限制了它們的適用性。

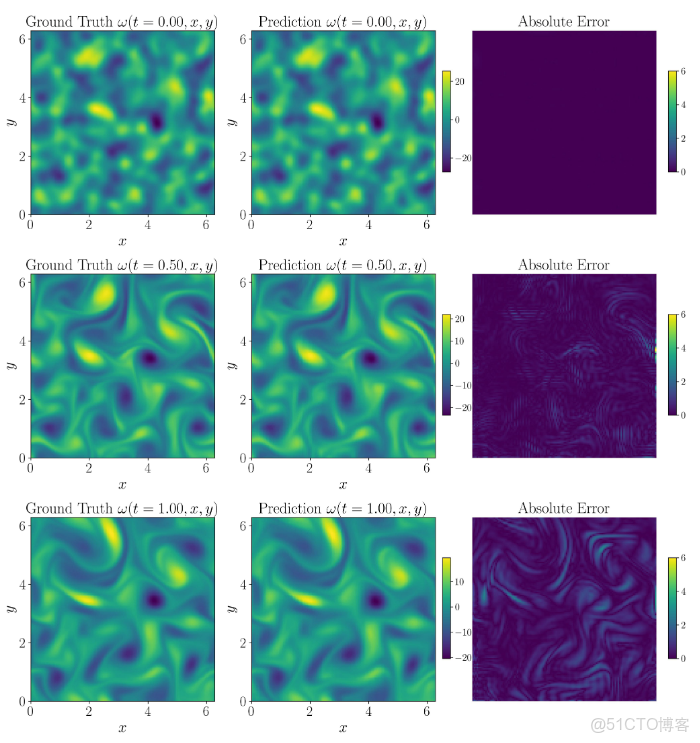

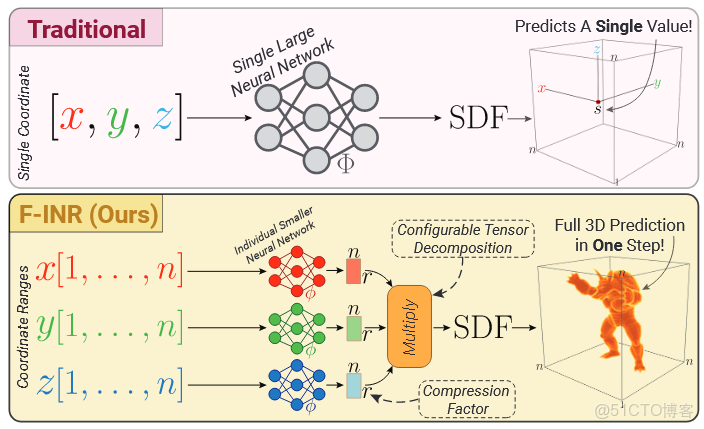

圖 1 .通過函數張量分解實現高效的 INR:INR 模型使用單個大型網絡一次預測一個值(一批值)。我們的方法將函數分解為更小的網絡,經過可配置的張量分解模式和壓縮等級,在單個步驟中完成全面預測

INR和張量分解各有優勢,將它們結合起來可以高效地表示麻煩數據。因此,我們提出了F-INR,這是一種利用張量分解優勢的INR重新表述。F-INR使用專門的單變量神經網絡來學習INR的可變分離形式,通過促進低維成分的使用,保留了連續表示的好處。圖1CP[20]、TT[45]和Tucker[64]。我們在各種INR實驗中建立了多功能性,包括圖像和視頻編碼、通過SDFs的形狀表示以及用於超分辨率的物理模擬編碼。F-INR在訓練速度(高達100倍)、特定任務的指標和定性結果方面優於傳統的INR。這表明,除了網絡架構修改之外,還可以實現改進。就是提供了這種設置的一般説明。在這項研究中,我們專注於將神經網絡與三種張量分解技術結合起來,特別

總結來説,大家的主要貢獻有四個方面:

- 通過函數張量分解對INR進行了新的表述,為連續信號表示提供了新的視角。

- F-INR框架,它利用三種特定的分解模式與現有的網絡架構相結合,提供了靈活且高效的建模方式。

- 在關鍵的INR應用中對F-INR的強大性能進行了實證展示。

- 開源我們的框架,以推動F-INR研究領域的發展。

2. Related Work

隱式神經表示(INR)經歷了幾個發展階段。最初的想法引入了明確的座標機制,如位置編碼[42]和隨機傅里葉特徵映射[62],以提高多層感知機(MLP)的表示能力。隨後的研究集中在激活函數和模型架構上:SIREN引入了正弦激活函數[57],WIRE引入了Gabor小波激活函數[53],InstantNGP引入了基於哈希的編碼[43]。值得注意的是,這些途徑顯著增強了INR的表達能力。最近的研究是應用驅動的,例如數據壓縮[13, 17, 61]、計算機視覺[1, 4, 9, 15, 47]、圖形學[35, 42, 44, 55, 56, 77]和機器人學[6, 33, 54]。

張量分解將高維數據表示為較小因子的組合。經典的分解形式將數據拆分為模態成分[20, 29, 30, 45, 64]。早期的研究應用了固定的函數基(例如,高斯、傅里葉或切比雪夫展開)來在連續域中表示每個因子[18, 27, 76],但這些方法的表達能力有限。最近的辦法採用神經網絡作為可學習的函數基,將深度學習與張量分解結合起來以克服這一限制。例如,一些方法用神經網絡替換了手工製作的成分(Tucker因子或PCA/SVD向量)[8, 10, 24, 52]。在物理信息學習中,張量分解被用於通過將解拆分為低維神經成分來求解偏微分方程(PDE)。這帶來了更快的訓練速度和更高的準確性[11, 26, 66, 68]。然而,據我們所知,沒有先前的工作以一般的方式將INR與函數張量分解統一起來。

對於INR的張量分解最近作為一種結合了低秩張量分解與INR特定應用(如NeRF[42])的方法出現。像TensoRF這樣的工作將輻射場分解為緊湊的低秩成分[5, 22]。這建立了快速且內存高效的視圖合成,這是一種有效但特定於領域的解決方案。此外,MLP不是直接用於學習張量分解的成分,而只是用於特徵解碼。同樣,CoordX為每個座標維度使用了分割的MLP和低秩表示[34]。它們在更深的層中被融合,省略了不同的分解模式。使用MLP來表示低秩張量函數(而不是固定的基)在像[38, 39, 69]這樣的工作中被提出。它們連續地表示多維內容,實現了最先進的圖像修復和點雲上採樣[38, 39, 69]。

F-INR將先前的方法統一併概括為一個單一的、模塊化的範式。類似於CoordX[34],分離的MLP處理專門的輸入維度,利用較小的子網絡來提高效率。它包含了在LRTFR[22]或TensoRF[5]中發現的低秩結構,減少了冗餘,同時保留了表達能力[11, 66]。與這些辦法不同,F-INR不受限於特定的張量分解或應用領域。它本身支持幾種分解模式和可適應任務數據結構的秩。由於F-INR與後端無關,它受益於架構方面的進展,如SIREN[57]或傅里葉特徵[62],並使結構化的INR表示更具模塊化、可擴展性、效率和多功能性,適用於許多任務。

3. Functional Tensor Decomposition for INRs

真實世界的信號,如圖像或視頻,必須以離散的值網格形式存儲。這些離散化的信號是d維和c變量的,面臨分辨率和內存的限制。神經網絡憑藉建模這些信號的連續版本提供瞭解決方案,稱為隱式神經表示(INR),它們既與分辨率無關又具有內存效率。因此,INR任務是一個函數

:

,這裏由神經網絡

:

估計,將座標向量

映射到c變量輸出信號。

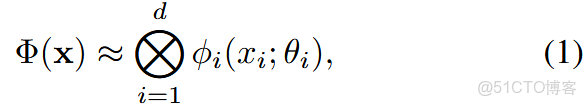

我們反而提出將問題重新表述為d個較小神經網絡的張量積:

其中

表示第 i 維的單變量神經網絡,具有可學習的參數

。每個網絡產生一個特定秩的張量,通過經典的張量分解模式[20, 45, 64],記為⊗,來恢復原始信號。分解張量具有連續函數作為基[68],該辦法被認為是功能性張量分解。因此,大家的重新表述引入了功能性INRs(F-INRs)的概念。

通過兩個更多的超參數:就是值得注意的是,這種方法是模型無關的,任何最先進的INR架構都能夠作為後端,繼承其優勢[42, 53, 57, 62]。我們的方法模式和秩。模式指的是應用的張量分解類型。在這項研究中,我們考慮了張量理論中三種已建立的模式:

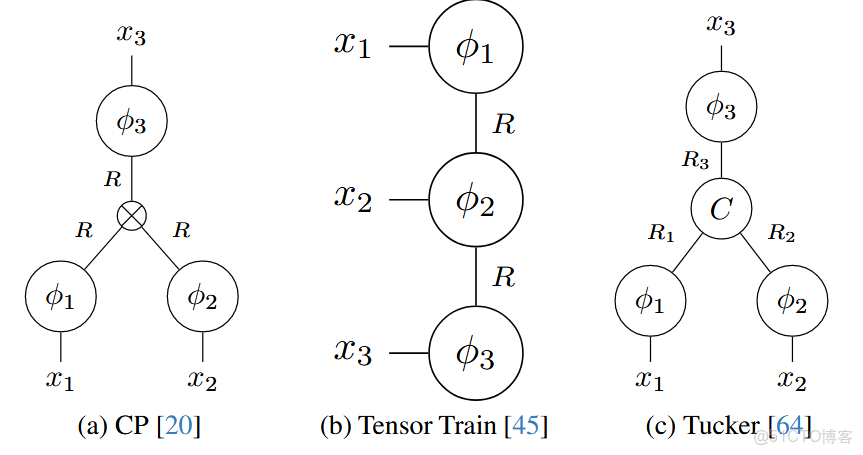

1.正多元分解(CP)[20]涉及將d維張量分解為d因子矩陣,秩為R,如圖2a所示。

2. 張量序列分解(TT)[45]涉及d個連接鏈(列車)的低秩張量,如圖2b所示。

3. Tucker分解[64]與CP類似,利用因子矩陣分解張量。不過,它還包括一個較小的核心張量C,捕捉每個模式組件之間的交互,如圖2c所示。

下一個可選參數是秩,它指定了分解的秩,並決定了模型可能學習的表達性和複雜性。這種後端、模式和秩的組合為特定應用需求的複雜性、壓縮和性能提供了精確控制。

圖2三種分解的張量圖(a)-(c):該示意圖[29,48]將每個圓描述為一個分量,輻條決定其尺寸。輻條連通性表明瞭如何進行分解以及如何獲得原始張量。在 F-INR 中,每個組件都由單獨的神經網絡學習。補充中提供了更多的可視化和數學公式。

3.1. Advantages

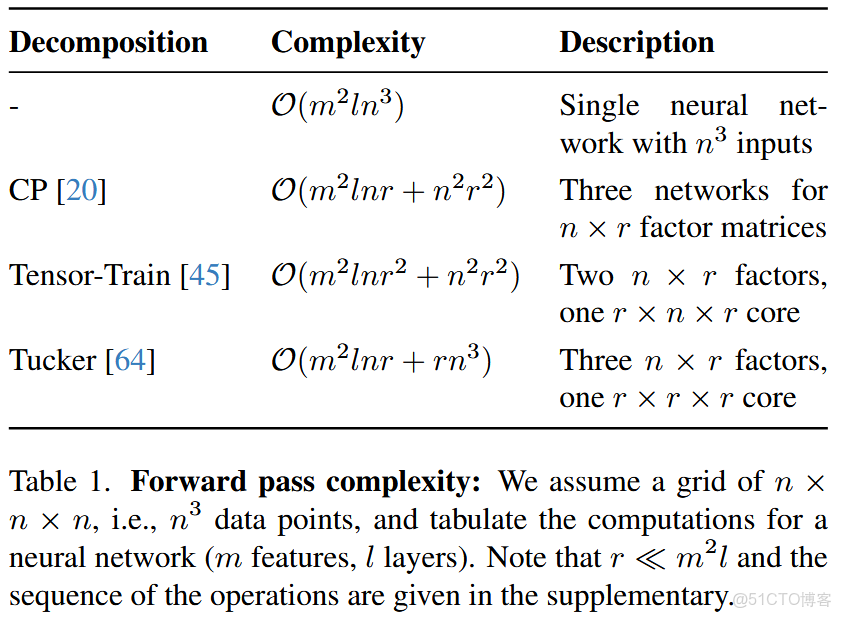

F-INR通過採用有用的變量分離方法來緩解維度災難,這使得高維函數的有效表示成為可能[16, 21, 78]。最近的研究已經證明,依據張量分解形式連接的多個神經網絡是通用逼近器[11, 26, 68]。即使不存在精確的、可分離的解決方案,足夠大的秩也可以逼近解決方案,利用神經網絡的通用逼近能力[68]。先前的研究[16, 21, 49]表明,函數逼近所需的參數數量隨着維度的增加而呈指數增長,這阻礙了神經網絡學習高維函數的能力。

這在F-INR中得到了緩解,它採用了分而治之的方法,其中每個神經網絡學習一個低維函數,聚合這些函數以重建完整的高維函數。我們方法的另一個好處是,在一個網格(

)上的點訓練的案例在前向傳遞期間只需要

個內容點。這導致了顯著的加速,這在每個模式的前向傳遞的複雜性中顯而易見;對於d = 3的例子,見表1。

4. Experiments

我們評估了功能性張量分解(FTD)方法在提高計算效率和準確性方面對不同應用中隱式神經表示(INR)問題的性能。我們在實驗中研究了關鍵參數對F-INR的影響,以展示我們方法的通用性:

- 後端:學習分解組件的神經網絡架構。

- 模式:特定的張量分解技術。

- 秩:分解張量組件的秩。

我們選擇了標準的基於ReLU的多層感知機(MLP)[41],以及有無位置編碼(PE)[42]的版本。此外,我們使用了SIREN [57],它利用週期性激活和專門的初始化,以及WIRE [53],它結合了自定義的Gabor小波激活。這些後端在廣泛的INR應用中被認為是表現最好的方法。我們測試了三種張量分解模式在不同INR挑戰任務中的適用性:正多元分解(CP)[20]、張量序列(TT)[45]和Tucker [64]。在我們的所有實驗中,我們評估了不同組合模式和後端在各種秩下的性能。評估指標包括特定領域的度量,如用於編碼圖像和視頻的峯值信噪比(PSNR),以及與未壓縮原始記錄的比較。對於物理模擬,我們運用真實值和預測之間的L2誤差;對於採用符號距離函數(SDFs)進行幾何學習的交併比(IoU)。此外,我們還提供了每次實驗的訓練時間。我們將結果與沒有張量分解的相同後端的基線版本進行比較,利用一致的超參數以確保觀察到的改進是由於功能性張量分解。我們使用具有三個層的標準MLP架構,每層有256個特徵,並使用Adam [28]進行50,000次迭代訓練,除非另有説明,否則進行十次獨立運行。我們在本節中呈現關鍵結果,補充材料中提供了不同秩、模式和後端的額外消融研究。訓練時間是在NVIDIA GTX 1080上測量的,證明了F-INR即使在中等硬件上也能實現快速且計算效率高的公式,並且不需要依賴於適應和定製的硬件內核[43]。

4.1. Image and Video Encoding

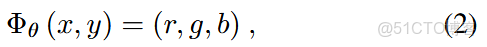

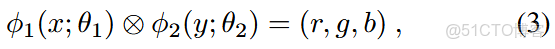

訓練兩個單變量神經網絡,每個網絡負責一個空間維度,以學習更小的圖像塊。它們的矩陣乘積重建原始圖像。在傳統的INR設置中,圖像表示為:就是我們首先通過展示F-INR在編碼圖像中的應用來開始。圖像是二階張量;一個簡單的矩陣分解模式就足夠了。我們不是使用單個神經網絡來表示整個圖像,而

其中

表示網絡,(x, y)是像素座標,(r, g, b)代表像素顏色值。相比之下,我們學習圖像的方式為:

其中⊗運算符表示矩陣乘法。這裏,x和y是圖像座標;輸出是像素顏色。

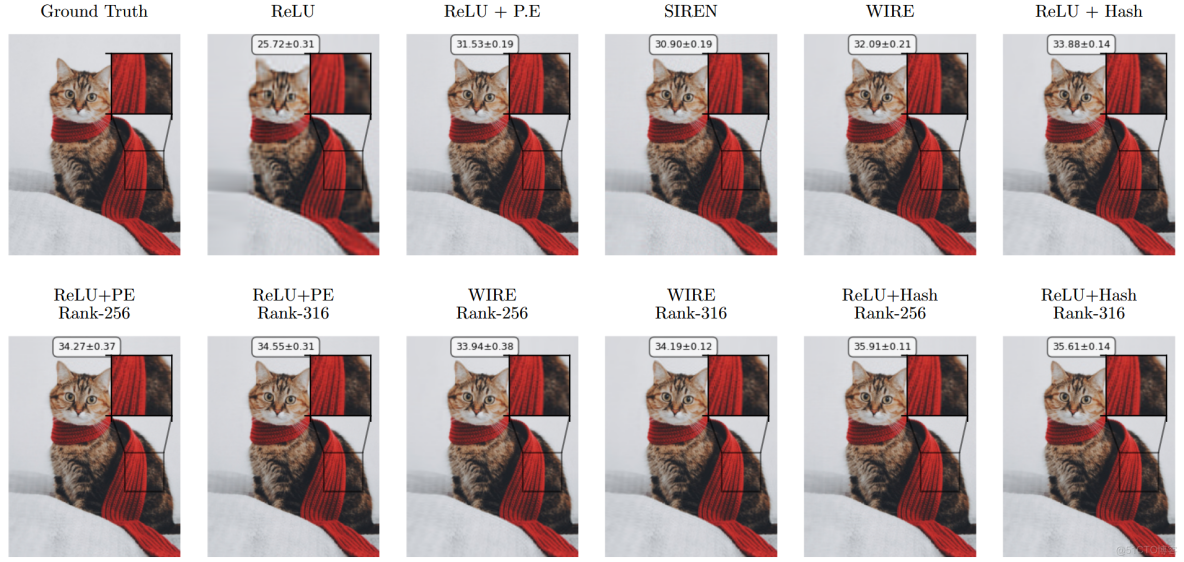

精細圖案的圍巾和鬍鬚。編碼圖像及其各自的PSNR(以dB為單位)值表明,基於F-INR的表示在相同的後端架構下實現了更高的PSNR,同時在計算效率上給予了就是大家選擇了一張公開可用的貓的圖像,其特徵100倍的速度提升。圖3展示了真實圖像和編碼圖像。詳細的數值結果可以在表2中找到。我們還包括了LIIF [76],它使用像素的鄰近信息作為基線進行圖像編碼。此外,DeepTensor [52]類似於使用ReLU後端。我們還採用了基於哈希的編碼 [43] 作為額外的後端。請注意,我們沒有依賴於用於哈希編碼的CUDA內核 [43]。為了確保運行時間的公平比較,我們的完成細節遵循了原始算法[43]。我們將圖像編碼框架應用於單圖像超分辨率和圖像去噪等任務。這展示了F-INR如何受到後端強大架構屬性的影響,以及我們如何在其基線實現上進行改進,詳細內容見補充材料。

圖 3.圖像編碼的 F-INR:此處表現了圖像編碼的可視化效果,以及插圖中的 PSNR (dB) 值。所有第一行圖像都沒有使用任何分解,第二行是不同後端和等級的圖像的 F-INR。此處介紹了 PSNR 最高的組合。其他結果見補充

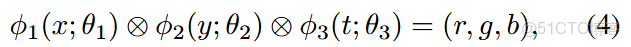

我們將實驗擴展到視頻編碼,沿用之前的方法,但增加了一個時間維度。具體來説,表示為:

其中 t 表示時間維度(幀索引)。我們為這項任務採用了所有指定的張量分解模式。我們啓用一個256×256分辨率的人物視頻[80],包含300幀,面部表情和頭部動作變化如圖4利用使用哈希編碼對空間網絡就是所示。F-INR的模塊化特性允許靈活地整合不同的編碼策略和網絡後端,優化任務性能。與單一的、受限於固定編碼或架構的單一神經網絡不同,F-INR協助即插即用的方法,其中不同的編碼可以針對特定維度進行定製。此種適應性在這裏得到了體現。最佳性能

、

和傅里葉特徵對時間網絡

進行編碼實現的,利用每種編碼在其各自領域的優勢。我們不包括現有的基於神經網絡的視頻壓縮算法,如NeRVs或COIN++ [7, 13, 40]。這些算法涉及視頻的逐幀學習和隨後的神經網絡量化。定量結果在補充材料中提供。

圖 4.啓用F-INR對具有細微面部特徵的視頻進行編碼[80](公開):平均PSNR(dB)和模型顯示在第一列中;訓練時間在結果。SIREN [57] 和 ReLU [41] 具有位置編碼 [42] 的表現優於其基線,捕捉面部細節並保持時間一致性,而 WIRE [53] 的表現更差。最佳性能(第五行)分別使用哈希[43]和空間和幀維度的位置編碼相結合,突出了F-INR的模塊化。其他結果見補充

4.2. Signed Distance Functions for Geometries

符號距離函數(SDF)是一個連續函數,它為3D空間中的每個點分配一個相對於最近表面點的值。雖然從點雲學習和解決Eikonal偏微分方程(PDE)以獲得SDF已經取得了顯著成功[47, 53, 57],但使用體素網格進行SDF學習仍然是一個相對較少探索的領域。體素網格提供了結構化和密集的表示,使其特別適合得空間一致性和高效3D卷積的應用[36, 74, 75]。

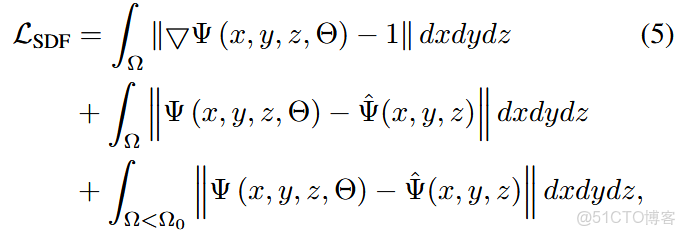

大家利用F-INR來解決Eikonal PDE,並直接從基於體素網格的SDF數據中學習幾何表示,基於[15, 46, 47, 57]的基礎公式。我們的損失函數定義為:

其中Ω表示學習SDF Ψ的空間域。損失函數由三個部分組成。第一項執行Eikonal PDE約束。第二項最小化預測SDF值Ψ和域Ω內的真實值Ψ̂之間的差異。第三項優先考慮在指定閾值Ω < Ω_0內的表面附近的數據點。根據[59],我們將SDF值截斷到0.1的閾值之外。

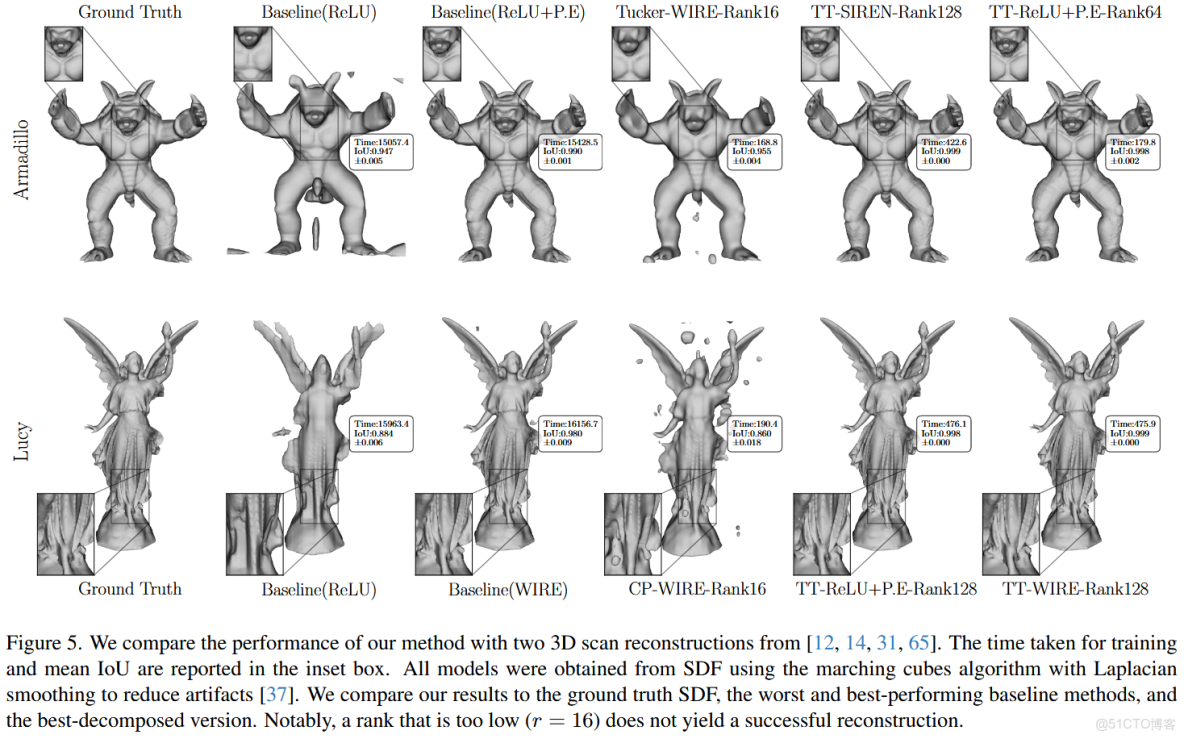

為了評估F-INR在幾何形狀上的性能,我們使用了來自Stanford 3D Scan Repository的模型[12, 14, 31, 65]。我們選擇了一組具有困難幾何形狀和不同細節級別的對象,為評估我們基於SDF的方法的準確性和效率供應了一個穩健的測試。實驗啓用了相同的底層模型架構、基線配置和分解秩,這些在更廣泛的實驗部分中有所描述。我們沒有在這項任務中使用哈希編碼,因為它缺乏全局可微分性,使其不適合要求良好梯度的應用.

圖 5,秩太低 (r = 16) 不會產生成功的重建。就是.大家將我們的方法的性能與[12,14,31,65]中的兩個3D掃描重建進行了比較。訓練所需的時間和平均 IoU 報告在插入框中。所有模型都是使用行進立方體算法和拉普拉斯平滑從SDF獲得的,以減少偽影[37]。我們將我們的結果與地面實況 SDF、最差和表現最好的基線途徑以及最佳分解版本進行了比較。值得注意的

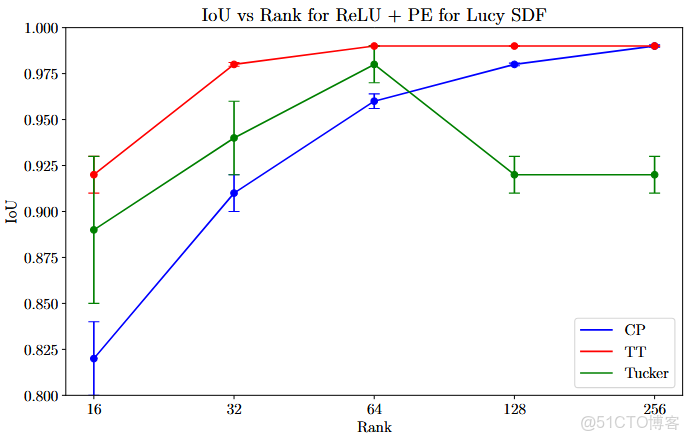

如圖5所示,F-INR生成了更詳細和準確的對象表示。所有學習到的SDF體素網格都是使用相同的行進立方體算法設置獲得的結果[37]。在補充材料中提供了原始學習到的SDF結果的概述,並與其他方法如DeepSDF[47]和IGR[15]進行了進一步比較。為了比較不同的模式,我們為Lucy SDF改變了秩和模式,運用了表現最佳的後端,如圖6顯著的,性能在秩達到64時有所提升,並在此之後保持不變。所有後端、模式和幾何形狀的額外結果在補充材料中提供。就是所示。結果表明,張量序列(Tensor-Train)在穩定性和準確性指標上都優於其他方法,這歸因於其連接結構[45]。有趣的是,隨着秩的增加,Tucker模式的性能變差,這歸因於其大核心,如[29, 45, 70]中解釋的那樣,形成了一個瓶頸。大家還觀察到,對於TT模式,秩的影響

圖6.後端所有張量分解模式的 IoU 與 Rank 的關係 ReLU + 學習 Lucy SDF 的位置編碼。張量訓練優於其他兩種模式,而塔克模式會降低較大等級的性能。相比之下,TT模式表現出穩定的性能,秩的增加

4.3. Super Resolution of Simulations

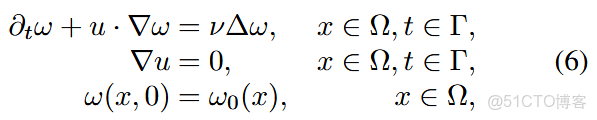

高保真模擬計算量大,通常受到傳統數值方法分辨率的限制。即使物理信息神經網絡(PINNs)[50, 68] 是一個有前景的替代方案,但它們在增加配點數量或處理複雜模擬時也面臨可擴展性挑戰[32, 71, 72]。因此,兩種途徑之間的權衡是有幫助的:粗略模擬對於數值辦法更易訪問,而INRs允許利用PINN損失學習無分辨率限制的形式。我們的方法,F-INR,採用低分辨率數據和物理信息損失函數進行訓練。我們在一個具有精細渦旋耗散細節的數據集上,通過一個衰減湍流模擬來驗證這種方法。我們根據真實高分辨率基準和我們預測的高分辨率輸出之間的L2誤差來評估性能。模擬的偏微分方程(PDE)是不可壓縮Navier-Stokes方程的渦度形式[73],表達為:

其中

表示速度場,

是渦度,

表示初始渦度,

是粘性係數。空間域是

,時間域是

。原始數據集的分辨率為

。我們使用分辨率較低的

來訓練我們的F-INR模型,這對應於大約40倍的稀疏性。我們的損失函數定義為:

其中

對應於在粗略模擬內容上計算的損失,而

是物理信息損失項,用於執行方程(6)中的PDE約束。值得注意的是,我們不需要諸如時間步進[32]等技術,這些技術將域劃分為更小的時間間隔,因為我們在整個域中學習解決方案。

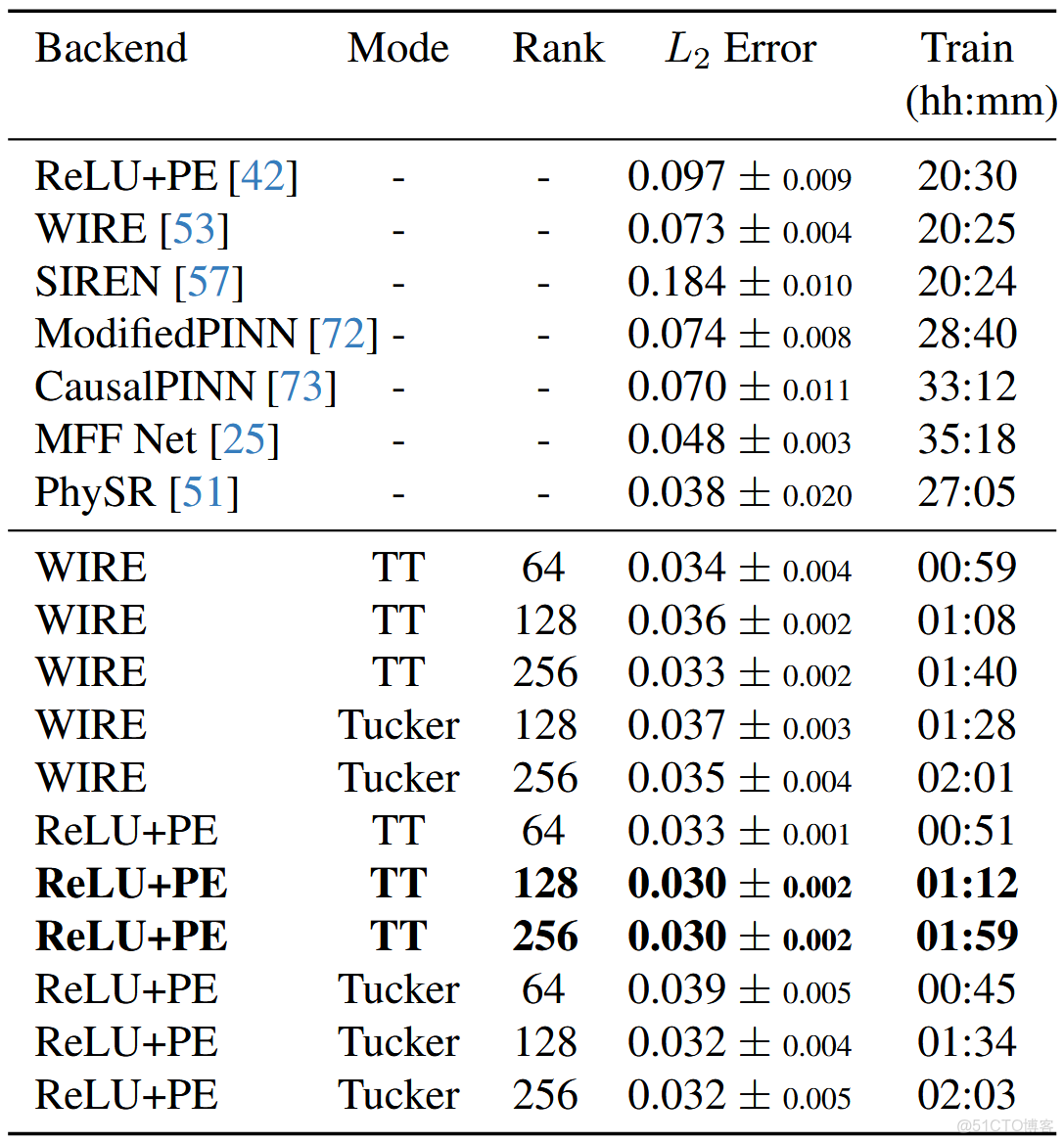

表 3.比較 F-INR 的 L2 誤差和使用 Navier Stokes 方程進行衰減渦度超分辨率模擬的基線完成。我們在這裏只列出了平均 L2 誤差小於 0.04 的最佳性能設置,所有設置都優於基線實施(保留在補充材料中)。F-INR 始終表現出色,L2 誤差和收斂時間更短。除了稀疏數據外,我們每維採樣200個點用於共定位以計算物理信息損失。我們結果的

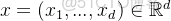

誤差在表3通過專門為模擬超分辨率開發的。我們的發現表明,就是中呈現。我們將結果與諸如Modified PINNs [72] 和 CausalPINNs [73] 等架構進行比較,這些架構旨在增強原始PINN公式,並能夠直接應用於超分辨率任務。我們還與MeshFreeFlowNet [25] 和 PhySR [51] 進行比較,這些架構F-INR始終提供更快和更好的解決方案。我們還希望強調,這項工作是首次展示WIRE [53] 在物理模擬場景中的適用性。圖7中展示了一個代表性解決方案,它比較了F-INR使用模式TT、後端WIRE和秩128在高保真數據上訓練後的預測渦度。這裏僅展示了表現最佳的F-INR結果。各種秩、後端和稀疏度級別的消融研究在補充材料中提供。

圖7.F-INR-TT 線等級 128 在時間步長 0.0(開始)、0.5(中間)和 1.0(結束)處的渦度可視化。第一列是地面實況渦度,第二列是根據粗略數據和底層納維-斯托克斯偏微分方程訓練的預測高保真渦度。最後一列是基礎事實和預測之間的絕對逐點誤差。大家看到,在不採用時間行進方案的情況下,基本事實和預測之間高度一致[32]

5. Limitations and Future Directions

儘管F-INR提供了幾個優勢,但它目前僅限於結構化數據格式,這使得將其應用於點雲或光線追蹤等非結構化場景變得具有挑戰性。與結構化網格不同,非結構化數據需要特定於應用的修改,這通常會增加計算複雜性[5, 38]。在這種情況下調整我們的框架將需要將單個內容點映射到額外的張量組件,降低前向傳遞效率。就算該方向很有前景,但它應該進一步研究以平衡效率和表示質量,我們將其留待未來研究。

探索更具有表現力的張量分解,例如張量環或拓撲感知張量網絡[29, 30],以增強壓縮-準確性權衡。探索自適應秩選擇技術以實現自動複雜性控制也很有趣。此外,將張量分解與基於CUDA的優化(如InstantNGP [43]中所見)集成,可以進一步加速推理,同時保留結構化表示的好處。就是另一個有趣的方向

最後,我們的工作在很大程度上仍然是經驗性的。雖然分解神經網絡是有效的通用逼近器[11, 19, 26, 68],但需要更深入的理論見解來更好地理解張量分解如何影響基於座標的隱式神經表示的表達能力和效率。

6. Conclusions

我們介紹了基於功能性張量分解的隱式神經表示(F-INR),這是一個統一張量分解與隱式神經表示的框架,用於高效的高維函數建模。依據利用單變量神經網絡來學習低維組件,F-INR緩解了維度災難並加速了訓練。

F-INR的一個關鍵優勢是其模塊化。與單一的INR不同,它無縫集成了各種張量分解(CP、TT、Tucker)和神經架構(具有位置編碼的ReLU、哈希編碼、SIREN、WIRE)。這種靈活性允許輕鬆適應新的分解策略和網絡後端。

我們的實驗表明,在訓練速度(高達100倍)和準確性方面都有顯著提高,涵蓋了包括圖像和視頻編碼、基於PDE的超分辨率和基於SDF的幾何編碼在內的任務。雖然目前僅限於結構化數據,但將F-INR擴展到非結構化設置是一個有前景的方向。這項工作為通過橋接張量分解與隱式神經表示來進一步推進可擴展高維函數學習奠定了基礎。

![\Omega \in [0, 2\pi]^2 乾貨分享 | 深度學習零基礎進階第二彈 -_數據_31](/file/story/attachments/image/l/cdaafb2b-fb39-43a0-b83b-e66277115dd7)

![\Gamma \in [0, 1] 乾貨分享 | 深度學習零基礎進階第二彈 -_數據_32](/file/story/attachments/image/l/5f93debb-76fc-4c2f-a462-7023c4a4caee)