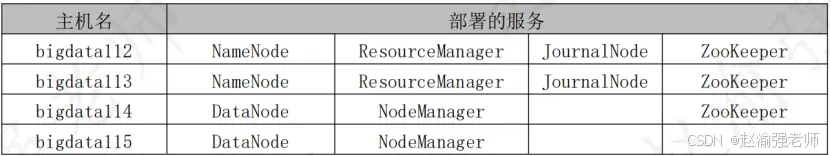

由於在HA架構中包含的節點比較多,在進行實際部署的時候需要做好集羣的規劃。圖14.9一共使用了4個節點來部署HDFS HA,它們分別是:bigdata112、bigdata113、bigdata114和bigdata115。由於Hadoop默認包含了HDFS和Yarn,因此在部署HDFS HA的時候,也可以同時部署Yarn的HA。每個節點上部署的服務如下表所示:

視頻講解如下:

https://www.bilibili.com/video/BV194421S7oL/?aid=1755958606&c...

基於已經部署好的ZooKeeper集羣的部署,這裏直接從Hadoop HA的部署開始。

(1)在每個節點增加以下環境變量。

export HDFS_JOURNALNODE_USER=root

export HDFS_ZKFC_USER=root

export HDFS_DATANODE_USER=root

export HDFS_DATANODE_SECURE_USER=root

export HDFS_NAMENODE_USER=root

export HDFS_SECONDARYNAMENODE_USER=root

export YARN_RESOURCEMANAGER_USER=root

export YARN_NODEMANAGER_USER=root(2)修改bigdata112節點上的hadoo-env.sh文件。

export JAVA_HOME=/root/training/jdk1.8.0_181(3)修改bigdata112節點上的core-site.xml文件。

<configuration>

<!-- 指定hdfs的nameservice為ns1 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://ns1</value>

</property>

<!-- 指定hadoop臨時目錄 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/root/training/hadoop-3.1.2/tmp</value>

</property>

<!-- 指定zookeeper地址 -->

<property>

<name>ha.zookeeper.quorum</name>

<value>bigdata112:2181,bigdata113:2181,bigdata114:2181</value>

</property>

</configuration>(4)修改bigdata112節點上的hdfs-site.xml文件。

<configuration>

<!--指定hdfs的nameservice為ns1,需要和core-site.xml中的保持一致 -->

<property>

<name>dfs.nameservices</name>

<value>ns1</value>

</property>

<!-- ns1下面有兩個NameNode,分別是nn1,nn2 -->

<property>

<name>dfs.ha.namenodes.ns1</name>

<value>nn1,nn2</value>

</property>

<!-- nn1的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.ns1.nn1</name>

<value>bigdata112:9000</value>

</property>

<!-- nn1的http通信地址 -->

<property>

<name>dfs.namenode.http-address.ns1.nn1</name>

<value>bigdata112:9870</value>

</property>

<!-- nn2的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.ns1.nn2</name>

<value>bigdata113:9000</value>

</property>

<!-- nn2的http通信地址 -->

<property>

<name>dfs.namenode.http-address.ns1.nn2</name>

<value>bigdata113:9870</value>

</property>

<!-- 指定NameNode的日誌在JournalNode上的存放位置 -->

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal://bigdata112:8485;bigdata113:8485;/ns1</value>

</property>

<!-- 指定JournalNode在本地磁盤存放數據的位置 -->

<property>

<name>dfs.journalnode.edits.dir</name>

<value>/root/training/hadoop-3.1.2/journal</value>

</property>

<!-- 開啓NameNode失敗自動切換 -->

<property>

<name>dfs.ha.automatic-failover.enabled</name>

<value>true</value>

</property>

<!-- 配置失敗自動切換實現方式 -->

<property>

<name>dfs.client.failover.proxy.provider.ns1</name>

<value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

<!-- 配置隔離機制方法,多個機制用換行分割,即每個機制暫用一行-->

<!--如果沒有隔離機制,會造成DataNode腦裂的問題-->

<property>

<name>dfs.ha.fencing.methods</name>

<value>

sshfence

shell(/bin/true)

</value>

</property>

<!-- 使用sshfence隔離機制時需要ssh免登陸 -->

<property>

<name>dfs.ha.fencing.ssh.private-key-files</name>

<value>/root/.ssh/id_rsa</value>

</property>

<!-- 配置sshfence隔離機制超時時間 -->

<property>

<name>dfs.ha.fencing.ssh.connect-timeout</name>

<value>30000</value>

</property>

</configuration>(5)修改bigdata112節點上的mapred-site.xml文件。

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>(6)修改bigdata112節點上的yarn-site.xml文件。

<configuration>

<!-- 開啓RM高可靠 -->

<property>

<name>yarn.resourcemanager.ha.enabled</name>

<value>true</value>

</property>

<!-- 指定RM的cluster id -->

<property>

<name>yarn.resourcemanager.cluster-id</name>

<value>yrc</value>

</property>

<!-- 指定RM的名字 -->

<property>

<name>yarn.resourcemanager.ha.rm-ids</name>

<value>rm1,rm2</value>

</property>

<!-- 分別指定RM的地址 -->

<property>

<name>yarn.resourcemanager.hostname.rm1</name>

<value>bigdata112</value>

</property>

<property>

<name>yarn.resourcemanager.hostname.rm2</name>

<value>bigdata113</value>

</property>

<!-- 指定zk集羣地址 -->

<property>

<name>yarn.resourcemanager.zk-address</name>

<value>bigdata112:2181,bigdata113:2181,bigdata114:2181</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>(7)修改bigdata112節點上的workers文件。

bigdata114

bigdata115(8)將bigdata112上配置好的hadoop拷貝到其他節點。

scp -r /root/training/hadoop-3.1.2/ root@bigdata113:/root/training/

scp -r /root/training/hadoop-3.1.2/ root@bigdata114:/root/training/

scp -r /root/training/hadoop-3.1.2/ root@bigdata115:/root/training/(9)在bigdata112、bigdata113和bigdata114上啓動Zookeeper集羣。

(10)在bigdata112和bigdata113上啓動JournalNode。

hadoop-daemon.sh start journalnode(11)在bigdata112上格式化HDFS。

hdfs namenode -format(12)將bigdata112上$HADOOP_HOME/tmp拷貝到bigdata113的對應目錄下。

scp -r /root/training/hadoop-3.1.2/tmp/dfs/ root@bigdata113:/root/training/hadoop-3.1.2/tmp(13)格式化zookeeper。

hdfs zkfc -formatZK

# ZooKeeper格式化成功後,將看到如下的日誌輸出:

# 20/07/13 00:34:33 INFO ha.ActiveStandbyElector:

# Successfully created /hadoop-ha/ns1 in ZK.(14)在bigdata112上啓動Hadoop集羣。

start-all.sh(15)下面展示了整個集羣在啓動過程中輸出的日誌:

Starting namenodes on [bigdata112 bigdata113]

Last login: Fri Sep 27 00:18:38 CST 2020 on pts/0

Starting datanodes

Last login: Fri Sep 27 00:19:37 CST 2020 on pts/0

Starting journal nodes [bigdata112 bigdata113]

Last login: Fri Sep 27 00:19:40 CST 2020 on pts/0

bigdata113: journalnode is running as process 1297. Stop it first.

bigdata112: journalnode is running as process 1294. Stop it first.

Starting ZK Failover Controllers on NN hosts [bigdata112 bigdata113]

Last login: Fri Sep 27 00:19:50 CST 2020 on pts/0

Starting resourcemanagers on [ bigdata112 bigdata113]

Last login: Fri Sep 27 00:19:52 CST 2020 on pts/0

Starting nodemanagers

Last login: Fri Sep 27 00:20:00 CST 2020 on pts/0

# 通過打印輸出的日誌可以看到,在bigdata112和bigdata113上啓動了兩個NameNode、

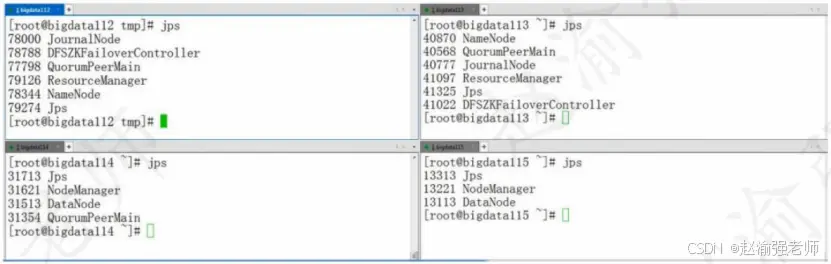

# 兩個JournalNode和兩ResourceManager。(16)通過jps命令查看每個節點上的後台進程,如下圖所示。

在部署好了HDFS HA的架構後,便可以進行一個簡單的測試以確定是否能夠基於ZooKeeper實現主節點的自動切換。