FLOWER: Democratizing Generalist Robot Policies with Efficient Vision-Language-Action Flow Policies

- CORL 2025

- project

-

Object-Centric Latent Action Learning

- AAAI 2026 dunnolab

Pi0.6: A VLA that Learns from from Experience

- Physical intelligence

- 2025.11

- project

- 人類學習組裝的三個階段

- teach the basiscs: what are the common mistakes.eg

- coach you:correcting mistakes that you make when you do it yourself.

- practice makes perfect.

- robotic learning

- training the robot on demonstrations. (Current research)

- not reliable

- 提出一種RECAP(RL with Experience and Corrections via Advantage-conditioned Policies) that 同時實現了這三步:training the robot with demonstrations, coaching it with corrections ,and enabling it to improve from automous experience.

- pi0.6採用RECAP訓練,並在下列複雜任務上測試:

- making espresso drinks

- assembing boxes

- folding diverse laundry items.

- why is imitation not enough?

-監督學習方式在LLM取得了成功,但對於robot leearning 卻表現struggling.因為模仿學習訓練的VLA必定會犯一些小的錯誤,而由於它是和真實物理世界做交互,這將導致agent到達一個它在訓練集中沒有見過的situation,繼而會更可能犯錯,這種累積誤差將導致失敗。對於輸出是靜態的AI系統如LLM並不是大問題,它適用於模型作為控制策略並與外界持續交互的情況。這意味着VLA有時成功完成任務較為容易,但要讓他們可靠地成功卻相當困難。

- 如果我們利用VLA自身行為的額外數據,就能解決這個問題。即允許VLA反覆練習來消除累積誤差。關鍵在於用什麼作為這類經驗的真實標籤?實現從經驗中學習的關鍵在於從糟糕的經驗數據中提取有效的訓練信號。

- Coaching with correctins and practicing with reinforcement

-RECAP支持兩種從糟糕經驗數據中得到好的訓練信號的方法

- Coaching: 需要專家級人類遙操作員在robotc policy運行時,觀察其行為,在出現錯誤時,立即切換現有policy到人工操作,進行糾正。

- 這種糾正措施的監督質量取決於人是否能準確把握干預時機並真正提供高質量的糾正。 為了讓roboit達到最佳性能——快速、可靠且始終如一地完成任務--機器人需要自主學習,即練習(practice)和強化(reinforcement)

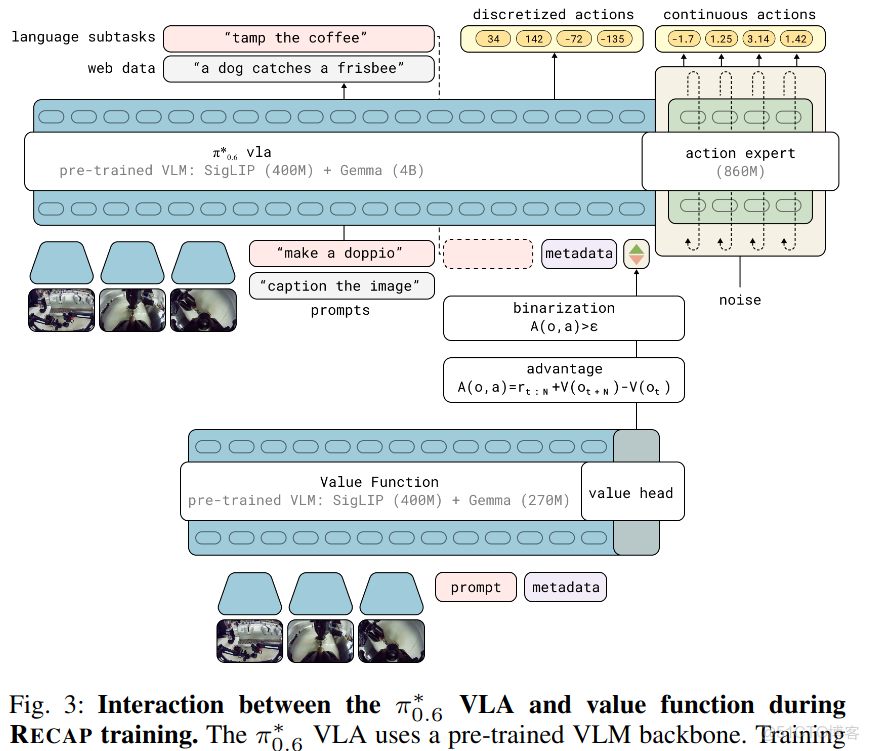

- Reinforcement: 關鍵在於credit assignment,哪個動作導致結果變好或變差。Recap為了解決credit assignment問題選擇訓練一個value function: a model that predicts how good a particular situation is relative to others.

- 在已經訓練好value function的基礎上,選擇一種scalable and can be used with large VLA的方法得到一個更好的policy(policy extraction).In RECAP, we condition the policy(VLA) on the change in value,使用所有數據訓練(包含壞的和好的),並且告訴VLA哪些是好的/壞的. the change in value in RL is referred to as the advantage.執行時則告訴policy to perform hign-advantage actions, resulting in a policyt that is much better that the data it was trained on.

- Towards real-world tasks.

- 訓練過程

- pi_0.5 3b

- pi_0.6 5b same training pipeline with pi_0.5, support heterogeneous prompts and conditioning information.

- pi_0.6* offline RL pretrain

- pi_0.6* offline RL + SFT:繼續在特定類型任務上使用演示數據微調

- final pi_0.6*: offline RL +sft+RL:繼續使用從機器人收集的額外數據,通過RL進一步訓練該模型,訓練過程中既會提供專家知道來糾正重大錯誤,也會利用獎勵反饋來改進自主操作經驗。- excellent performance

即使對於目前最好的 VLA 模型來説,這些任務階段中的每一個階段都是具有挑戰性的,而 π * 0.6 可以以超過 90% 的成功率完成這些階段

Diffusion guidance is a controllable policy improvement operator

- Sergy Levine

- ICLR2026 underreview

Knowledge insulating vision-language-action models: Train fast, run fast, generalize better.

- Physical Intelligence

- 2025.5

- 類比:VLM是視覺皮層(siglib)+前額葉皮層(LLM),需要相應的運動皮層(Action head/expert)

- 關注點:如何增強 VLM,使其能夠產生連續的動作輸出,並最大限度地繼承網絡規模預訓練的所有能力?

- 第一代:RT-2和OPENVLA,訓練 VLA 將動作輸出為標記化的數字,將每個機械臂關節角度離散化到固定大小的區間中,併為每個區間分配一個標記,就像問答問題中答案由數字組成一樣。(不適用高頻、精確、流暢的運動,不適合訓練模型,對精確任務來説過於粗糙,並且運行速度非常慢。

- 第二代:pi_0,通過在 VLA 訓練過程中添加新的神經模塊來生成連續輸出,通常採用擴散或流匹配等連續生成建模技術。這些新模塊以動作專家或動作頭的形式出現,它們既可以關注 VLM 主幹中的表徵,也可以專門用於連續運動控制。(但在 VLA 微調過程中向模型添加新的運動控制權重會導致複雜的學習動態,這可能會損害 VLM 的內部表徵。本質上,以這種粗糙的方式將這個“運動皮層”嫁接到 VLM 上可能會導致一種“遺忘”,顯著減慢訓練速度,並損害模型最終的語言理解能力。)

-第三代:pi_0.5+KI,利用 FAST 標記化的離散化動作來微調 VLM 主幹網絡,從而快速學習高質量的表示;同時,調整動作專家,使其能夠生成連續動作,而無需將其梯度傳播回 VLM 主幹網絡。訓練完成後,動作專家可以通過流匹配生成流暢的連續動作,而離散化的動作則被丟棄。

- 預訓練的 VLM 模型本身就能夠很好地處理語言輸入。然而,來自動作專家的梯度現在嚴重干擾了模型處理語言的能力,導致模型首先關注其他相關性。

- 訓練時阻止action expert 梯度影響VLM backbone.支持VLM輸出Fast-tokenized token(離散動作),並將其作為訓練目標之一。這同樣講幫助加速flowmatching action expert生成連續動作

- 用以下方式訓練 VLM 骨幹網絡:π 0-FAST token。 這樣,我們就為 VLM 主幹網絡配備了運動控制的表徵,而動作專家無需任何額外操作即可使用這些表徵。 不得不反向傳播其訓練信號,這會破壞骨幹網絡。π 0-FAST 動作標記使模型能夠更快地獲取運動表徵,並且交叉熵損失對 VLM 主幹的預訓練知識的干擾要小得多。

π0.5: a VLA with Open-World Generalization

- Physical Intelligence

- 2025.4

- 重點在於異構數據的協同訓練:協同訓練的概念很簡單:由於視覺語言模型(VLA)源自通用視覺語言模型(VLM),因此可以使用包含動作、圖像、文本和其他多模態標註(例如邊界框)任意組合的示例進行訓練。這包括通用的多模態任務,例如圖像描述、視覺問答或目標檢測,以及面向機器人的任務,例如帶有動作的機器人演示,以及“高級”機器人示例,這些示例由帶有相應語義行為標籤的觀察結果組成(例如,對一張未整理的牀的觀察,並標註“拿起枕頭”)。我們還包括“口頭指令”演示,其中人通過逐步指導機器人完成複雜任務(使用自然語言)。該模型既可以對要執行的下一個語義步驟進行高級推理(類似於思維鏈推理),也可以進行低級預測,從而向機器人的關節輸出運動指令:

- 偽代碼

Real-Time Action Chunking with Large Model

- Physical Intelligence

- 2025.6

- 在 π 0 、 π 0 -FAST 和 π 0.5 中,我們沒有采用實時策略。我們同步執行動作,這意味着我們會完成一個動作塊的執行,等待模型推理完成,然後再開始執行下一個動作塊。這樣,機器人每次執行動作塊時都是從靜止狀態開始,從而避免了運動過程中切換動作塊所帶來的問題(如果新數據塊與前一個數據塊存在顯著差異(這種情況很常見),切換到新數據塊會導致災難性的後果。)

- 然而,這種方法會在動作塊之間引入停頓,而這些停頓仍然是有害的——訓練數據中並沒有這些停頓。更不用説:它們會降低速度,影響美觀,並且會阻礙我們擴展模型規模。

- 自然而然地,我們想到利用overlapping timesteps.一個優秀的實時算法應該生成一個與這些重疊動作一致的新數據塊,同時保持模型對新信息的反應能力和做出智能決策的能力。

- 該算法修改flow matching,添加提出的“部分注意力思想”,可以在不改變訓練時間的情況下解決塊一致性問題

本文章為轉載內容,我們尊重原作者對文章享有的著作權。如有內容錯誤或侵權問題,歡迎原作者聯繫我們進行內容更正或刪除文章。