隨着大型語言模型技術的飛速發展,如何高效地構建基於這些強大模型的複雜、可交互的應用,成為了開發者的核心挑戰。LangChain應運而生,它不僅僅是一個簡單的 API 封裝,而是一個功能強大的開源框架,旨在簡化和加速 LLM 驅動的應用程序的開發。

思維導圖

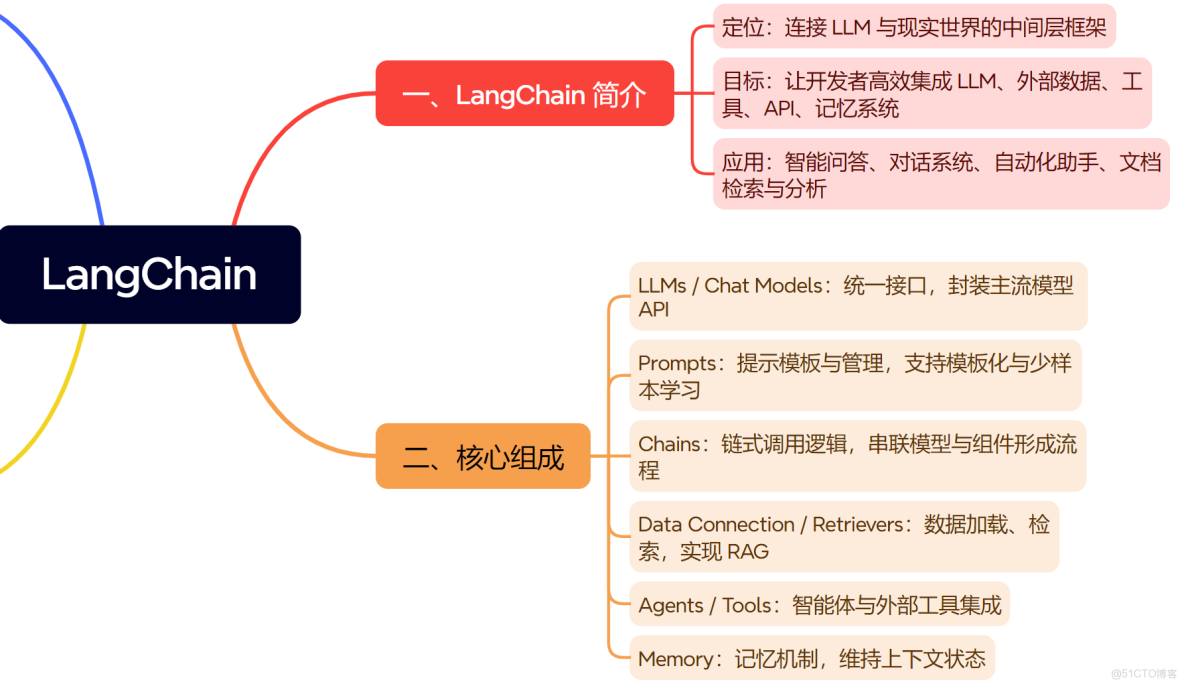

一、LangChain 簡介

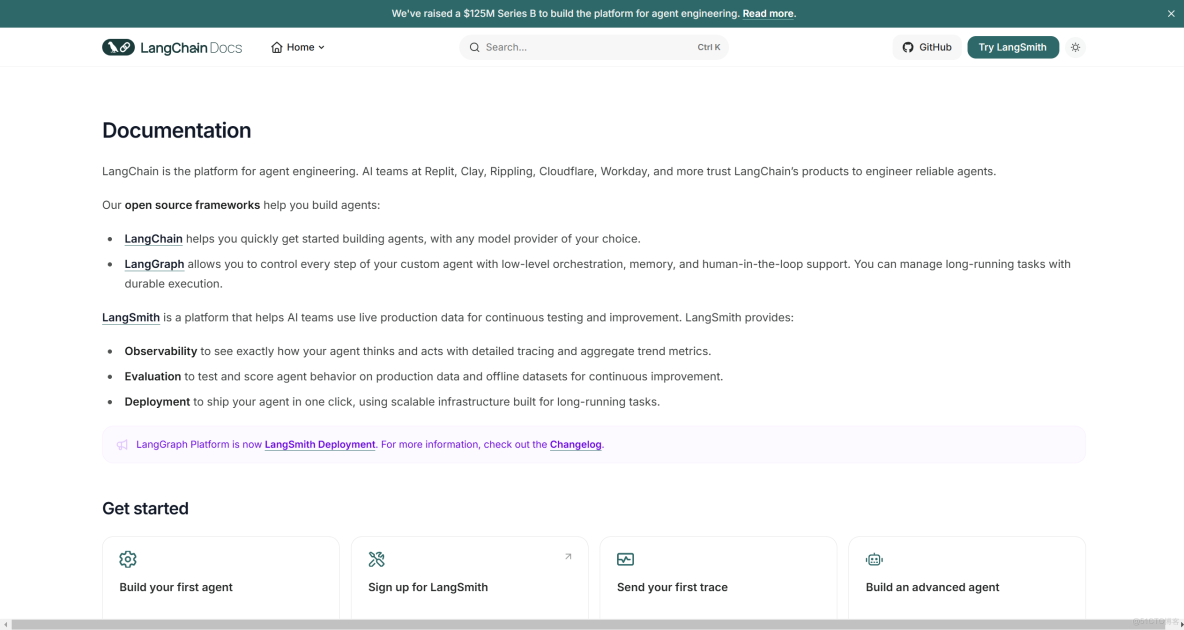

LangChain 是一個用於構建基於大型語言模型的應用框架。它的核心目標是幫助開發者更高效地將 LLM 與外部數據、工具、API、記憶系統結合,從而實現智能化、可交互的應用,如智能問答、對話系統、自動化助手、文檔檢索與分析系統等。一句話總結,LangChain 是連接 LLM 與現實世界的“中間層”框架。

二、LangChain 的核心組成

LangChain 的整體架構可以分為以下六個主要模塊,它們協同工作,構成了一個完整的 LLM 應用開發工具鏈。

|

核心模塊

|

簡介

|

作用

|

|

LLMs / Chat Models |

語言模型的統一接口。

|

封裝各類 LLM/聊天模型 (如OpenAI, HuggingFace) 的 API,提供標準化的調用方式。

|

|

Prompts |

提示模板與管理。

|

動態構建和管理輸入給 LLM 的提示,支持模板化和少量示例學習 (Few-shot)。

|

|

Chains |

鏈式調用邏輯。

|

將多個 LLM 調用或與其他組件的調用串聯起來,形成一個連貫的處理流程。

|

|

Data Connection / Retrievers |

數據連接器與檢索器。

|

負責加載、轉換、存儲和檢索外部數據,是實現 RAG (檢索增強生成) 的關鍵。

|

|

Agents / Tools |

智能體與工具。

|

賦予 LLM 決策能力和使用外部工具

|

|

Memory |

記憶機制。

|

在鏈或智能體的多次調用之間持久化狀態,實現對話的上下文記憶。

|

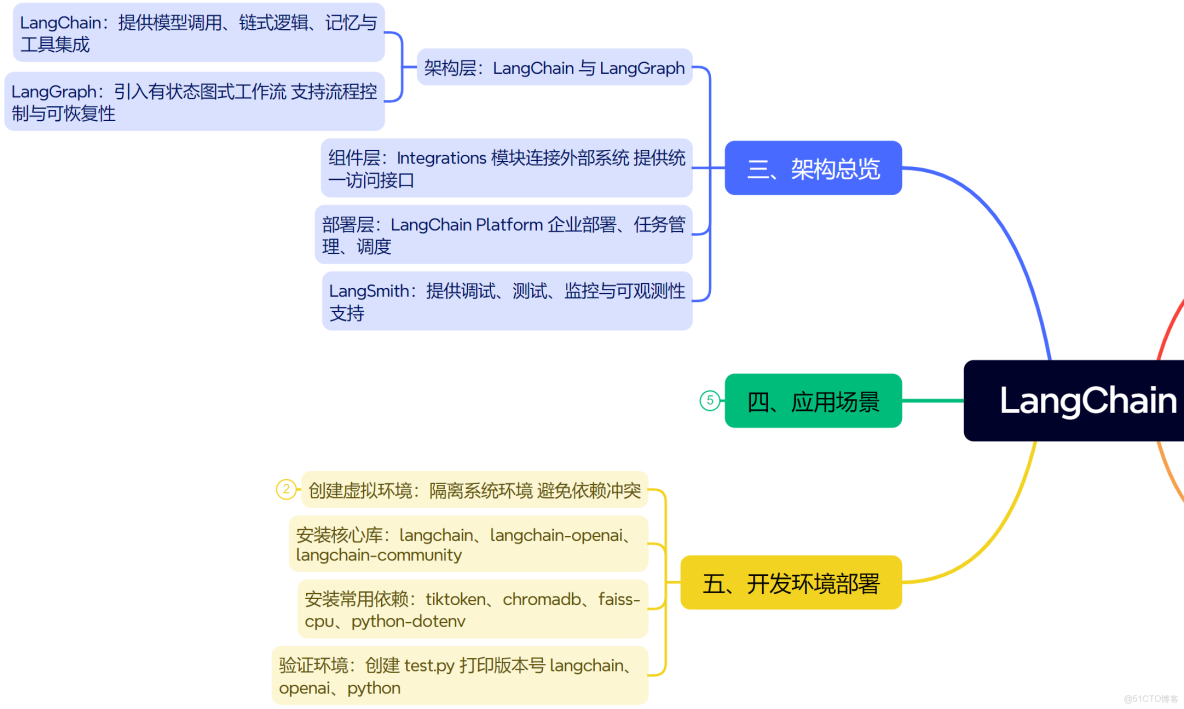

三、LangChain 架構總覽

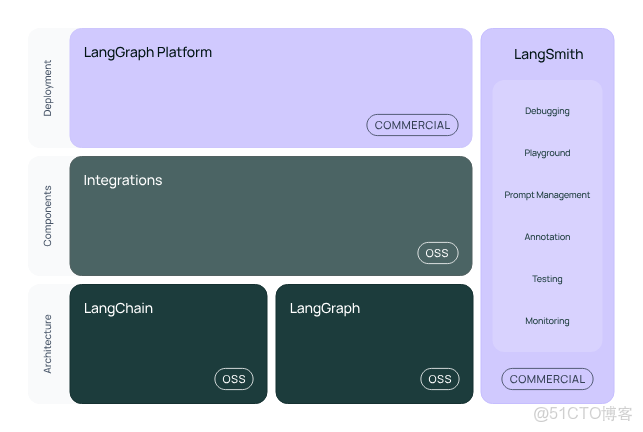

LangChain的生態分為三個主要層級:架構層 (Architecture)、組件層 (Components) 與 部署層 (Deployment),並配套有開發與調試平台 LangSmith。

1. 架構層 (Architecture)

該層是開源核心,由 LangChain 與 LangGraph 組成。

- LangChain: 提供語言模型調用、鏈式邏輯、記憶與工具集成等基礎能力。

- LangGraph: 擴展了 LangChain 的執行模型,引入有狀態的圖式工作流,使得複雜任務具備流程控制與可恢復性。

2. 組件層 (Components)

這一層通過 Integrations 模塊實現對外部系統的連接,包括向量數據庫、檢索引擎、API 接口、文件加載器等。它為上層工作流提供數據和工具的統一訪問接口,是連接底層邏輯與外部生態的中間層。

3. 部署層 (Deployment)

部署層由 LangChain Platform (商業版) 構成,用於企業級部署、任務管理與執行調度。它提供可視化工作流管理、可擴展執行環境和生產級

4. LangSmith 平台

LangSmith 與上述三層並行,提供開發和監控支持,包括調試、Prompt 管理、測試、註釋與可觀測性分析等功能。它是 LangChain 應用從開發到生產的重要支撐平台。

四、LangChain 應用場景

LangChain 廣泛應用於:

智能問答系統 (QA Chatbot): 基於通用知識或特定領域知識構建對話機器人。

私有知識庫問答 (RAG): 結合企業內部文檔、數據庫,構建能夠回答私有問題的智能系統。

自動化辦公助手: 集成郵件、日曆、CRM等辦公系統的API,實現任務的自動化處理。

文檔摘要與分析: 對長文檔、財報、法律文件進行快速摘要和信息提取。

多步任務規劃 (Agent 工作流): 讓 LLM 自主規劃步驟、調用工具,完成複雜任務,如“幫我規劃一次旅行”。

五、LangChain 開發環境部署教程

我們將在本地使用 Python 虛擬環境來搭建一個乾淨的 LangChain 開發環境。

1. 創建並激活虛擬環境

首先,在你選擇的項目目錄下,創建一個新的 Python 虛擬環境。這可以避免與系統 Python 環境的包發生衝突。

# 創建名為 .venv 的虛擬環境

python -m venv .venv

# 激活虛擬環境

# Windows (PowerShell):

.venv\Scripts\Activate.ps1

# Linux/macOS:

source .venv/bin/activate激活後,你的命令行提示符前通常會出現 (.venv) 字樣。

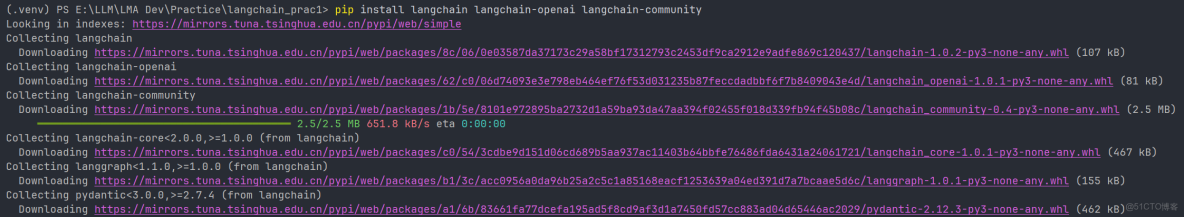

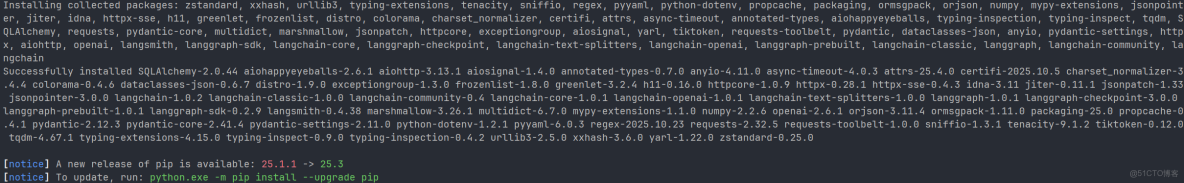

2. 安裝 LangChain 核心庫

LangChain 被設計為模塊化的。我們將安裝 langchain (核心), langchain-openai (與OpenAI模型交互) 和 langchain-community (社區維護的集成)。

# 使用國內鏡像源加速安裝

pip install langchain langchain-openai langchain-community -i https://mirrors.tuna.tsinghua.edu.cn/pypi/web/simple

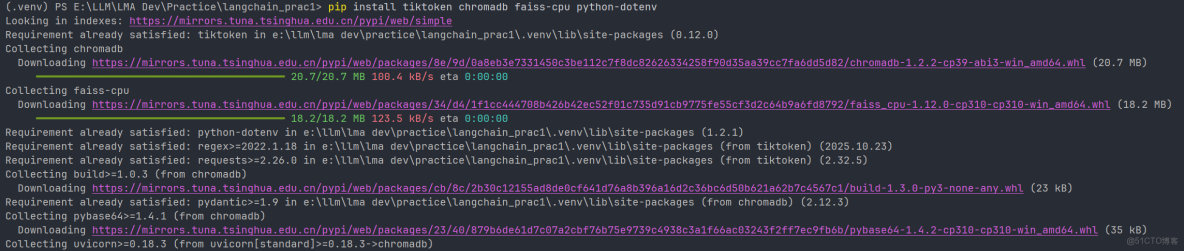

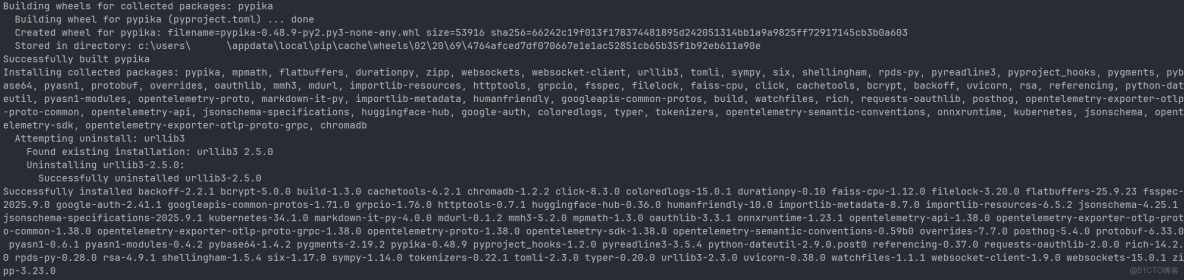

3. 安裝常用依賴 (以RAG為例)

一個非常常見的應用場景是RAG (Retrieval-Augmented Generation),即基於外部文檔的問答。這通常需要額外的依賴:

tiktoken: OpenAI 用於計算文本 token 數量的工具。

chromadb: 一個開源的向量數據庫,用於存儲文檔嵌入向量。

faiss-cpu: Facebook AI 開發的高效向量相似度搜索庫。

python-dotenv: 用於從.env文件中加載環境變量 (如 API 密鑰)。

pip install tiktoken chromadb faiss-cpu python-dotenv -i https://mirrors.tuna.tsinghua.edu.cn/pypi/web/simple

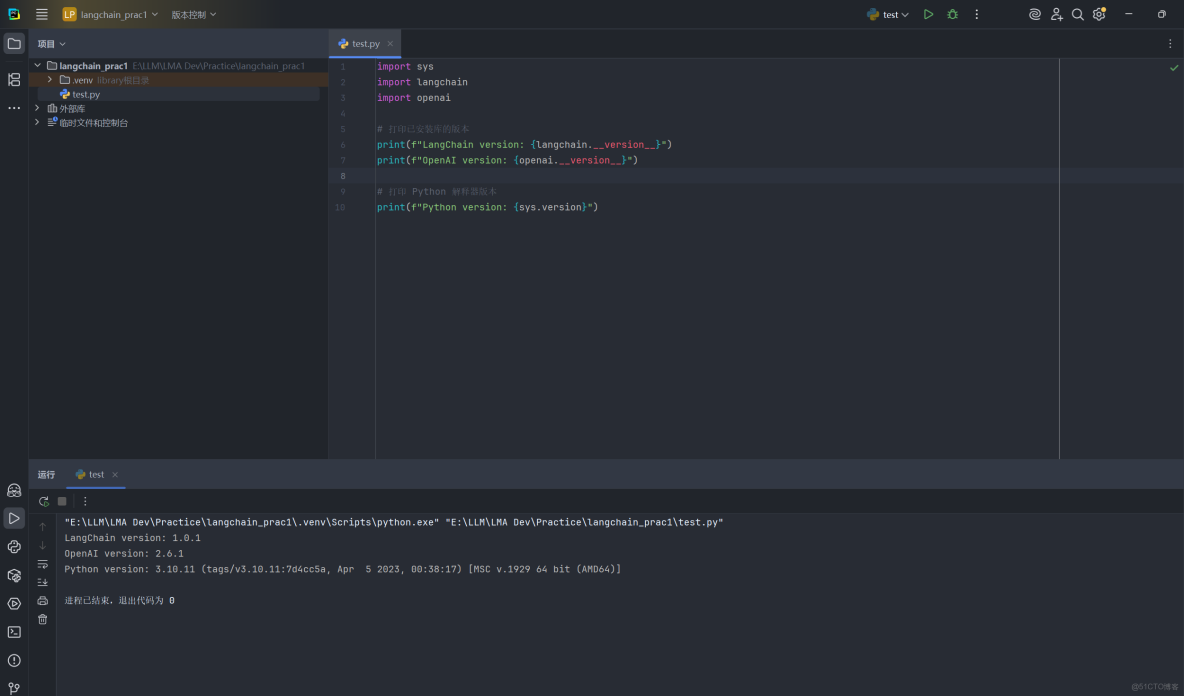

4. 驗證開發環境

最後,我們創建一個簡單的 Python 腳本 test.py 來驗證所有安裝是否成功。

test.py 內容:

import sys

import langchain

import openai

# 打印已安裝庫的版本

print(f"LangChain version: {langchain.__version__}")

print(f"OpenAI version: {openai.__version__}")

# 打印 Python 解釋器版本

print(f"Python version: {sys.version}")在你的 IDE (如 VS Code) 或終端中運行這個腳本。

python test.py如果一切正常,它會打印出 langchain, openai 和 python 的版本信息,證明你的開發環境已經準備就緒!