在 Hive 生態系統中,從元數據庫初始化到 HiveServer2 啓動的每一步都可能暗藏 “陷阱”。本文將結合實際操作,詳細解決 元數據庫強制連接 Derby 和 HiveServer2 啓動類缺失 兩大核心問題,幫助你徹底打通 Hive 部署流程。

目錄

一、問題一:Hive 元數據庫初始化時強制連接 Derby

現象回顧

根本原因與解決步驟

1. 配置文件與驅動檢查

2. 手動初始化 MySQL 元數據庫(終極方案)

3. 驗證與啓動 Hive

二、問題二:HiveServer2 啓動時類缺失(NoClassDefFoundError: HiveConf)

現象回顧

根本原因與解決步驟

1. 環境變量與類路徑檢查

2. 重啓 HiveServer2 並驗證

三、常見問題總結與延伸

一、問題一:Hive 元數據庫初始化時強制連接 Derby

現象回顧

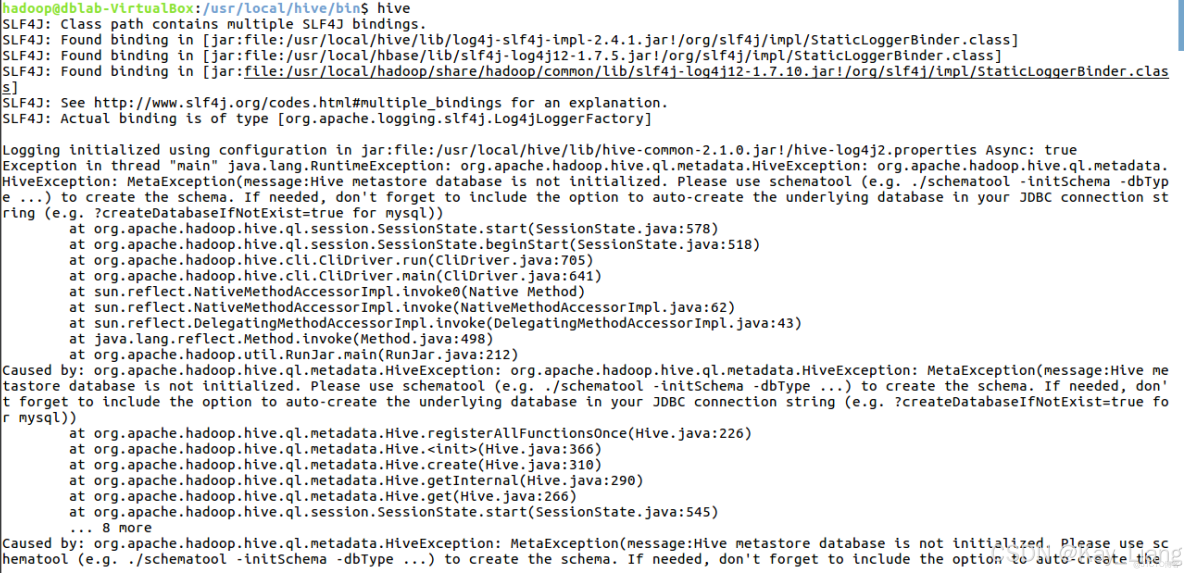

使用hive命令想要打開hive服務的時候無法打開,執行 schematool 初始化命令時,日誌始終顯示連接 Derby(而非配置的 MySQL),報錯 “Schema initialization FAILED”:

Metastore connection URL: jdbc:derby:;databaseName=metastore_db;create=true

Metastore Connection Driver : org.apache.derby.jdbc.EmbeddedDriver根本原因與解決步驟

1. 配置文件與驅動檢查

hive-site.xml格式驗證:確保 XML 配置無語法錯誤,重點配置 MySQL 連接信息: xml

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://localhost:3306/hive?createDatabaseIfNotExist=true&useSSL=false&serverTimezone=UTC</value>

</property>

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

</property>

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>hive</value>

</property>

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>hadoop</value>

</property>- MySQL 驅動安裝:Hive 依賴 MySQL JDBC 驅動,檢查是否缺少,如果缺少需按照下面手動下載並放入

$HIVE_HOME/lib:

cd $HIVE_HOME/lib

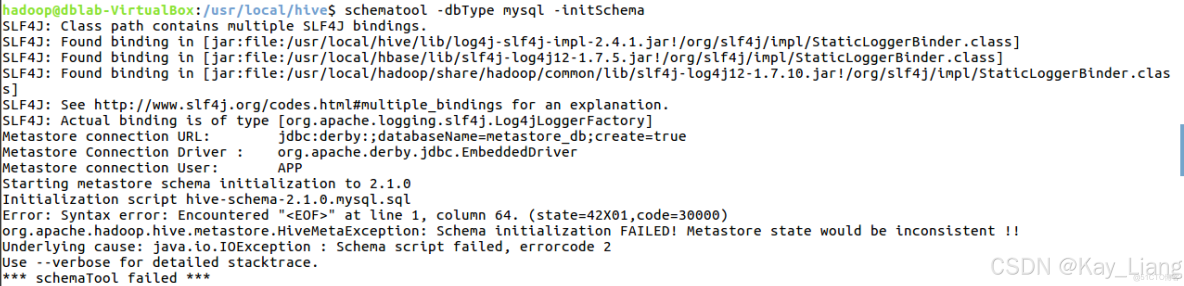

wget https://repo1.maven.org/maven2/mysql/mysql-connector-java/5.1.47/mysql-connector-java-5.1.47.jar2. 手動初始化 MySQL 元數據庫(終極方案)

若 schematool 始終失效,可直接在 MySQL命令行 中執行 Hive 元數據腳本:

-- 登錄 MySQL 並創建 Hive 數據庫

mysql -u root -p

CREATE DATABASE hive DEFAULT CHARSET utf8;

GRANT ALL ON hive.* TO 'hive'@'localhost' IDENTIFIED BY 'hadoop';

FLUSH PRIVILEGES;

USE hive;

-- 執行 Hive 元數據初始化腳本

SOURCE /usr/local/hive/scripts/metastore/upgrade/mysql/hive-schema-2.1.0.mysql.sql;3. 驗證與啓動 Hive

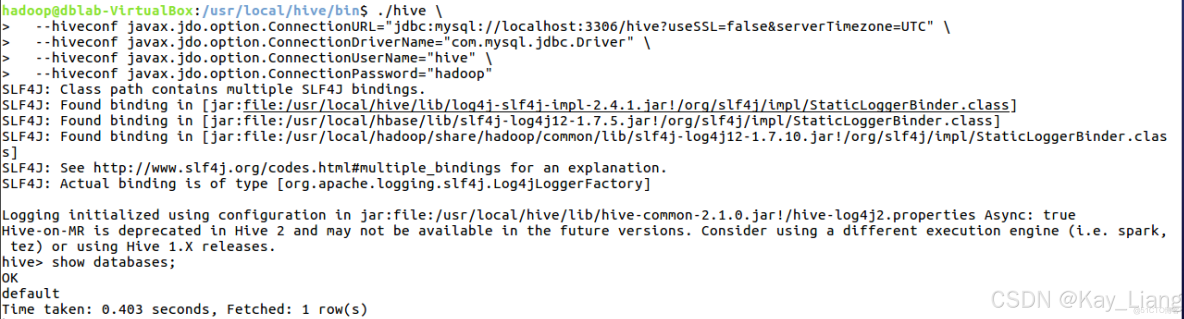

刪除 Derby 殘留文件後啓動 Hive,驗證 MySQL 連接:

cd $HIVE_HOME/bin

rm -rf metastore_db/ derby.log

./hive \

--hiveconf javax.jdo.option.connectionURL="jdbc:mysql://localhost:3306/hive?useSSL=false&serverTimezone=UTC" \

--hiveconf javax.jdo.option.connectionDriverName="com.mysql.jdbc.Driver" \

--hiveconf javax.jdo.option.connectionUserName="hive" \

--hiveconf javax.jdo.option.connectionPassword="hadoop"執行 show databases;,若輸出 default 則説明配置成功。

二、問題二:HiveServer2 啓動時類缺失(NoClassDefFoundError: HiveConf)

現象回顧

執行 hiveserver2 時,報錯類缺失:

Exception in thread "main" java.lang.NoClassDefFoundError: org/apache/hadoop/hive/conf/HiveConf根本原因與解決步驟

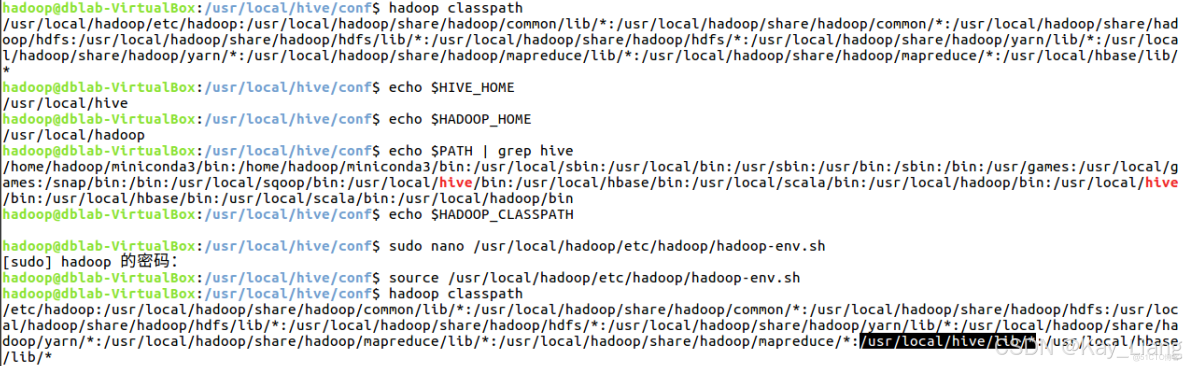

1. 環境變量與類路徑檢查

HiveServer2 依賴 Hadoop 和 Hive 的類路徑,需確保 HADOOP_HOME、HIVE_HOME 環境變量正確,且 Hive 類被加入 Hadoop 類路徑。

- 檢查環境變量是否正確:

cd /usr/local/hive/conf

echo $HIVE HOME

echo SHADOOP HOME- 配置 Hadoop 環境變量:在

hadoop-env.sh中添加 Hive 類路徑:

sudo nano $HADOOP_HOME/etc/hadoop/hadoop-env.sh

# 在末尾添加以下內容

export HIVE_HOME=/usr/local/hive

export HADOOP_CLASSPATH=$HIVE_HOME/lib/*:$HADOOP_CLASSPATH

export HIVE_CONF_DIR=/usr/local/hive/conf

#如果發現改配置之後Hadoop集羣無法關閉,則再在末尾加下面的內容

export HADOOP_CONF_DIR=/usr/local/hadoop/etc/hadoop- 生效配置並驗證:

source $HADOOP_HOME/etc/hadoop/hadoop-env.sh

hadoop classpath # 查看是否包含 $HIVE_HOME/lib/*2. 重啓 HiveServer2 並驗證

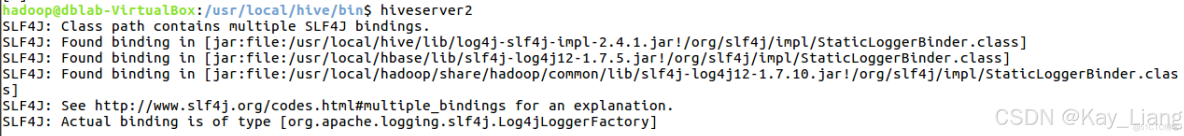

配置生效後,重新啓動 HiveServer2:

cd /usr/local/hive/bin

hiveserver2若啓動無類缺失報錯,説明問題解決。可通過 Beeline 連接驗證(另開一個終端):

beeline -u jdbc:hive2://localhost:10000 -n hadoop三、常見問題總結與延伸

- SLF4J 綁定警告:日誌中 “SLF4J: Class path contains multiple SLF4J bindings” 是組件衝突,不影響功能,可忽略或刪除 HBase/Hadoop 中衝突的

slf4j-log4j12-*.jar。 - Hive-on-MR 過時提示:Hive 2.x 中 MapReduce 執行引擎已過時,建議後續切換為 Tez 或 Spark 引擎(如

set hive.execution.engine=spark;)。 - 元數據庫版本驗證:若手動初始化後仍提示 “元數據庫未初始化”,可通過

schematool -dbType mysql -info驗證元數據版本是否匹配。

通過以上步驟,你可以從元數據庫初始化到 HiveServer2 啓動,完整解決 Hive 部署中的核心問題。若還有其他疑問,歡迎在評論區交流!