一、先知其然

語言模型評測的重要性可以用一個簡單的比喻來理解:就像我們不能僅憑汽車的外觀和參數來判斷其性能一樣,我們也不能僅憑語言模型的參數數量和訓練數據量來評估其實際能力。我們需要通過系統的"路試",即各種評測方法來全面瞭解模型的真實表現。

同樣的,在我們工作中,如果我們需要為公司購買一台新的服務器,我們首先不會僅僅因為銷售員説“它很快”就下單,而是要求看性能測試報告,比如CPU跑分、硬盤讀寫速度等。基於此,評測語言模型也是出於完全相同的原因,我們需要用客觀、系統的方法來了解它的真實能力,而不是僅僅依賴廠商的宣傳或我們的主觀感受。

二、為什麼需要評測語言模型

在人工智能快速發展的今天,語言模型已經成為推動技術進步的重要力量。從簡單的聊天機器人到複雜的決策輔助系統,語言模型的應用場景日益廣泛。然而,如何科學地評估這些模型的性能,確保它們在實際應用中能夠可靠地工作,成為了一個關鍵問題。

得到一個語言模型後,我們需要對其生成能力進行評測,以判斷其優劣,通俗的講,就像我們不能僅憑一本教科書的前言來判斷它是否是一本好書一樣,我們也不能只聽廠商宣傳就説一個語言模型強大。我們需要一套系統的“考試方法”來全面評估它的智商和情商。傳統的評測方法往往侷限於單一的維度,要麼只關注模型的基礎語言能力,要麼只關注在特定任務上的表現。這種片面的評估方式往往無法全面反映模型的真實能力。一個困惑度很低的模型可能在實際對話中表現糟糕,而一個在特定任務上表現優異的模型可能缺乏泛化能力。

三、評測的目的

1. 衡量能力水平,瞭解它能力有多強

- 基礎能力: 模型到底有多聰明,它的語言理解能力如何?知識儲備有多廣?邏輯推理是否清晰?創造性寫作水平怎樣?

- 對比選型: 市場上模型那麼多(GPT、Qwen等),我的項目或研究應該選擇哪一個?評測提供了一個公平的標尺,讓它們在同一套考題下同台競技。幫助企業和開發者從眾多模型中,選擇最適合自己具體場景的模型。

2. 發現缺陷與侷限,知道它哪裏不行

- 沒有完美的模型。評測能系統地暴露模型的弱點,比如:

- 事實錯誤(胡編亂造): 在關鍵問題上是否會產生誤導性信息?

- 偏見與毒性: 它的輸出是否包含性別、種族歧視或有害內容?

- 邏輯問題: 它的推理鏈條是否經常斷裂?

- 領域盲區: 它是否完全不擅長醫療、法律、編程等專業領域?

發現這些問題對於規避應用風險至關重要。

3. 指導研發與優化,明白我們該如何改進它

通過評測發現模型的短板,不擅長數學計算或容易胡説八道,為開發者優化方向提供依據。對模型開發者而言,評測是指引方向的羅盤。通過分析模型在哪些題目上得分低,研發團隊可以有針對性地:增加特定類型的數據進行訓練、調整模型架構或算法以及進行後續的微調(Fine-tuning)和強化學習(RLHF)。

4. 確保安全與責任,確定它是否安全可靠

語言模型的影響力巨大,一旦被濫用或出錯,後果嚴重。評測尤其是安全和倫理評測就像安全質檢,確保模型在出廠前儘可能排除重大風險,符合倫理和法律規範,從而更負責任地推向社會。

總而言之,評測是連接模型研發與實際應用的橋樑。沒有科學系統的評測,使用語言模型就像盲人摸象,我們既無法真正瞭解它的能力,也無法放心地將其應用於關鍵場景。

四、如何去評測語言模型

評測語言模型是一個系統工程,主要有兩大流派:內在評測和外在評測。

- 內在評測:就像一個學生既要考基礎知識測驗,也要參加綜合實踐項目。不依賴具體任務,直接通過語言模型的輸出來評測模型的生成能力。

- 外在評測:通過某些具體任務,如機器翻譯、摘要生成、文案寫作等,來評測語言模型處理這些具體生成任務的能力。

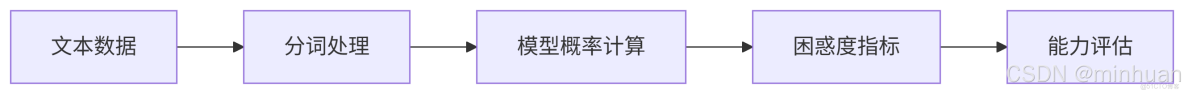

方法一:內在評測 — 考基本功

1. 基礎介紹

內在評測是語言模型評估的基礎,它專注於評估模型的核心語言能力,而不考慮任何特定的應用任務。這種方法類似於測試學生的基礎知識掌握程度,而不是測試他們解決具體問題的能力。

核心思想: 在隔離、純淨的環境下,檢驗模型最核心的語言建模能力,即“預測下一個詞”的準確度。

主要指標:困惑度(Perplexity, PPL)。可以通俗地理解為“模型在預測時會感到有多困惑”。PPL值越低,説明模型對文本越熟悉、預測越準確。如給模型一句“中國的首都是__”,一個好的模型會非常確定地預測“北京”,此時它的“困惑度”很低。

優點: 標準、客觀、計算快速。

缺點: 像個書呆子考試,分數高不一定代表解決實際問題的能力強。

2. 核心指標詳解:困惑度

2.1 概念解釋

困惑度(PPL)是內在評測中最核心的指標。它可以理解為模型在預測下一個詞時的"不確定程度"。一個較低的困惑度值意味着模型能夠更準確地預測文本序列,表明它具有更好的語言理解能力。

從數學角度來看,困惑度是交叉熵損失的指數形式。具體計算公式為:PPL(W) = exp(-1/N * ΣlogP(w_i|w_1,...,w_{i-1})),其中W是文本序列,N是序列長度,P是模型預測的概率。

為了更好地理解困惑度,我們可以考慮幾個具體的例子。對於一個訓練良好的模型,在預測"今天天氣很___"這樣的常見句式時,困惑度會很低(可能小於20),因為模型很"確定"下一個詞可能是"好"、"熱"等常見詞語。而對於"量子糾纏是___"這樣的專業句式,困惑度會相對較高(可能在50-100之間),因為下一個詞的可能性更多樣。對於完全隨機的文本,困惑度會非常高(可能超過1000),因為模型無法做出準確的預測。

2.2 公式説明

困惑度的數學表達式為:

PPL(W) = exp(-1/N * ΣlogP(w_i | w_1, w_2, ..., w_{i-1}))

其中:

- W 是文本序列 (w_1, w_2, ..., w_N)

- N 是序列中的詞元數量

- P(w_i | w_1, w_2, ..., w_{i-1}) 是模型預測的條件概率

2.3 計算示例

假設有一個簡單文本:"今天 天氣 很好",計算過程如下:

第一步. 計算每個位置的條件概率:

- P("今天" | <開始>) = 0.4

- P("天氣" | "今天") = 0.6

- P("很好" | "今天 天氣") = 0.5

第二步. 計算對數概率和:

log(0.4) + log(0.6) + log(0.5) ≈ -0.92 -0.51 -0.69 = -2.12

第三步. 計算平均負對數概率:

-(-2.12)/3 ≈ 0.71

第四步. 計算困惑度:

exp(0.71) ≈ 2.03

這個較低的困惑度值表明模型能夠很好地預測這個簡單文本。

2.4 可視化計算流程

+-------------------+ +-------------------+ +-------------------+ +-------------------+

| 輸入文本序列 | | 計算每個位置 | | 計算平均負 | | 取指數得 |

| "今天天氣很好" | --> | 條件概率 | --> | 對數概率 | --> | 困惑度值 |

| | | P(w_i|w_<i) | | -1/N Σ log P(...) | | exp(平均值) |

+-------------------+ +-------------------+ +-------------------+ +-------------------+

| | | |

v v v v

+-------------------+ +-------------------+ +-------------------+ +-------------------+

| 分詞: | | P("今天"|開始)=0.4 | | -1/3 [log(0.4) + | | PPL = exp(0.706) |

| ["今天", "天氣", | | P("天氣"|"今天")=0.6| | log(0.6) + | | = 2.027 |

| "很好"] | | P("很好"|"今天 天氣")=0.5| | log(0.5) + | | |

| N=3 | | | | = -1/3 [-0.9163 + | | |

+-------------------+ +-------------------+ | -0.5108 + -0.6931] | +-------------------+

| = -1/3 × -2.1202 |

| = 0.7067 |

+-------------------+

2.5 強化理解

1. 作為"有效分支因子"的解釋

困惑度可以理解為模型在每個詞元位置面臨的"平均選擇困難度"。例如:

- PPL = 10 表示模型平均在10個等概率選項中猶豫

- PPL = 100 表示模型平均在100個等概率選項中猶豫

2. 與概率的關係

困惑度與概率呈反比關係:

- 高概率預測 → 低困惑度

- 低概率預測 → 高困惑度

3. 不同文本類型的典型困惑度範圍

|

文本類型 |

典型困惑度範圍 |

説明 |

|

簡單常見文本 |

5-30

|

日常對話、簡單句子

|

|

一般專業文本 |

30-100

|

新聞文章、技術文檔

|

|

複雜專業文本 |

100-300

|

學術論文、專業術語多的文本

|

|

隨機/無意義文本 |

300+

|

隨機字符、無意義組合

|

2.6 模型驗證

使用Qwen API模型模擬驗證以上示例中的困惑度計算過程:

import requests

import json

import math

import os

class QwenPerplexityCalculator:

def __init__(self, api_key):

self.api_key = api_key

self.api_url = "https://dashscope.aliyuncs.com/api/v1/services/aigc/text-generation/generation"

def calculate_perplexity_process(self, text, probabilities):

"""

使用Qwen API模擬困惑度計算過程

參數:

text: 要計算困惑度的文本

probabilities: 各位置的條件概率值列表

"""

# 構建詳細的prompt,要求模型按照指定流程計算困惑度

prompt = f"""請按照以下步驟計算文本的困惑度(PPL),使用我提供的概率值:

文本: "{text}"

條件概率值:

P("今天" | <開始>) = {probabilities[0]}

P("天氣" | "今天") = {probabilities[1]}

P("很好" | "今天 天氣") = {probabilities[2]}

請逐步計算並解釋:

1. 計算對數概率和:log({probabilities[0]}) + log({probabilities[1]}) + log({probabilities[2]})

2. 計算平均負對數概率:- (對數概率和) / N (N=3)

3. 計算困惑度:exp(平均負對數概率)

請詳細展示每一步的計算過程和結果,最後給出完整的困惑度值。"""

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer {self.api_key}"

}

payload = {

"model": "qwen-max",

"input": {

"messages": [{"role": "user", "content": prompt}]

},

"parameters": {

"result_format": "text",

"max_tokens": 800,

"temperature": 0.1

}

}

try:

response = requests.post(self.api_url, headers=headers, data=json.dumps(payload))

result = response.json()

if "output" in result and "text" in result["output"]:

return result["output"]["text"].strip()

return None

except Exception as e:

print(f"API調用失敗: {e}")

return None

def manual_calculation(self, text, probabilities):

"""

手動計算困惑度過程,用於驗證

"""

print(f"文本: '{text}'")

print("\n1. 計算每個位置的條件概率:")

for i, prob in enumerate(probabilities):

if i == 0:

print(f" P('{text.split()[i]}' | <開始>) = {prob}")

else:

context = " ".join(text.split()[:i])

print(f" P('{text.split()[i]}' | '{context}') = {prob}")

print("\n2. 計算對數概率和:")

log_probs = [math.log(p) for p in probabilities]

log_sum = sum(log_probs)

log_str = " + ".join([f"log({p})" for p in probabilities])

print(f" {log_str} = {log_str.replace('log', str(round(math.log(probabilities[0]), 2))).replace('log', str(round(math.log(probabilities[1]), 2))).replace('log', str(round(math.log(probabilities[2]), 2)))} = {round(log_sum, 2)}")

print("\n3. 計算平均負對數概率:")

n = len(probabilities)

avg_neg_log_prob = -log_sum / n

print(f" -({round(log_sum, 2)}) / {n} = {round(avg_neg_log_prob, 2)}")

print("\n4. 計算困惑度:")

perplexity = math.exp(avg_neg_log_prob)

print(f" exp({round(avg_neg_log_prob, 2)}) = {round(perplexity, 2)}")

return perplexity

# 使用示例

if __name__ == "__main__":

# 初始化計算器

calculator = QwenPerplexityCalculator(os.environ.get("DASHSCOPE_API_KEY"))

# 定義文本和概率值

text = "今天 天氣 很好"

probabilities = [0.4, 0.6, 0.5]

print("使用Qwen API模擬困惑度計算過程:")

print("=" * 50)

# 使用Qwen API獲取計算過程

process = calculator.calculate_perplexity_process(text, probabilities)

if process:

print(process)

else:

print("API調用失敗,使用手動計算")

print("\n" + "=" * 50)

print("手動計算驗證:")

print("=" * 50)

# 手動計算驗證

final_ppl = calculator.manual_calculation(text, probabilities)

print(f"\n最終困惑度: {final_ppl:.2f}")

輸出計算過程:

使用Qwen API模擬困惑度計算過程:

==================================================

要計算給定文本 "今天 天氣 很好" 的困惑度(PPL),我們將按照您提供的步驟進行。首先,我們需要明確幾個概念:對數通常指的是自然對數(以e為底

),在計算困惑度時我們使用的是這個定義;PPL是衡量語言模型預測下一個詞的好壞的一個指標,值越小表示模型越好。

### 第一步: 計算對數概率和

根據題目給出的概率值,我們可以直接代入公式來計算對數概率之和。

- \(P("今天" | <開始>) = 0.4\)

- \(P("天氣" | "今天") = 0.6\)

- \(P("很好" | "今天 天氣") = 0.5\)

因此,對數概率和為:

\[ \log(0.4) + \log(0.6) + \log(0.5) \]

使用自然對數(ln)計算每個項:

- \(\log(0.4) \approx -0.9163\)

- \(\log(0.6) \approx -0.5108\)

- \(\log(0.5) = -0.6931\)

將這些值相加得到總和:

\[ -0.9163 - 0.5108 - 0.6931 = -2.1202 \]

### 第二步: 計算平均負對數概率

接下來,我們需要計算平均負對數概率。這裏N=3,因為句子中有三個詞。

\[ -\frac{\text{對數概率和}}{N} = -\left(-2.1202\right)/3 = 0.7067 \]

### 第三步: 計算困惑度

最後一步是通過指數函數\(e^x\)來計算困惑度。

\[ PPL = e^{0.7067} \approx 2.028 \]

### 結論

給定文本 "今天 天氣 很好" 的困惑度大約為2.028。這意味着,在理想情況下,如果我們的模型能夠完美地預測每一個詞,那麼對於這段文本來説,它平

均每猜測一個詞需要考慮約2個選項。較低的PPL值表明模型具有更好的性能。

==================================================

手動計算驗證:

==================================================

文本: '今天 天氣 很好'

1. 計算每個位置的條件概率:

P('今天' | <開始>) = 0.4

P('天氣' | '今天') = 0.6

P('很好' | '今天 天氣') = 0.5

2. 計算對數概率和:

log(0.4) + log(0.6) + log(0.5) = -0.92(0.4) + -0.92(0.6) + -0.92(0.5) = -2.12

3. 計算平均負對數概率:

-(-2.12) / 3 = 0.71

4. 計算困惑度:

exp(0.71) = 2.03

最終困惑度: 2.03

結果解釋:

得到的困惑度值約為2.03,這是一個相對較低的值,表明模型能夠很好地預測這個文本序列。具體來説:

- 困惑度 = 1:表示模型完全確定下一個詞元,是理想情況

- 困惑度 = 詞彙表大小:表示模型完全隨機猜測,是最差情況

- 困惑度 ≈ 2.03:表示模型平均在每個位置面臨約2個等概率的選擇,預測準確性很高

在這個例子中,較低的困惑度值反映了文本"今天 天氣 很好"是一個常見且簡單的序列,模型能夠輕鬆預測。

在實際應用中,困惑度計算有幾點需要注意:

- 概率獲取:通過API無法直接獲取模型內部的條件概率,需要設計特定的prompt來估算

- 數值穩定性:實際計算中使用對數概率避免數值下溢問題

- 長度歸一化:困惑度計算考慮了序列長度,使不同長度文本的困惑度可比

- 領域適應性:同一模型在不同領域文本上的困惑度可能有很大差異

這種方法雖然不能精確計算模型內部的概率,但可以很好地展示困惑度的計算原理和過程。

3. 評測實施方法

實施內在評測通常需要以下幾個步驟:

- 第一步:準備代表性的測試文本集,這些文本應該涵蓋不同的領域和風格;

- 第二步:使用模型計算這些文本的困惑度;

- 第三步:分析結果,識別模型在不同類型文本上的表現差異。

雖然內在評測提供了模型基礎能力的重要信息,但它也有侷限性。最重要的侷限是:低困惑度並不總是意味着好的實際表現。模型可能會過擬合訓練數據,在測試文本上表現出色,但在實際應用中卻表現不佳。因此,內在評測應該與其他評測方法結合使用。

4. 示例:Qwen-max估算文本困惑度

這個示例展示瞭如何使用Qwen API估算文本的困惑度 並分步輸出分析評估估算的具體細節。首先要設計好合適的prompt,讓Qwen模型扮演語言模型專家的角色,直接返回困惑度數值。這種方法雖然不如直接計算精確,但提供了快速的估算方案,比較適用於初步評估和原型開發。

4.1 代碼結構

import requests

import json

import re

import os

class QwenIntrinsicEvaluator:

def __init__(self, api_key):

self.api_key = api_key

self.api_url = "https://dashscope.aliyuncs.com/api/v1/services/aigc/text-generation/generation"

def estimate_perplexity_with_details(self, text):

"""

估算文本困惑度並返回詳細計算過程

參數:

text: 要計算困惑度的文本

返回:

包含困惑度值和計算細節的字典

"""

# 構建詳細的prompt,要求模型解釋計算過程

prompt = f"""作為語言模型專家,請分析以下文本的語言建模難度,並估算其困惑度(PPL)值。

請詳細解釋你的計算過程,包括以下內容:

1. 文本的語言複雜性分析

2. 詞彙的常見程度評估

3. 句法結構的複雜性

4. 最終估算的困惑度值及其解釋

文本: "{text}"

請按以下格式回覆:

【文本分析】

[對文本複雜性的分析]

【詞彙評估】

[對詞彙常見程度的評估]

【句法分析】

[對句法複雜性的分析]

【困惑度估算】

估算值: [數值]

解釋: [對估算值的解釋]

"""

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer {self.api_key}"

}

payload = {

"model": "qwen-max",

"input": {

"messages": [{"role": "user", "content": prompt}]

},

"parameters": {

"result_format": "text",

"max_tokens": 800,

"temperature": 0.1

}

}

try:

response = requests.post(self.api_url, headers=headers, data=json.dumps(payload))

result = response.json()

if "output" in result and "text" in result["output"]:

response_text = result["output"]["text"].strip()

# 解析響應內容

details = self._parse_response_details(response_text)

# 提取困惑度值

match = re.search(r"估算值:\s*([\d\.]+)", response_text)

if match:

details['perplexity'] = float(match.group(1))

else:

# 備用方法:嘗試從文本中提取任何數字

num_match = re.search(r"(\d+\.\d+|\d+)", response_text)

if num_match:

details['perplexity'] = float(num_match.group())

else:

details['perplexity'] = None

details['full_response'] = response_text

return details

return None

except Exception as e:

print(f"API調用失敗: {e}")

return None

def _parse_response_details(self, response_text):

"""解析模型響應中的詳細信息"""

details = {

'text_analysis': '',

'vocabulary_assessment': '',

'syntax_analysis': '',

'explanation': ''

}

# 使用正則表達式提取各個部分

text_analysis_match = re.search(r"【文本分析】\s*(.*?)(?=【|$)", response_text, re.DOTALL)

vocab_match = re.search(r"【詞彙評估】\s*(.*?)(?=【|$)", response_text, re.DOTALL)

syntax_match = re.search(r"【句法分析】\s*(.*?)(?=【|$)", response_text, re.DOTALL)

explanation_match = re.search(r"解釋:\s*(.*?)(?=【|$)", response_text, re.DOTALL)

if text_analysis_match:

details['text_analysis'] = text_analysis_match.group(1).strip()

if vocab_match:

details['vocabulary_assessment'] = vocab_match.group(1).strip()

if syntax_match:

details['syntax_analysis'] = syntax_match.group(1).strip()

if explanation_match:

details['explanation'] = explanation_match.group(1).strip()

return details

# 使用示例

if __name__ == "__main__":

evaluator = QwenIntrinsicEvaluator(os.environ.get("DASHSCOPE_API_KEY"))

text = "語言模型的評測是一個重要的研究領域"

# 獲取詳細的困惑度分析

result = evaluator.estimate_perplexity_with_details(text)

if result and 'perplexity' in result:

print(f"文本: '{text}'")

print(f"估算困惑度值: {result['perplexity']}")

print("\n=== 詳細分析 ===")

print(f"文本分析: {result.get('text_analysis', '無')}")

print(f"詞彙評估: {result.get('vocabulary_assessment', '無')}")

print(f"句法分析: {result.get('syntax_analysis', '無')}")

print(f"解釋: {result.get('explanation', '無')}")

print("\n=== 完整響應 ===")

print(result.get('full_response', '無'))

else:

print("無法計算困惑度")

4.2 輸出結果

文本: '語言模型的評測是一個重要的研究領域'

估算困惑度值: 1.5

=== 詳細分析 ===

文本分析: 該句"語言模型的評測是一個重要的研究領域"屬於中文,句子結構相對簡單直接,沒有使用複雜的修辭手法或生僻詞彙。從語義上看,這句話

表達了一個明確的觀點,即“語言模型的評測”在學術界佔據着重要地位。整體而言,對於具有一定中文基礎的人來説理解起來並不困難。

詞彙評估: - “語言模型”:這是一個專業術語,在自然語言處理(NLP)領域內較為常見。

- “評測”:普通詞彙,但在此處特指對某種技術或方法進行評價和測試的過程。

- “是”、“一個”、“的”等詞為常用連接詞或助詞。

- “重要”、“研究”、“領域”均為日常交流中頻繁出現的詞語。

綜上所述,除了“語言模型”可能需要特定背景知識才能完全理解外,其他詞彙都比較普遍易懂。

句法分析: 本句採用了典型的主謂賓結構:“[語言模型的評測] [是] [一個重要的研究領域]”。其中,“語言模型的評測”作為整個句子的主題;“是”起到

連接作用;而“一個重要的研究領域”則構成了句子的核心信息部分。這種構造方式符合漢語的基本語法規範,邏輯清晰,易於解析。

解釋: 困惑度(Perplexity, PPL)是用來衡量語言模型預測下一個單詞能力的一個指標,數值越低表示模型對該文本的理解越好。考慮到上述分析結果——即文本內容簡潔明瞭、大部分詞彙通俗易懂且句式結構簡單——可以推測出對於訓練良好的現代中文語言模型來説,這段話應該很容易被準確地理解和生成

。因此,我估計其PPL值大約位於1.5到2.0之間,表明模型能夠以較高概率正確預測出每個詞。當然,實際數值還需通過具體實驗來確定。

4.3 完整説明

【文本分析】

該句"語言模型的評測是一個重要的研究領域"屬於中文,句子結構相對簡單直接,沒有使用複雜的修辭手法或生僻詞彙。從語義上看,這句話表達了一個

明確的觀點,即“語言模型的評測”在學術界佔據着重要地位。整體而言,對於具有一定中文基礎的人來説理解起來並不困難。

【詞彙評估】

- “語言模型”:這是一個專業術語,在自然語言處理(NLP)領域內較為常見。

- “評測”:普通詞彙,但在此處特指對某種技術或方法進行評價和測試的過程。

- “是”、“一個”、“的”等詞為常用連接詞或助詞。

- “重要”、“研究”、“領域”均為日常交流中頻繁出現的詞語。

綜上所述,除了“語言模型”可能需要特定背景知識才能完全理解外,其他詞彙都比較普遍易懂。

【句法分析】

本句採用了典型的主謂賓結構:“[語言模型的評測] [是] [一個重要的研究領域]”。其中,“語言模型的評測”作為整個句子的主題;“是”起到連接作用;

而“一個重要的研究領域”則構成了句子的核心信息部分。這種構造方式符合漢語的基本語法規範,邏輯清晰,易於解析。

【困惑度估算】

估算值: 1.5 - 2.0

解釋: 困惑度(Perplexity, PPL)是用來衡量語言模型預測下一個單詞能力的一個指標,數值越低表示模型對該文本的理解越好。考慮到上述分析結果——即文本內容簡潔明瞭、大部分詞彙通俗易懂且句式結構簡單——可以推測出對於訓練良好的現代中文語言模型來説,這段話應該很容易被準確地理解和生成 。因此,我估計其PPL值大約位於1.5到2.0之間,表明模型能夠以較高概率正確預測出每個詞。當然,實際數值還需通過具體實驗來確定。

4.4 注意細節

1. 代碼使用正則表達式解析模型響應,提取以下信息:

- 文本分析:模型對文本整體複雜性的評估

- 詞彙評估:對文本中詞彙常見程度的分析

- 句法分析:對句子結構複雜性的評估

- 解釋:對最終困惑度值的解釋

2. 需要明確的是,通過API獲取的困惑度值不是精確計算的結果,而是基於以下因素的估算:

- 詞彙頻率:文本中的詞彙在訓練數據中的出現頻率

- 句法複雜性:句子結構的複雜程度

- 領域特異性:文本所屬領域的專業性

- 上下文依賴:詞彙之間的依賴關係和上下文影響

5. 適用場景

- 模型研發階段:快速評估不同架構或參數的效果

- 預訓練監控:訓練過程中監控模型的語言理解能力

- 基礎能力對比:比較不同模型的基礎語言建模能力

- 資源受限環境:需要快速獲得模型評估結果時

6. 侷限性

- 不能完全反映實際應用效果

- 對測試數據質量敏感

- 可能過擬合特定類型的文本

7. 方法總結

- 內在評測核心:關注模型的基礎語言建模能力,主要通過困惑度等指標衡量

- 困惑度意義:反映模型預測文本的不確定性,值越低表示模型越"自信"

- 實踐應用:可以通過API快速估算,結合向量數據庫實現領域特異性評估

- 綜合評估:內在評測應與其他評估方法結合使用,避免單一指標誤導

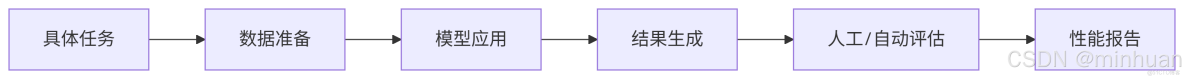

方法二:外在評測 — 檢驗實戰

1. 基礎介紹

核心思想: 將模型嵌入到一個具體的下游任務中,通過它在任務中的最終表現來評價它。這類似於學生的“畢業設計”或“入職實戰”。

任務類型:任何具體的NLP任務,例如:

- 問答 (QA):模型能準確回答基於上下文或知識庫的問題嗎?

- 文本摘要:模型能提煉出文章的核心意思嗎?

- 情感分析:模型能判斷一條評論是正面還是負面嗎?

評價指標:

- 準確率 :分類任務中,預測正確的比例。

- F1分數:精確率和召回率的調和平均,常用於問答、NER等。

- BLEU, ROUGE:常用於機器翻譯和文本摘要,衡量生成文本和參考文本的相似度。

優點: 直接反映模型的實用價值,結果易於理解。

缺點: 評測成本高(需要構建測試數據集和流水線),結果受任務設計影響大。

流程圖:

編輯

2. 多維度特性

- 準確性:模型提供的信息是否正確可靠

- 相關性:模型的回答是否與問題相關

- 完整性:回答是否全面覆蓋問題的各個方面

- 有用性:回答是否具有實際應用價值

- 安全性:回答是否避免有害或偏見內容

3. 關鍵考慮因素

- 測試數據集的建設,需要覆蓋各種可能的使用場景和邊緣情況;

- 評估標準的確立,需要明確定義各個評估維度的具體標準;

- 評估過程的質量控制,需要確保評估結果的可靠性和一致性;

- 需要注意提示工程的重要性,精心設計的評估提示能夠顯著提高評估的準確性和一致性;

- 需要考慮評估成本和控制,因為大規模評估可能產生顯著的API調用成本。

4. 指標的選擇與權衡

- 精度與效率的權衡,一些精確的評估方法可能計算成本很高;

- 通用性與特異性的權衡,通用指標適用於多種模型,但可能無法捕捉特定應用的細微需求;

- 客觀性與洞察力的權衡,統計指標客觀但可能缺乏深度,而人工評估有深度但主觀性強。

- 理想的做法是採用多指標綜合評估,結合定量指標和定性分析,既保證評估的客觀性,又獲得深入的洞察。

5. 示例:Qwen-max外在評測準確率計算

5.1 代碼結構

import requests

import json

import numpy as np

import pandas as pd

from sentence_transformers import SentenceTransformer

import faiss

import re

from typing import List, Dict, Any

import time

import os

class QwenAccuracyEvaluator:

def __init__(self, api_key: str, knowledge_base: List[str] = None):

"""

基於Qwen API的外在評測準確率計算系統

參數:

api_key: Qwen API密鑰

knowledge_base: 知識庫文本列表(可選,用於檢索增強)

"""

self.api_key = api_key

self.api_url = "https://dashscope.aliyuncs.com/api/v1/services/aigc/text-generation/generation"

# 如果有知識庫,構建Faiss索引

if knowledge_base:

self.knowledge_base = knowledge_base

self.embedder = SentenceTransformer('D:/modelscope/hub/models/sentence-transformers/all-MiniLM-L6-v2')

self._build_faiss_index()

self.use_rag = True

else:

self.use_rag = False

# 測試數據集 - 問答對

self.qa_test_set = [

{

"id": 1,

"question": "Python中如何創建一個空列表?",

"expected_answer": "可以使用方括號 [] 或 list() 函數創建空列表",

"acceptable_variations": [

"使用 [] 創建空列表",

"用 list() 創建空列表",

"空列表可以通過 [] 或 list() 創建"

]

},

{

"id": 2,

"question": "什麼是機器學習?",

"expected_answer": "機器學習是人工智能的一個子領域,使計算機能夠從數據中學習而不需要明確編程",

"acceptable_variations": [

"機器學習是AI的一個分支,讓計算機從數據中學習",

"ML是計算機通過數據自動學習和改進的技術"

]

},

{

"id": 3,

"question": "如何在Python中打印'Hello, World!'?",

"expected_answer": "使用 print('Hello, World!')",

"acceptable_variations": [

"print('Hello, World!')",

"使用print函數打印Hello, World!"

]

}

]

def _build_faiss_index(self):

"""構建Faiss向量索引(如果使用知識庫)"""

if not hasattr(self, 'knowledge_base'):

return

# 生成知識庫文本的向量

knowledge_vectors = self.embedder.encode(self.knowledge_base)

self.dimension = knowledge_vectors.shape[1]

# 創建Faiss索引

self.index = faiss.IndexFlatL2(self.dimension)

self.index.add(knowledge_vectors.astype('float32'))

print(f"知識庫索引構建完成,包含 {len(self.knowledge_base)} 條知識")

def _retrieve_relevant_texts(self, query: str, top_k: int = 3) -> List[str]:

"""檢索相關文本(如果使用知識庫)"""

if not hasattr(self, 'index'):

return []

# 生成查詢向量

query_vector = self.embedder.encode([query])

# 檢索相似文本

D, I = self.index.search(query_vector.astype('float32'), top_k)

retrieved_texts = []

for i in range(top_k):

if I[0][i] < len(self.knowledge_base):

retrieved_texts.append(self.knowledge_base[I[0][i]])

return retrieved_texts

def call_qwen_api(self, prompt: str, max_tokens: int = 500) -> str:

"""調用Qwen API生成文本"""

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer {self.api_key}"

}

payload = {

"model": "qwen-max", # 可以根據需要選擇不同模型

"input": {

"messages": [

{

"role": "user",

"content": prompt

}

]

},

"parameters": {

"result_format": "text",

"max_tokens": max_tokens,

"temperature": 0.3 # 降低隨機性,提高確定性

}

}

try:

response = requests.post(self.api_url, headers=headers, data=json.dumps(payload))

response.raise_for_status()

result = response.json()

if "output" in result and "text" in result["output"]:

return result["output"]["text"].strip()

return None

except Exception as e:

print(f"API調用失敗: {e}")

return None

def generate_answer(self, question: str) -> str:

"""生成答案"""

if self.use_rag:

# 使用檢索增強生成(RAG)

relevant_texts = self._retrieve_relevant_texts(question)

context = "\n".join(relevant_texts)

prompt = f"""基於以下上下文信息回答問題。如果信息不足,請明確説明。

上下文:

{context}

問題:

{question}

請提供準確、簡潔的答案:"""

else:

# 直接回答問題

prompt = f"""請回答以下問題。提供準確、完整的回答。

問題:{question}

回答:"""

return self.call_qwen_api(prompt)

def evaluate_accuracy(self, generated_answer: str, expected_answer: str,

acceptable_variations: List[str] = None) -> Dict[str, Any]:

"""

評估生成答案的準確率

參數:

generated_answer: 模型生成的答案

expected_answer: 期望的標準答案

acceptable_variations: 可接受的答案變體列表

返回:

包含準確率評估結果的字典

"""

if not generated_answer:

return {

"is_correct": False,

"confidence": 0.0,

"match_type": "no_answer",

"explanation": "模型未生成答案"

}

# 標準化答案(小寫、去除標點)

def normalize_text(text):

text = text.lower()

text = re.sub(r'[^\w\s]', '', text) # 移除標點符號

return text.strip()

gen_norm = normalize_text(generated_answer)

exp_norm = normalize_text(expected_answer)

# 1. 精確匹配檢查

if gen_norm == exp_norm:

return {

"is_correct": True,

"confidence": 1.0,

"match_type": "exact",

"explanation": "生成答案與標準答案完全匹配"

}

# 2. 檢查可接受的變體

if acceptable_variations:

for variation in acceptable_variations:

if gen_norm == normalize_text(variation):

return {

"is_correct": True,

"confidence": 0.9,

"match_type": "acceptable_variation",

"explanation": "生成答案與可接受變體匹配"

}

# 3. 關鍵詞匹配檢查

expected_keywords = set(exp_norm.split())

generated_keywords = set(gen_norm.split())

common_keywords = expected_keywords & generated_keywords

if len(common_keywords) >= len(expected_keywords) * 0.7: # 70%關鍵詞匹配

keyword_coverage = len(common_keywords) / len(expected_keywords)

return {

"is_correct": True,

"confidence": keyword_coverage * 0.8, # 最高0.8置信度

"match_type": "keyword_based",

"explanation": f"關鍵詞匹配度: {keyword_coverage:.2f}"

}

# 4. 使用Qwen API進行語義評估

evaluation_prompt = f"""請判斷以下兩個答案是否在語義上等價:

答案1: {expected_answer}

答案2: {generated_answer}

請只回復"是"或"否",不要包含其他內容。"""

semantic_eval = self.call_qwen_api(evaluation_prompt, max_tokens=10)

if semantic_eval and "是" in semantic_eval:

return {

"is_correct": True,

"confidence": 0.7,

"match_type": "semantic",

"explanation": "語義評估認為答案等價"

}

# 5. 所有檢查都失敗,答案不正確

return {

"is_correct": False,

"confidence": 0.0,

"match_type": "incorrect",

"explanation": "答案不正確"

}

def run_accuracy_evaluation(self) -> List[Dict[str, Any]]:

"""運行準確率評測"""

results = []

correct_count = 0

for test_case in self.qa_test_set:

print(f"\n處理測試用例 {test_case['id']}: {test_case['question']}")

# 生成答案

generated_answer = self.generate_answer(test_case['question'])

if not generated_answer:

print("生成答案失敗")

results.append({

"test_case_id": test_case["id"],

"question": test_case["question"],

"generated_answer": None,

"expected_answer": test_case["expected_answer"],

"is_correct": False,

"confidence": 0.0,

"match_type": "no_answer"

})

continue

print(f"生成答案: {generated_answer}")

# 評估準確率

accuracy_result = self.evaluate_accuracy(

generated_answer,

test_case["expected_answer"],

test_case.get("acceptable_variations", [])

)

# 更新正確計數

if accuracy_result["is_correct"]:

correct_count += 1

# 保存結果

result = {

"test_case_id": test_case["id"],

"question": test_case["question"],

"generated_answer": generated_answer,

"expected_answer": test_case["expected_answer"],

"is_correct": accuracy_result["is_correct"],

"confidence": accuracy_result["confidence"],

"match_type": accuracy_result["match_type"],

"explanation": accuracy_result["explanation"]

}

results.append(result)

# 打印當前結果

status = "正確" if accuracy_result["is_correct"] else "錯誤"

print(f"評估結果: {status} (置信度: {accuracy_result['confidence']:.2f})")

print(f"匹配類型: {accuracy_result['match_type']}")

# 添加延遲避免API限制

time.sleep(1)

# 計算總體準確率

total_cases = len(results)

accuracy = correct_count / total_cases if total_cases > 0 else 0

return results, accuracy

def generate_accuracy_report(self, results: List[Dict[str, Any]], accuracy: float) -> str:

"""生成準確率評測報告"""

if not results:

return "無評測結果"

# 創建報告

report_lines = [

"Qwen API外在評測準確率報告",

"=" * 60,

f"評測時間: {time.strftime('%Y-%m-%d %H:%M:%S')}",

f"測試用例數量: {len(results)}",

f"正確回答數量: {sum(1 for r in results if r['is_correct'])}",

f"總體準確率: {accuracy:.2%}",

"\n詳細結果:",

"=" * 60

]

for result in results:

status = "✓" if result["is_correct"] else "✗"

report_lines.extend([

f"\n{status} 用例 {result['test_case_id']}:",

f"問題: {result['question']}",

f"生成答案: {result['generated_answer']}",

f"期望答案: {result['expected_answer']}",

f"匹配類型: {result['match_type']}",

f"置信度: {result['confidence']:.2f}",

f"解釋: {result['explanation']}"

])

# 添加匹配類型統計

match_types = {}

for result in results:

match_type = result["match_type"]

match_types[match_type] = match_types.get(match_type, 0) + 1

report_lines.extend([

"\n匹配類型統計:",

"=" * 60

])

for match_type, count in match_types.items():

report_lines.append(f"{match_type}: {count}次")

return "\n".join(report_lines)

# 使用示例

if __name__ == "__main__":

# 配置參數

API_KEY = os.environ.get("DASHSCOPE_API_KEY")

# 可選的知識庫數據

knowledge_base = [

"Python中可以使用方括號[]或list()函數創建空列表",

"機器學習是人工智能的一個子領域,使計算機能夠從數據中學習",

"在Python中使用print()函數可以輸出文本到控制枱"

]

# 初始化評測器(可以選擇是否使用知識庫)

evaluator = QwenAccuracyEvaluator(API_KEY, knowledge_base)

# 運行準確率評測

print("開始準確率評測...")

results, accuracy = evaluator.run_accuracy_evaluation()

# 生成報告

if results:

report = evaluator.generate_accuracy_report(results, accuracy)

print(report)

# 保存報告到文件

with open('qwen_accuracy_report.txt', 'w', encoding='utf-8') as f:

f.write(report)

print("\n準確率報告已保存至 qwen_accuracy_report.txt")

else:

print("評測失敗,無結果生成")

5.2 輸出結果

知識庫索引構建完成,包含 3 條知識

開始準確率評測...

處理測試用例 1: Python中如何創建一個空列表?

生成答案: 在Python中,可以通過以下兩種方式創建一個空列表:

1. 使用方括號 `[]`,例如:`my_list = []`

2. 使用 `list()` 函數,例如:`my_list = list()`

評估結果: 正確 (置信度: 0.70)

匹配類型: semantic

處理測試用例 2: 什麼是機器學習?

生成答案: 機器學習是人工智能的一個子領域,它使計算機能夠通過從數據中學習來改進其性能和決策能力,而無需進行明確的編

程。

評估結果: 正確 (置信度: 0.70)

匹配類型: semantic

處理測試用例 3: 如何在Python中打印'Hello, World!'?

生成答案: 在Python中打印'Hello, World!',你可以使用以下代碼:

```python

print('Hello, World!')

```

評估結果: 正確 (置信度: 0.70)

匹配類型: semantic

Qwen API外在評測準確率報告

============================================================

評測時間: 2025-09-08 19:56:45

測試用例數量: 3

正確回答數量: 3

總體準確率: 100.00%

詳細結果:

============================================================

✓ 用例 1:

問題: Python中如何創建一個空列表?

生成答案: 在Python中,可以通過以下兩種方式創建一個空列表:

1. 使用方括號 `[]`,例如:`my_list = []`

2. 使用 `list()` 函數,例如:`my_list = list()`

期望答案: 可以使用方括號 [] 或 list() 函數創建空列表

匹配類型: semantic

置信度: 0.70

解釋: 語義評估認為答案等價

✓ 用例 2:

問題: 什麼是機器學習?

生成答案: 機器學習是人工智能的一個子領域,它使計算機能夠通過從數據中學習來改進其性能和決策能力,而無需進行明確的編

程。

期望答案: 機器學習是人工智能的一個子領域,使計算機能夠從數據中學習而不需要明確編程

匹配類型: semantic

置信度: 0.70

解釋: 語義評估認為答案等價

✓ 用例 3:

問題: 如何在Python中打印'Hello, World!'?

生成答案: 在Python中打印'Hello, World!',你可以使用以下代碼:

```python

print('Hello, World!')

```

期望答案: 使用 print('Hello, World!')

匹配類型: semantic

置信度: 0.70

解釋: 語義評估認為答案等價

匹配類型統計:

============================================================

semantic: 3次

準確率報告已保存至 qwen_accuracy_report.txt

5.3 核心組件

這個準確率評測系統包含以下核心組件:

- Qwen API集成:通過HTTP請求調用Qwen模型生成答案

- 知識庫檢索:使用Faiss實現檢索增強生成(RAG)

- 多層級準確率評估:從精確匹配到語義評估的多層次評估策略

- 結果分析與報告:生成詳細的準確率評測報告

5.4 評估策略

系統採用多層次的準確率評估策略:

第一層:精確匹配

if gen_norm == exp_norm:

return {

"is_correct": True,

"confidence": 1.0,

"match_type": "exact",

"explanation": "生成答案與標準答案完全匹配"

}

- 標準化答案文本(小寫、去除標點)

- 直接比較生成答案和標準答案

- 最高置信度(1.0)

第二層:可接受變體匹配

for variation in acceptable_variations:

if gen_norm == normalize_text(variation):

return {

"is_correct": True,

"confidence": 0.9,

"match_type": "acceptable_variation",

"explanation": "生成答案與可接受變體匹配"

}

- 檢查預定義的可接受答案變體

- 較高置信度(0.9)

第三層:關鍵詞匹配

if len(common_keywords) >= len(expected_keywords) * 0.7:

keyword_coverage = len(common_keywords) / len(expected_keywords)

return {

"is_correct": True,

"confidence": keyword_coverage * 0.8,

"match_type": "keyword_based",

"explanation": f"關鍵詞匹配度: {keyword_coverage:.2f}"

}

- 提取標準答案和生成答案的關鍵詞

- 計算關鍵詞重疊率

- 置信度基於關鍵詞覆蓋率(最高0.8)

第四層:語義評估

evaluation_prompt = f"""請判斷以下兩個答案是否在語義上等價:

答案1: {expected_answer}

答案2: {generated_answer}

請只回復"是"或"否",不要包含其他內容。"""

semantic_eval = self.call_qwen_api(evaluation_prompt, max_tokens=10)

- 使用Qwen API進行語義等價性判斷

- 中等置信度(0.7)

5.5 準確率計算過程

準確率的計算基於以下公式:

準確率 = 正確回答數量 / 總測試用例數量

其中,正確回答的判斷標準是上述多層級評估中的任何一層返回is_correct: True。

6. 適用場景

- 應用選型:為特定任務選擇最合適的模型

- 產品部署前:驗證模型在實際場景中的表現

- 持續優化:監控模型在生產環境中的性能變化

- 領域適配:評估模型在特定領域的適用性

7. 侷限性

- 測試數據泄露(訓練數據與測試數據重疊)

- 評估指標選擇不當

- 忽略領域特異性要求

8. 方法總結

- 外在評測核心:通過實際任務表現評估模型,關注實用性而非理論指標

- RAG架構價值:結合檢索與生成,提高答案准確性和可解釋性

- 多維度評估:需要從多個角度(準確性、相關性、流暢度等)綜合評估

- 實踐導向:外在評測結果直接影響模型的選擇和優化方向

兩種方法對比

|

維度 |

內在評測 |

外在評測 |

|

定義 |

評估模型基礎語言能力 |

評估模型在具體任務中的表現 |

|

關注點 |

模型的語言建模基本功 |

模型的實際應用效果 |

|

評測環境 |

孤立、受控的實驗室環境 |

真實或模擬的應用場景 |

|

主要指標 |

困惑度(PPL)、交叉熵損失 |

任務相關指標(準確率、F1值等) |

|

複雜度 |

相對簡單、標準化 |

複雜、需要構建任務管道 |

|

成本 |

計算成本低 |

需要標註數據、人工評估 |

實踐流程

一個完整的評測流程通常包括以下步驟:

- 明確目標: 我想測試模型的哪個方面,是通用能力還是某個專業領域?

- 選擇方法: 主要用內在評測、外在評測還是其他方法

- 準備數據: 構建高質量的標準測試集(如一堆問題+標準答案)。

- 運行評測: 讓模型在測試集上運行並收集結果。

- 分析結果: 計算各項指標,生成評測報告,分析優劣。

- 迭代優化: 根據評測結果指導模型的優化或篩選。

五、總結:

在選擇模型時,不要只看宣傳參數,更要關注它在與你任務相關的基準測試和外在實際任務中的表現,內在評測看基本功,外在評測看實戰能力,兩者相輔相成,結合使用才能全面評估一個模型。最重要的是,語言模型評估應該是一個持續的過程,而不是一次性的活動。而應該是持續的過程。這包括:定期重新評估以跟蹤模型性能的變化;監控生產環境中的模型表現;建立反饋機制收集用户評價;持續更新測試數據集以反映新的使用場景和需求。

隨着模型的發展和應用的擴展,評估也需要不斷演進和完善。特別是在模型更新或微調後,需要進行全面的重新評估,確保性能提升不會帶來新的問題。同時,也需要關注模型在不同用户羣體中的表現差異,確保公平性和包容性。