前言:為什麼需要深入理解 DeepSeek-R1?

在大模型快速迭代的今天,DeepSeek-R1 憑藉其推理增強能力和創新訓練範式成為行業焦點。作為深度求索推出的第一代推理專用大模型,它不僅在數學、代碼等複雜任務上性能對標頂級模型,更通過混合專家架構(MoE) 和無監督強化學習等技術,為大模型效率與能力平衡提供了新範式。

本文從基礎概念到核心技術,從訓練流程到實際部署,全方位拆解 DeepSeek-R1 的技術細節,幫你從 “使用者” 進階為 “技術理解者”。

一、模型概述:定位與核心優勢

1.1 模型家族圖譜

DeepSeek-R1 並非單一模型,而是包含多個版本的模型家族:

|

模型類別

|

代表模型

|

基礎架構

|

核心參數

|

適用場景

|

|

核心大模型

|

DeepSeek-R1

|

DeepSeek-V3-Base (MoE)

|

671B 總參數,37B 激活參數

|

複雜推理任務、科研實驗

|

|

探索性模型

|

DeepSeek-R1-Zero

|

DeepSeek-V3-Base (MoE)

|

671B 總參數,37B 激活參數

|

學術研究、RL 範式驗證

|

|

蒸餾小模型

|

DeepSeek-R1-Distill-Qwen-32B

|

Qwen2.5-32B (稠密)

|

32B 參數

|

企業部署、邊緣計算、低成本應用

|

|

蒸餾小模型

|

DeepSeek-R1-Distill-Llama-70B

|

Llama3-70B (稠密)

|

70B 參數

|

開源生態、二次開發

|

1.2 核心技術突破

DeepSeek-R1 的創新點集中在三個維度:

- 訓練範式革新:首次驗證 “無 SFT 直接 RL 訓練” 的可行性,通過冷啓動數據解決穩定性問題

- 架構效率平衡:採用 MoE 架構實現 “大參數儲備 + 小激活計算”,671B 總參數僅需 37B 激活參數

- 推理能力強化:專項優化數學、代碼等複雜推理任務,MATH-500 任務 Pass@1 達 97.3%

1.3 性能表現(核心指標)

在權威 benchmark 上的表現證明了其推理能力:

|

任務類型

|

評估數據集

|

DeepSeek-R1

|

對比模型

|

性能優勢

|

|

數學推理

|

AIME 2024

|

79.8%

|

OpenAI o1-1217

|

+0.6%

|

|

數學推理

|

MATH-500

|

97.3%

|

OpenAI o1-1217

|

+0.9%

|

|

代碼生成

|

LiveCodeBench

|

65.9%

|

OpenAI o1-1217

|

+2.5%

|

|

通用推理

|

MMLU-Pro

|

84.0%

|

Llama3-70B

|

+5.2%

|

|

中文推理

|

C-SimpleQA

|

63.7%

|

DeepSeek V3

|

-4.3%

|

二、基礎架構:從 Transformer 到 MoE 的進化

2.1 底層基石:Transformer 架構詳解

DeepSeek-R1 的基礎是 Transformer 解碼器,理解其核心組件是掌握大模型的第一步:

2.1.1 輸入處理:從文字到向量

- Tokenization:將文本分割為最小單位(如 "人工智能"→[“人工”,“智能”])

- 嵌入層(Embedding):將每個 Token 轉換為高維向量(8192 維):

其中是嵌入矩陣,

是 Token 的 one-hot 編碼

2.1.2 核心組件:自注意力機制

自注意力是 Transformer 的 “理解核心”,能建模詞與詞之間的關聯:

數學原理:

(Query):查詢向量(“我在找什麼”)

(Key):鍵向量(“我是什麼”)

(Value):值向量(“我的信息”)

:向量維度,防止內積過大導致 softmax 梯度消失

通俗解釋:類似查字典時,“蘋果” 這個詞(Query)會匹配到 “水果”(Key)相關的解釋(Value)

2.1.3 前饋網絡:特徵加工工廠

注意力輸出經過兩層線性變換 + 激活函數:

作用是對注意力提取的關聯特徵進行非線性加工,提煉更抽象的語義信息

2.2 架構創新:混合專家模型(MoE)

MoE 架構是 DeepSeek-R1 平衡能力與效率的核心,解決了傳統稠密模型 “參數量與計算量綁定” 的難題。

2.2.1 專家網絡(Expert Networks):專項能力單元

- 本質:每個專家是獨立的 Transformer 子網絡,專精於特定任務

- 數量:推測包含 128 個專家(基於 DeepSeek-V3 架構)

- 分工邏輯:

- 數學專家:處理公式推導、數值計算

- 代碼專家:解析語法結構、邏輯實現

- 語言專家:優化自然語言表達、上下文連貫

類比理解:專家網絡就像醫院的不同科室(內科、外科、兒科),每個科室專精一類疾病

2.2.2 路由網絡(Router Network):智能任務分配

路由網絡決定 “哪個輸入該由哪個專家處理”,工作流程如下:

- 輸入特徵提取:接收經過嵌入層的輸入向量

- 專家評分:通過線性變換計算每個專家的適配度:

其中和

是路由網絡參數,

表示第

個專家

- 權重歸一化:用 Softmax 將評分轉為概率分佈:

- 專家選擇:激活權重最高的 2-4 個專家(DeepSeek-R1 通常激活 2 個)

關鍵機制:負載均衡損失

為避免路由網絡 “偷懶” 只選少數專家,訓練時加入約束:

強制每個專家的平均被選概率接近 1/128

2.3 長文本優化:128K 上下文的秘密

DeepSeek-R1 支持 128K 超長文本(約 20 萬字),依賴兩大技術:

2.3.1 多頭潛在注意力(MLA):KV 緩存壓縮術

傳統注意力的痛點:長文本時 KV 緩存爆炸(存儲所有詞的 Key 和 Value)

MLA 解決方案:低秩分解壓縮

- 下投影(壓縮):

將 8192 維的 KV 矩陣壓縮到 256 維潛在空間 - 推理時存儲:僅保存壓縮後的

和

- 上投影(解壓):需要時恢復原始維度:

效果:KV 緩存大小降至傳統方法的 3%(256/8192),支持 128K 文本

2.3.2 旋轉位置編碼(RoPE):位置信息的精準表達

為什麼需要位置編碼?Transformer 本身是無序的,需顯式注入位置信息。

RoPE 創新點:用旋轉角度表示位置

- 位置

的向量

編碼後為:

- 角度計算:

(

為維度索引,

為總維度)

優勢:

- 相對位置可通過角度差直接計算(

與

的相對位置 = 角度差)

- 長文本下位置區分度穩定(不會像正弦編碼那樣隨位置增長模糊)

類比:類似鐘錶的時針位置,不同時間對應不同角度,一眼就能區分

三、參數配置與計算資源

3.1 核心模型參數明細

671B 總參數的構成拆解:

|

組件類別

|

參數量(估計)

|

佔比

|

核心作用

|

|

Token Embedding

|

1.5B

|

0.2%

|

將文字轉換為向量

|

|

專家網絡(128 個)

|

640B

|

95.4%

|

處理專項推理任務

|

|

路由網絡(60 層)

|

10B

|

1.5%

|

分配專家權重

|

|

注意力層

|

15B

|

2.2%

|

建模上下文關聯

|

|

前饋網絡

|

4.5B

|

0.7%

|

特徵非線性變換

|

|

總計 |

671B |

100%

|

-

|

3.2 激活參數與計算效率

MoE 架構的核心優勢:激活參數遠小於總參數

- 37B 激活參數構成:

- 2 個專家網絡:約 10B 參數

- 路由網絡:0.17B / 層 ×60 層 = 10B 參數

- 注意力 + 前饋網絡:約 17B 參數

- 合計:≈37B 參數

- 計算成本對比:

|

模型配置

|

單次推理顯存需求

|

推理速度(tokens/s)

|

硬件要求

|

|

671B MoE(激活 37B)

|

~700GB

|

30-50

|

8×A100 80GB GPU

|

|

37B 稠密模型

|

~80GB

|

20-30

|

2×A100 80GB GPU

|

|

32B 蒸餾模型

|

~60GB

|

40-60

|

1-2×A100 80GB GPU

|

四、訓練流程:四階段優化

DeepSeek-R1 的訓練是 “從粗到精” 的迭代過程,分為四個核心階段:

4.1 階段 1:SFT1(基礎能力種子)

目標:構建基礎指令遵循能力,避免無意義輸出

- 訓練數據:100 萬條通用指令數據,包括:

- 日常問答(“如何煮咖啡”)

- 簡單推理(“小明有 3 個蘋果,吃了 1 個,還剩幾個”)

- 文本創作(“寫一段關於春天的短文”)

- 訓練方法:監督微調(SFT)

讓模型模仿 “問題→答案” 的映射關係 - 損失函數:交叉熵損失

衡量模型輸出與標準答案的差異

- 訓練配置:

- 學習率:2e-5

- 批次大小:2048

- 訓練輪次:3

- 硬件:32×A100 80GB GPU

4.2 階段 2:RL1(推理模式探索)

核心創新:跳過傳統 SFT 直接 RL,驗證推理能力可通過試錯學習

- 訓練數據:複雜推理任務集:

- 數學:MATH(高中數學)、AIME(數學競賽)

- 代碼:LiveCodeBench(代碼生成)、Codeforces(編程競賽)

- 邏輯:GPQA(通用推理)、HumanEval(代碼邏輯)

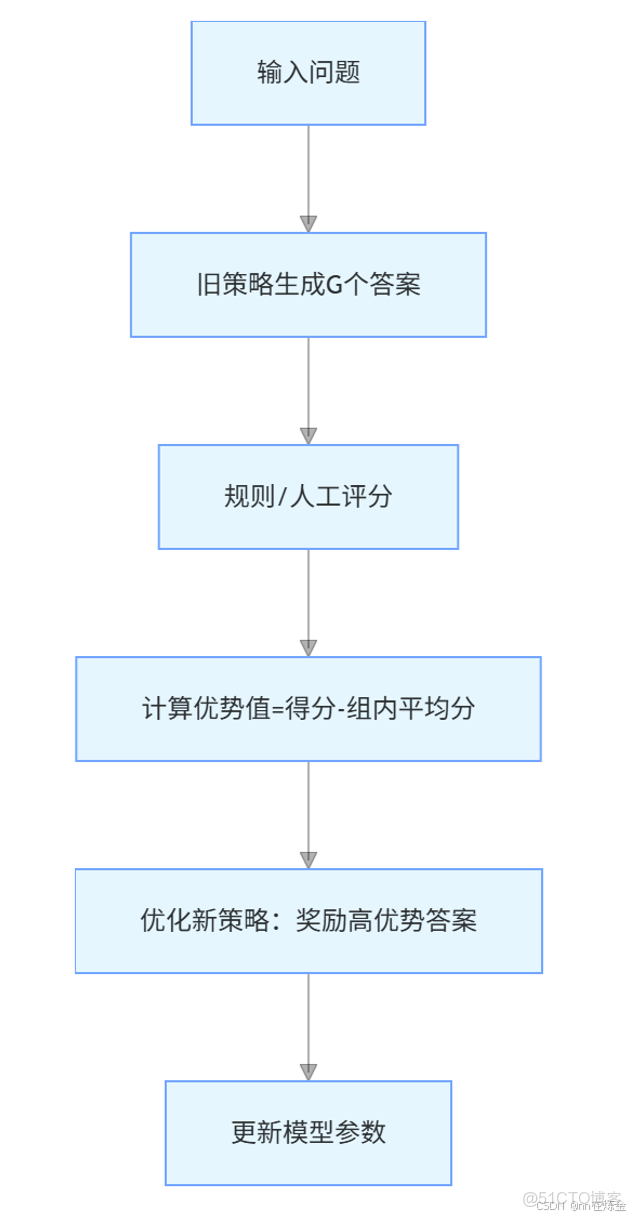

- 核心算法:GRPO(組相對策略優化)

無需單獨評論者模型,通過組內對比計算獎勵:

- 生成多答案:對同一問題生成 G 個答案(通常 64 個)

- 評分:用規則 / 人工打分(如數學題正確得 10 分)

- 計算優勢值:

- 更新策略:

其中

- 訓練現象:

模型開始出現 “分步推理” 行為(如數學題先列公式再計算)

但存在重複生成、語言混亂等問題(R1-Zero 版本)

4.3 階段 3:SFT2(冷啓動數據優化)

目標:修正 RL1 的缺陷,注入高質量推理範式

- 冷啓動數據:50 萬條精選樣本,滿足:

- 結構清晰:分步驟推理(“步驟 1→步驟 2→結論”)

- 語言規範:無重複、無多語言混合

- 領域覆蓋:數學、代碼、邏輯推理均衡

- 數據來源:

- 人工標註:專家編寫的詳細解題步驟

- 網絡篩選:教育網站的優質教程

- 模型生成 + 人工修正:RL1 輸出經專家優化

- 訓練效果:

解決 R1-Zero 的生成不穩定性

強化 “分步推理” 的輸出格式

減少重複和語言混亂問題

4.4 階段 4:RL2(人類偏好對齊)

目標:讓輸出不僅正確,還符合人類閲讀習慣

- 獎勵信號:

- 人工標註:1-5 星評分(正確性、可讀性、步驟完整性)

- 自動指標:重複率、語言一致性、格式規範性

- 訓練方法:RLHF(基於人類反饋的強化學習)

將人類偏好轉化為獎勵函數,優化模型輸出風格 - 最終效果:

輸出既準確又易讀

推理步驟完整且邏輯連貫

形成最終版本 DeepSeek-R1

五、關鍵技術深度解析

5.1 GRPO:大模型強化學習的效率革命

GRPO(Group-based Relative Policy Optimization)是 DeepSeek-R1 高效訓練的核心,解決了傳統 RL 算法計算成本高的問題。

5.1.1 與傳統 PPO 的核心區別

|

維度

|

GRPO

|

PPO(傳統)

|

|

評論者模型

|

不需要(用組內對比替代)

|

需要(單獨訓練價值網絡)

|

|

優勢值計算

|

組內平均分對比

|

評論者模型預測

|

|

計算成本

|

低(省去評論者訓練和推理)

|

高(需維護雙模型)

|

|

樣本效率

|

高(組內差異提供更多信息)

|

中

|

|

適合場景

|

大模型(千億參數級)

|

小模型(十億參數級以下)

|

5.1.2 工作原理可視化

5.1.3 數學原理解析

GRPO 的目標函數:

:新舊策略概率比

:優勢值(正優勢表示答案優於平均水平)

:限制更新幅度,防止策略突變

:控制新舊策略差異,提升穩定性

5.2 模型蒸餾:小模型擁有大能力的魔法

蒸餾技術讓 DeepSeek-R1 的推理能力 “下沉” 到中小模型,降低使用門檻。

5.2.1 蒸餾目標:不只是模仿答案,更是模仿推理

傳統蒸餾 vs DeepSeek-R1 蒸餾:

|

蒸餾方式

|

目標

|

效果

|

|

傳統蒸餾

|

模仿大模型最終答案

|

表面正確,缺乏推理能力

|

|

R1 蒸餾

|

模仿大模型推理過程

|

學會推理邏輯,舉一反三

|

5.2.2 蒸餾流程詳解

- 生成教學數據:

用 DeepSeek-R1 對 100 萬 + 問題生成詳細推理過程:

問題:求解x²+3x-10=0

大模型輸出:

<|FunctionCallBegin|>

這道題是一元二次方程,我可以用求根公式或因式分解來解。

首先嚐試因式分解:x²+3x-10=(x+a)(x+b)=x²+(a+b)x+ab

所以需要a+b=3,ab=-10,解得a=5,b=-2

因此方程可分解為(x+5)(x-2)=0,解為x=-5或x=2

驗證一下:(-5)²+3×(-5)-10=25-15-10=0,正確。

2²+3×2-10=4+6-10=0,正確。

\\\</think>

方程x²+3x-10=0的解為x=-5或x=2,即\boxed{-5}和\boxed{2}- 訓練學生模型:

用上述數據微調 Qwen2.5/Llama3 等開源模型,損失函數:

既保證答案正確,又模仿推理模式

- 架構適配:

- 擴展數學 / 代碼詞表

- 調整 RoPE 參數增強長距離推理

- 温度縮放校準輸出分佈

5.2.3 蒸餾效果驗證

|

蒸餾模型

|

AIME 2024 得分

|

同規模模型對比

|

性能差距(與 R1)

|

|

DeepSeek-R1-Distill-Qwen-32B

|

72.6%

|

o1-mini(65.6%)

|

+7.2%

|

|

DeepSeek-R1-Distill-Llama-70B

|

70.0%

|

Llama3-70B(58.3%)

|

+9.8%

|

5.3 RoPE:讓模型理解 “順序” 的編碼藝術

旋轉位置編碼(RoPE)是 DeepSeek-R1 處理長文本的關鍵,解決了傳統位置編碼的缺陷。

5.3.1 傳統位置編碼的問題

- 正弦編碼:長文本時位置區分度下降(位置 1000 和 1001 的編碼幾乎相同)

- 可學習編碼:泛化性差,訓練長度外的位置表現差

5.3.2 RoPE 的核心創新

通過旋轉矩陣注入位置信息,使相對位置可通過內積直接計算:

對於查詢向量

它們的內積為:

僅與相對位置

六、推理部署與參數調優

6.1 環境配置要求

|

模型版本

|

最低 GPU 配置

|

推薦 GPU 配置

|

推理框架

|

|

DeepSeek-R1(671B)

|

8×A100 80GB

|

16×A100 80GB

|

vLLM/SGLang

|

|

DeepSeek-R1-Distill-Qwen-32B

|

1×A100 80GB

|

2×A100 80GB

|

vLLM

|

|

DeepSeek-R1-Distill-Llama-70B

|

2×A100 80GB

|

4×A100 80GB

|

vLLM

|

6.2 部署步驟(以 32B 蒸餾模型為例)

- 安裝依賴:

pip install vllm transformers accelerate- 啓動推理服務:

vllm serve deepseek-ai/DeepSeek-R1-Distill-Qwen-32B \\

\--tensor-parallel-size 2 \\

\--gpu-memory-utilization 0.9 \\

\--max-model-len 32768 \\

\--temperature 0.6 \\

\--top-p 0.95- API 調用示例:

import requests

import json

url = "http://localhost:8000/generate"

headers = {"Content-Type": "application/json"}

data = {

"prompt": "求解方程x²+5x+6=0,請分步推理並給出答案",

"max\_tokens": 1024,

"temperature": 0.6,

"top\_p": 0.95,

"stop": \["\n\n"]

}

response = requests.post(url, headers=headers, data=json.dumps(data))

print(response.json()\["text"])6.3 關鍵參數調優指南

|

參數

|

推薦值

|

作用説明

|

調優原則

|

|

temperature

|

0.6

|

控制輸出隨機性(0 = 確定,1 = 隨機)

|

數學 / 代碼任務調低(0.5-0.6)

|

|

top_p

|

0.95

|

累積概率閾值(控制輸出多樣性)

|

通用任務 0.9-0.95

|

|

max_tokens

|

32768

|

最大輸出長度

|

複雜推理設大(如 16384)

|

|

強制格式

|

|

確保推理過程完整輸出

|

所有推理任務均推薦啓用

|

七、與主流模型的對比分析

7.1 架構對比

|

模型

|

架構類型

|

總參數

|

激活參數

|

上下文長度

|

推理優化技術

|

|

DeepSeek-R1

|

MoE

|

671B

|

37B

|

128K

|

MLA、RoPE、GRPO

|

|

GPT-4

|

推測 MoE

|

未公開

|

未公開

|

128K

|

未公開

|

|

Llama3-70B

|

稠密模型

|

70B

|

70B

|

128K

|

RoPE

|

|

Qwen2.5-72B

|

稠密模型

|

72B

|

72B

|

128K

|

RoPE、FlashAttention

|

7.2 推理能力對比

|

任務類型

|

DeepSeek-R1

|

GPT-4

|

Llama3-70B

|

Qwen2.5-72B

|

|

數學推理(MATH)

|

97.3%

|

95.8%

|

78.5%

|

82.1%

|

|

代碼生成(HumanEval)

|

85.2%

|

87.0%

|

76.3%

|

80.5%

|

|

通用推理(MMLU)

|

84.0%

|

86.4%

|

78.8%

|

81.2%

|

|

長文本理解

|

82.5%

|

85.0%

|

75.3%

|

79.8%

|

7.3 優勢與侷限總結

核心優勢:

- 推理能力突出:數學、代碼任務對標頂級模型

- 效率平衡優秀:MoE 架構實現大參數小計算

- 部署門檻低:蒸餾模型性能優異且資源需求適中

- 開源友好:蒸餾模型基於開源基座,支持二次開發

現存侷限:

- 中文推理均衡性不足:部分中文任務性能略遜

- 生成穩定性待優化:偶爾出現步驟跳過現象

- 核心模型部署成本高:需多卡高端 GPU 支持

官方資源彙總

- 論文地址:DeepSeek-R1: Incentivizing Reasoning Capability in LLMs via Reinforcement Learning

- GitHub 倉庫:https://github.com/deepseek-ai/DeepSeek-R1

- Hugging Face 模型庫:deepseek-ai/DeepSeek-R1

結語:大模型推理增強的未來方向

DeepSeek-R1 通過創新的 MoE 架構、GRPO 強化學習和高效蒸餾技術,為大模型推理能力提升提供了新範式。其 “無 SFT 直接 RL” 的探索證明了強化學習在推理任務上的巨大潛力,而蒸餾技術則讓強推理能力走向普及。

未來,隨着獎勵函數設計的精細化、多模態推理的融合以及部署效率的進一步優化,推理增強大模型將在教育、科研、工程等領域發揮更大價值。對於開發者和研究者而言,理解 DeepSeek-R1 的技術原理不僅能幫助更好地使用模型,更能啓發新的技術創新。