前言

卷積神經網絡(CNN)和循環神經網絡(RNN)是深度學習中處理兩類核心數據的基石模型:CNN擅長捕捉空間特徵(如圖像),RNN擅長處理序列依賴(如文本、語音)。本文將從原理、結構、易錯點到代碼實現全面解析,適合作為學習筆記或技術博客參考。

一、卷積神經網絡(CNN)

1. 核心原理:局部感知與權值共享

人類視覺系統觀察物體時,先感知局部細節(如邊緣、紋理),再拼接成整體。CNN模擬這一過程,通過卷積操作提取局部特徵,通過權值共享減少參數數量。

2. 結構詳解

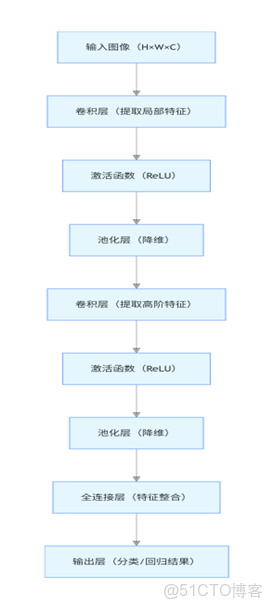

CNN的典型結構為:輸入層 → 卷積層 → 池化層 → 全連接層 → 輸出層,可堆疊多個卷積+池化模塊。

(1)卷積層(Convolutional Layer)

- 作用:提取局部特徵(如邊緣、色塊、紋理)。

- 核心計算:通過「卷積核(Kernel)」與輸入數據做滑動內積。

例:3×3卷積核在5×5圖像上滑動(步長=1,無填充),輸出3×3特徵圖:

- 參數:每個卷積核的權重在滑動中共享(減少參數,避免過擬合)。

(2)池化層(Pooling Layer)

- 作用:壓縮特徵圖(降維),保留關鍵信息,增強平移不變性。

- 常見類型:

- 最大池化(Max Pooling):取局部最大值(保留顯著特徵,如邊緣)。

- 平均池化(Average Pooling):取局部平均值(保留整體趨勢)。

(3)全連接層(Fully Connected Layer)

- 作用:將卷積層提取的特徵映射到輸出空間(如分類標籤)。

- 特點:所有神經元與前一層全連接,參數較多(通常在網絡末尾使用)。

3. 流程圖

4. 易錯點與注意事項

- 卷積尺寸計算錯誤

忘記填充(Padding)或步長(Stride)的影響,導致特徵圖尺寸計算錯誤。

✅ 牢記公式:輸出尺寸 = (輸入尺寸 - 核尺寸 + 2×填充) / 步長 + 1(需為整數)。 - 池化層濫用

連續使用池化層可能導致特徵丟失(尤其小尺寸圖像)。

✅ 小圖像(如MNIST 28×28)建議最多1-2次池化。 - 過擬合風險

卷積層參數雖少,但全連接層易過擬合。

✅ 加入Dropout(如nn.Dropout(0.5))、L2正則化,或使用數據增強(旋轉、裁剪)。 - 通道數混淆

輸入圖像通道(如RGB為3通道)需與卷積核輸入通道一致。

✅ 卷積層參數in_channels需匹配前一層輸出通道。

5. 代碼示例(PyTorch實現簡單CNN)

以MNIST手寫數字分類為例:

import torch

import torch.nn as nn

import torch.optim as optim

from torchvision import datasets, transforms

# 1. 數據預處理

transform = transforms.Compose([

transforms.ToTensor(), # 轉為Tensor並歸一化到[0,1]

transforms.Normalize((0.1307,), (0.3081,)) # MNIST均值和標準差

])

train_dataset = datasets.MNIST('data', train=True, download=True, transform=transform)

train_loader = torch.utils.data.DataLoader(train_dataset, batch_size=64, shuffle=True)

# 2. 定義CNN模型

class SimpleCNN(nn.Module):

def __init__(self):

super(SimpleCNN, self).__init__()

# 卷積層1:輸入1通道(灰度圖),輸出16通道,3×3卷積核

self.conv1 = nn.Conv2d(in_channels=1, out_channels=16, kernel_size=3, stride=1, padding=1)

self.pool = nn.MaxPool2d(kernel_size=2, stride=2) # 2×2最大池化

# 卷積層2:輸入16通道,輸出32通道

self.conv2 = nn.Conv2d(16, 32, 3, 1, 1)

# 全連接層:32通道×7×7(池化後尺寸)→ 128 → 10(分類數)

self.fc1 = nn.Linear(32 * 7 * 7, 128)

self.fc2 = nn.Linear(128, 10)

self.dropout = nn.Dropout(0.5) # 防止過擬合

def forward(self, x):

# 輸入x: [batch_size, 1, 28, 28]

x = self.pool(torch.relu(self.conv1(x))) # 輸出: [batch, 16, 14, 14]

x = self.pool(torch.relu(self.conv2(x))) # 輸出: [batch, 32, 7, 7]

x = x.view(-1, 32 * 7 * 7) # 展平: [batch, 32*7*7]

x = torch.relu(self.fc1(x))

x = self.dropout(x)

x = self.fc2(x)

return x

# 3. 訓練模型

model = SimpleCNN()

criterion = nn.CrossEntropyLoss()

optimizer = optim.Adam(model.parameters(), lr=0.001)

for epoch in range(3): # 簡單訓練3輪

model.train()

for batch_idx, (data, target) in enumerate(train_loader):

optimizer.zero_grad()

output = model(data)

loss = criterion(output, target)

loss.backward()

optimizer.step()

if batch_idx % 100 == 0:

print(f'Epoch {epoch}, Batch {batch_idx}, Loss: {loss.item():.4f}')二、循環神經網絡(RNN)

1. 核心原理:處理序列依賴

RNN通過循環結構保留歷史信息,適用於輸入/輸出為序列的場景(如文本、語音、時間序列)。其核心是「隱藏狀態(Hidden State)」,用於傳遞歷史信息。

2. 結構詳解

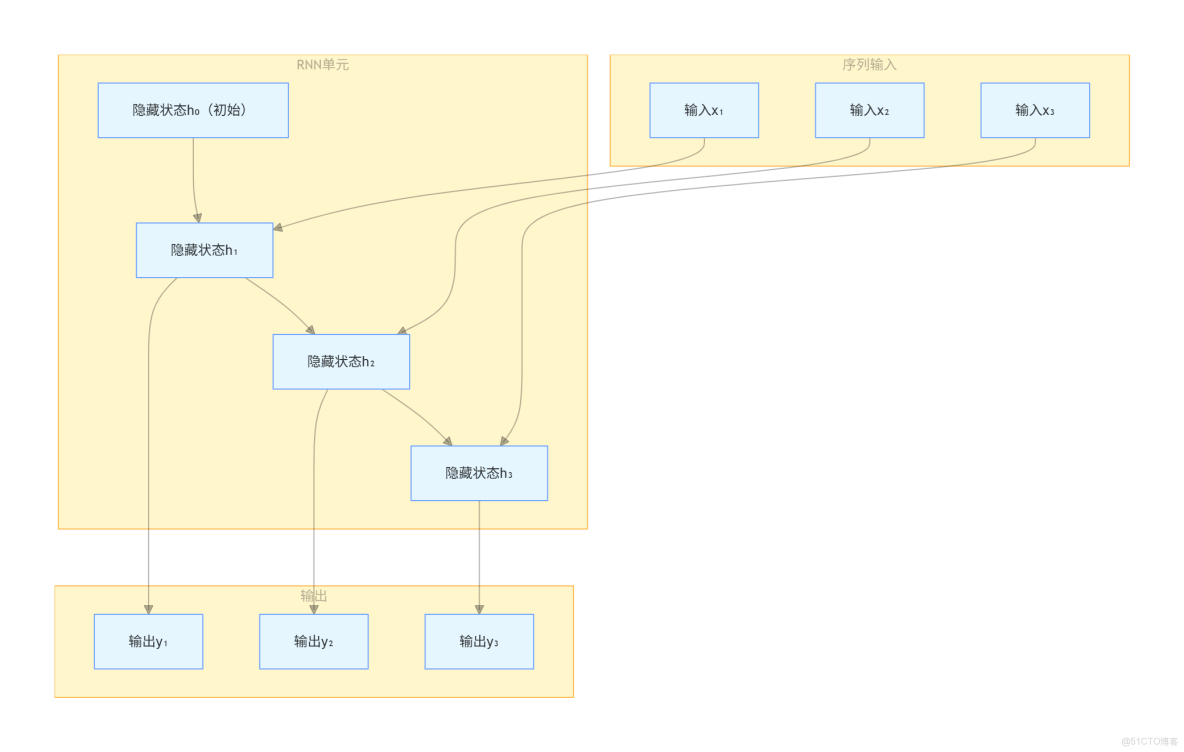

RNN的基本單元為循環神經元,輸入包含當前數據和上一時刻的隱藏狀態,輸出當前隱藏狀態和預測結果。

(1)基礎RNN結構

- 輸入:

(

時刻的輸入)、

(

時刻的隱藏狀態)。

- 計算:

(為激活函數,如tanh;

為權重矩陣,

為偏置)

(2)改進模型:解決長序列依賴

基礎RNN存在「梯度消失/爆炸」問題(無法記住長序列信息),因此實際中常用改進版:

- LSTM(長短期記憶網絡):通過「遺忘門、輸入門、輸出門」控制信息的存儲與遺忘,適合超長序列(如千級長度)。

- GRU(門控循環單元):簡化LSTM結構,僅保留「重置門、更新門」,計算效率更高,適合中長序列(如百級長度)。

3. 流程圖

4. 易錯點與注意事項

- 序列維度順序混淆

不同框架對輸入維度的要求不同(如PyTorch為(seq_len, batch_size, feature),TensorFlow為(batch_size, seq_len, feature))。

✅ 初始化模型時注意batch_first參數(PyTorch中batch_first=True可轉為(batch, seq_len, feature))。 - 隱藏狀態初始化

未正確初始化隱藏狀態()會導致訓練不穩定。

✅ 用model.init_hidden(batch_size)動態初始化,或直接讓框架自動初始化(如PyTorch的nn.RNN會默認初始化全0隱藏狀態)。 - 長序列梯度問題

即使LSTM/GRU,超長序列(如>1000步)仍可能梯度爆炸。

✅ 使用梯度裁剪(torch.nn.utils.clip_grad_norm_(model.parameters(), max_norm=1))。 - 變長序列處理

序列長度不一致時(如句子長短不同),直接padding會引入無效信息。

✅ 使用PackedSequence(PyTorch)或masking(TensorFlow)忽略padding部分。

5. 代碼示例(PyTorch實現GRU文本分類)

以情感分析(正面/負面分類)為例,假設文本已轉為詞向量:

import torch

import torch.nn as nn

import torch.optim as optim

# 1. 模擬數據(batch_size=2,seq_len=3,每個詞向量維度=10)

# 輸入: [batch, seq_len, feature](因batch_first=True)

x = torch.randn(2, 3, 10) # 2個樣本,每個3個詞,詞向量10維

y = torch.tensor([0, 1]) # 標籤:0=負面,1=正面

# 2. 定義GRU模型

class SimpleGRU(nn.Module):

def __init__(self, input_size=10, hidden_size=32, num_classes=2):

super(SimpleGRU, self).__init__()

self.hidden_size = hidden_size

# GRU層:輸入維度10,隱藏層維度32,batch_first=True(方便處理)

self.gru = nn.GRU(input_size, hidden_size, batch_first=True)

self.fc = nn.Linear(hidden_size, num_classes) # 輸出分類

def forward(self, x):

# 初始化隱藏狀態:(num_layers, batch_size, hidden_size)

h0 = torch.zeros(1, x.size(0), self.hidden_size) # GRU默認1層

# 輸出: out=(batch, seq_len, hidden_size), hn=(1, batch, hidden_size)

out, _ = self.gru(x, h0)

# 取最後一個時刻的隱藏狀態作為序列特徵

out = out[:, -1, :] # (batch, hidden_size)

out = self.fc(out)

return out

# 3. 訓練模型

model = SimpleGRU()

criterion = nn.CrossEntropyLoss()

optimizer = optim.Adam(model.parameters(), lr=0.001)

model.train()

for epoch in range(10):

optimizer.zero_grad()

output = model(x)

loss = criterion(output, y)

loss.backward()

optimizer.step()

print(f'Epoch {epoch}, Loss: {loss.item():.4f}')三、CNN與RNN核心對比

|

維度

|

CNN

|

RNN(含LSTM/GRU)

|

|

核心數據類型

|

空間數據(圖像、視頻幀)

|

序列數據(文本、語音、時間序列)

|

|

特徵提取方式

|

局部空間特徵(卷積+池化)

|

時間/順序依賴(隱藏狀態傳遞)

|

|

參數效率

|

高(權值共享)

|

中(循環結構參數重複使用)

|

|

典型應用

|

圖像分類、目標檢測、圖像生成

|

機器翻譯、語音識別、文本生成

|

|

並行計算

|

易(卷積操作可並行)

|

難(序列依賴需按順序計算)

|

總結

- CNN通過卷積和池化捕捉空間規律,是計算機視覺的核心工具。

- RNN(及改進版)通過循環結構處理序列依賴,在自然語言處理中不可或缺。

- 實際應用中兩者常結合(如CNN提取視頻幀特徵+RNN分析時序關係),需根據數據類型靈活選擇。